【深度收藏】智能体开发框架对比:Coze、Dify、FastGPT技术选型指南

【深度收藏】智能体开发框架对比:Coze、Dify、FastGPT技术选型指南

以大语言模型为核心驱动力的 AI 智能体,正凭借其自主决策、工具协同与闭环控制三大核心能力,颠覆传统任务执行模式。它能够在无明确指令的场景下,完成需求拆解、方案推理、跨系统协作等复杂流程,如同企业中无需监管的 “数字协管员”—— 从自动梳理客户诉求,到联动业务系统生成解决方案,全程实现端到端自动化处理,极大提升了复杂场景的响应效率与执行精度。

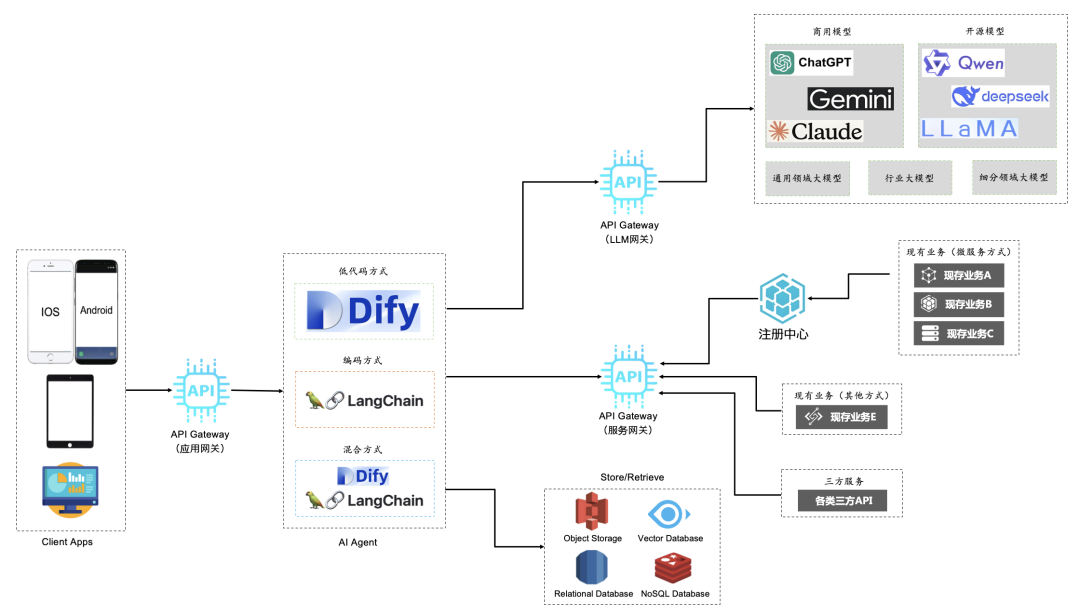

一、AI 智能体核心架构与运行机制

(一)架构核心组件与流程拆解

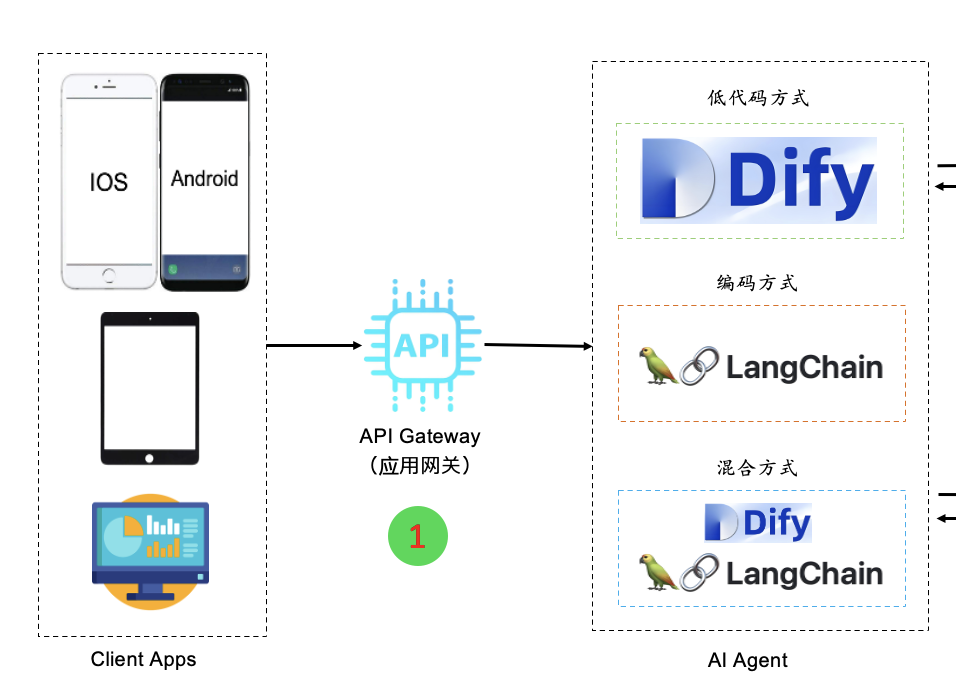

- 应用网关:请求入口的 “智能分流器”

作为用户请求的第一触点,应用网关不仅承担传统的鉴权校验、流量限流、安全防护等基础职责,核心价值在于业务路由适配—— 根据请求类型(如客服问答、数据分析、流程审批)精准匹配对应的智能体服务。

目前企业构建智能体主要采用三种路径:

-

轻量场景:基于 Dify 等低代码平台快速配置,无需深度编码;

-

定制场景:通过 LangChain 等框架纯编码开发,实现精细化控制;

-

混合场景:多数企业采用 “低代码配置 + 核心模块编码” 模式,针对不同业务灵活适配构建方式。

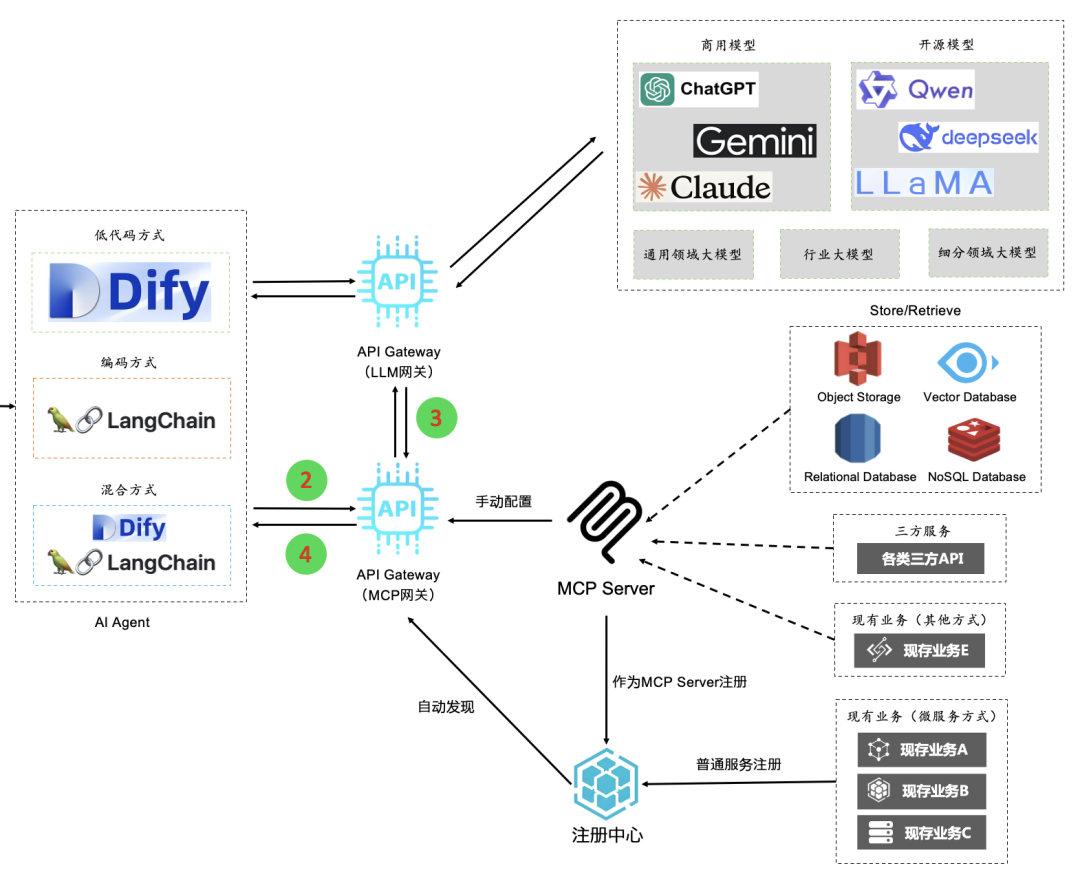

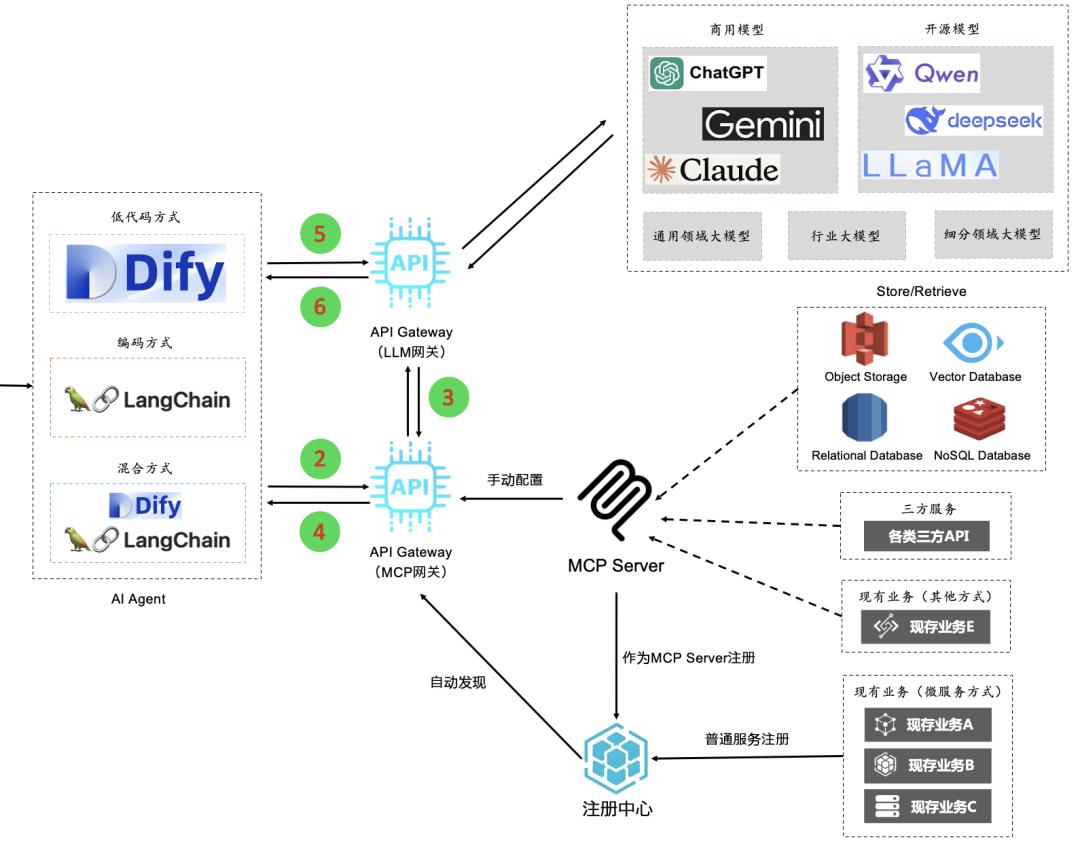

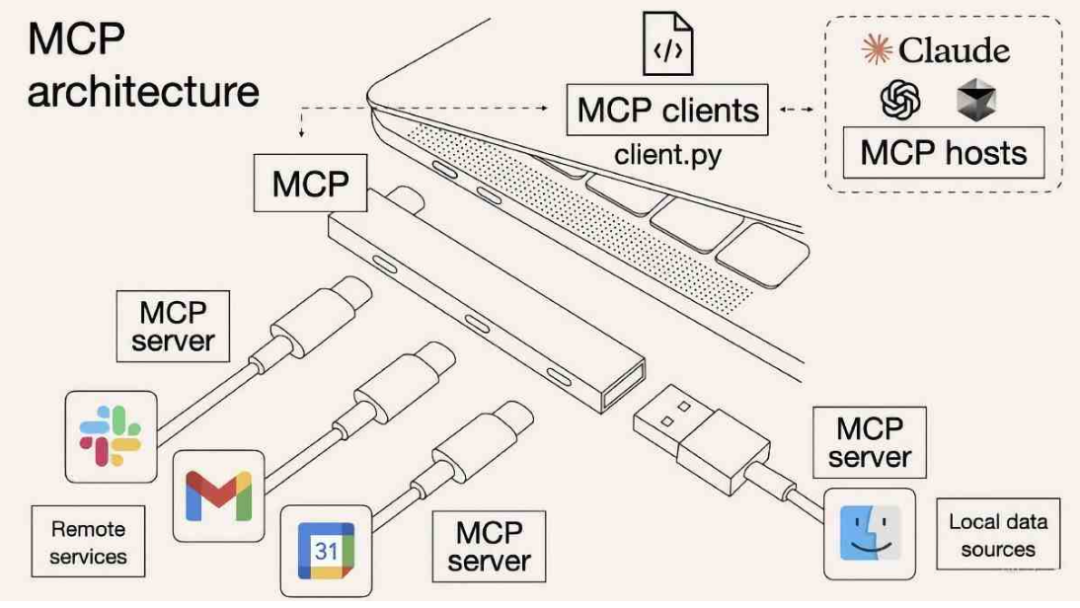

- MCP 网关:工具调度的 “能力中枢”

智能体接收请求后,首先向 MCP 网关发起查询,获取可用的 MCP Server(服务节点)与 MCP Tool(功能工具)清单,这是实现跨系统协作的关键环节。

- LLM 网关:效率优化的 “筛选助手”(可选步骤)

当 MCP 网关维护的服务与工具数量庞大时,智能体会先通过 LLM 网关调用大模型,基于用户请求特征缩小 MCP 资源范围,有效降低后续推理的 Token 消耗与响应延迟。

- 推理与执行闭环

-

智能体将用户请求与筛选后的 MCP 资源信息同步至 LLM 网关,由大模型推理确定最优服务与工具组合;

-

依据推理结果,通过 MCP 网关调用目标工具获取数据并生成解决方案;

-

实际运行中,上述步骤会形成循环迭代(重复 2-7 步),持续优化输出结果,直至满足需求。

(二)关键补充说明

- 微服务适配要求:在微服务架构中,MCP Server 必须完成注册中心备案,否则智能体无法发现并调用后端业务服务,这是保障跨系统协作通畅的前提条件。

- 传统架构备选方案:考虑到当前 A2A(Agent to Agent)、AG-UI(Agent to UI)等新兴协议尚未形成统一标准,企业可采用无 MCP 依赖的简化架构 —— 智能体直接通过 API 对接数据源或业务系统,适配中小规模、低复杂度的应用场景。

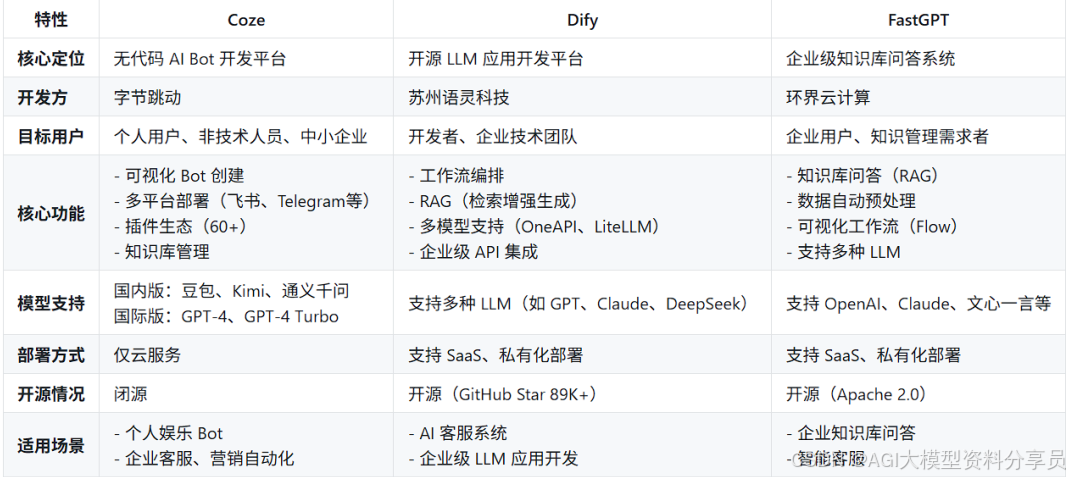

二、主流智能体开发工具深度对比

2025 年,低代码 / 无代码平台、开发者框架已形成差异化竞争格局,以下从产品定位、技术架构、实战效果等维度展开分析。

(一)产品定位:三类工具的核心差异

在产品定位上,主要总结以下区别:

- Coze:适合快速搭建聊天机器人,无需/少量需要编程,适合 C 端用户或轻量级企业应用。

- Dify:适合开发者构建复杂 AI 应用,支持多模型切换和私有化部署。

- FastGPT:适合企业知识库管理,需高效问答系统,涉及军工、医疗等敏感数据,且IT团队具备本地化运维能力。

对于私有化部署场景,比较推荐Dify或者FastGPT,举一个实际案例:

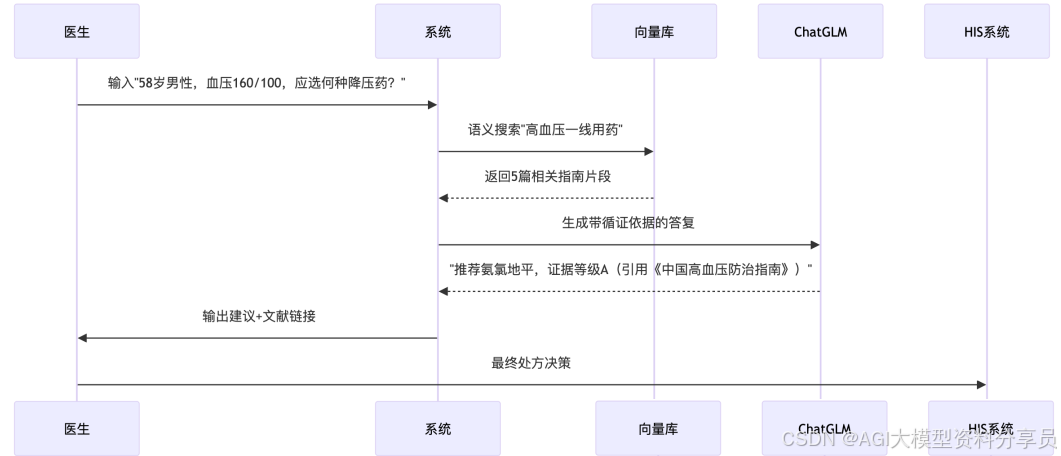

(二)实战案例:FastGPT三甲医院医疗知识库(全本地化)

场景需求: 医院需构建内部临床决策支持系统,整合最新诊疗指南和药品库,禁止数据外传。

技术实现:

- 知识库构建:

- 将2000份PDF指南通过FastGPT 向量化引擎 转换为嵌入数据

- 建立药品-适应症关联图谱

-

查询流程:

-

整体流程:

-

硬件配置: 本地部署在3台A100服务器,响应延迟<1.5秒。

-

效果体现 医生查询指南时间从15分钟缩短至20秒,诊断符合率提升12%

三、技术架构对比

FastGPT

开源架构基于Node.js + React技术栈,采用微服务化设计(支持独立部署知识库引擎与LLM网关)。

核心模块

- Flow Engine:基于DAG(有向无环图)的可视化编排系统,支持Python代码节点注入。

- RAG Pipeline:集成多阶段召回-排序机制,支持混合检索(关键词+向量)。

扩展性通过Docker Compose实现私有化部署,支持自定义插件开发(需修改Go语言编写的中间件)。

Dify

LLMOps架构采用BaaS(Backend-as-a-Service)模式,抽象出"Dataset-LLM-App"三层结构。

关键技术

- 模型路由层:支持OneAPI协议,可动态切换不同厂商的LLM(如Azure/OpenAI/Anthropic)。

- 异步任务队列:基于Celery实现长文本生成任务的分片处理。

部署方案提供Kubernetes Helm Chart,支持水平扩展的Worker节点。

Coze

低代码架构前端采用WebAssembly优化交互性能,后端基于字节跳动自研的MLaaS平台。

核心特性

- 对话状态机:内置NLU引擎支持意图识别与上下文管理(有限状态机实现)。

- 插件热加载:通过WebSocket实现插件动态更新,无需重启服务。

运维体系依赖字节云原生基础设施,暂未开放私有化部署方案。

四、模型支持与集成深度对比

总结以上关键结论:

模型灵活性:

- Dify > FastGPT > Coze

- Dify支持混合云架构,可同时调用云模型和本地模型。

企业级集成:

- Dify 提供完整的API工具链和微调能力,适合构建复杂AI中台。

- FastGPT 在数据隐私场景有绝对优势,但扩展性受限。

成本效率:

- FastGPT 本地化方案长期成本最低,但初期部署门槛高。

- Dify 适合需要平衡灵活性与成本的中大型企业。

生态绑定:

Coze 深度集成字节系产品(如抖音、飞书、即梦),非字节生态慎选。

如何从零学会大模型?小白&程序员都能跟上的入门到进阶指南

当AI开始重构各行各业,你或许听过“岗位会被取代”的焦虑,但更关键的真相是:技术迭代中,“效率差”才是竞争力的核心——新岗位的生产效率远高于被替代岗位,整个社会的机会其实在增加。

但对个人而言,只有一句话算数:

“先掌握大模型的人,永远比后掌握的人,多一次职业跃迁的机会。”

回顾计算机、互联网、移动互联网的浪潮,每一次技术革命的初期,率先拥抱新技术的人,都提前拿到了“职场快车道”的门票。我在一线科技企业深耕12年,见过太多这样的案例:3年前主动学大模型的同事,如今要么成为团队技术负责人,要么薪资翻了2-3倍。

深知大模型学习中,“没人带、没方向、缺资源”是最大的拦路虎,我们联合行业专家整理出这套 《AI大模型突围资料包》,不管你是零基础小白,还是想转型的程序员,都能靠它少走90%的弯路:

- ✅ 小白友好的「从零到一学习路径图」(避开晦涩理论,先学能用的技能)

- ✅ 程序员必备的「大模型调优实战手册」(附医疗/金融大厂真实项目案例)

- ✅ 百度/阿里专家闭门录播课(拆解一线企业如何落地大模型)

- ✅ 2025最新大模型行业报告(看清各行业机会,避免盲目跟风)

- ✅ 大厂大模型面试真题(含答案解析,针对性准备offer)

- ✅ 2025大模型岗位需求图谱(明确不同岗位需要掌握的技能点)

所有资料已整理成包,想领《AI大模型入门+进阶学习资源包》的朋友,直接扫下方二维码获取~

① 全套AI大模型应用开发视频教程:从“听懂”到“会用”

不用啃复杂公式,直接学能落地的技术——不管你是想做AI应用,还是调优模型,这套视频都能覆盖:

- 小白入门:提示工程(让AI精准输出你要的结果)、RAG检索增强(解决AI“失忆”问题)

- 程序员进阶:LangChain框架实战(快速搭建AI应用)、Agent智能体开发(让AI自主完成复杂任务)

- 工程落地:模型微调与部署(把模型用到实际业务中)、DeepSeek模型实战(热门开源模型实操)

每个技术点都配“案例+代码演示”,跟着做就能上手!

课程精彩瞬间

② 大模型系统化学习路线:避免“学了就忘、越学越乱”

很多人学大模型走弯路,不是因为不努力,而是方向错了——比如小白一上来就啃深度学习理论,程序员跳过基础直接学微调,最后都卡在“用不起来”。

我们整理的这份「学习路线图」,按“基础→进阶→实战”分3个阶段,每个阶段都明确:

- 该学什么(比如基础阶段先学“AI基础概念+工具使用”)

- 不用学什么(比如小白初期不用深入研究Transformer底层数学原理)

- 学多久、用什么资料(精准匹配学习时间,避免拖延)

跟着路线走,零基础3个月能入门,有基础1个月能上手做项目!

③ 大模型学习书籍&文档:打好理论基础,走得更稳

想长期在大模型领域发展,理论基础不能少——但不用盲目买一堆书,我们精选了「小白能看懂、程序员能查漏」的核心资料:

- 入门书籍:《大模型实战指南》《AI提示工程入门》(用通俗语言讲清核心概念)

- 进阶文档:大模型调优技术白皮书、LangChain官方中文教程(附重点标注,节省阅读时间)

- 权威资料:斯坦福CS224N大模型课程笔记(整理成中文,避免语言障碍)

所有资料都是电子版,手机、电脑随时看,还能直接搜索重点!

④ AI大模型最新行业报告:看清机会,再动手

学技术的核心是“用对地方”——2025年哪些行业需要大模型人才?哪些应用场景最有前景?这份报告帮你理清:

- 行业趋势:医疗(AI辅助诊断)、金融(智能风控)、教育(个性化学习)等10大行业的大模型落地案例

- 岗位需求:大模型开发工程师、AI产品经理、提示工程师的职责差异与技能要求

- 风险提示:哪些领域目前落地难度大,避免浪费时间

不管你是想转行,还是想在现有岗位加技能,这份报告都能帮你精准定位!

⑤ 大模型大厂面试真题:针对性准备,拿offer更稳

学会技术后,如何把技能“变现”成offer?这份真题帮你避开面试坑:

- 基础题:“大模型的上下文窗口是什么?”“RAG的核心原理是什么?”(附标准答案框架)

- 实操题:“如何优化大模型的推理速度?”“用LangChain搭建一个多轮对话系统的步骤?”(含代码示例)

- 场景题:“如果大模型输出错误信息,该怎么解决?”(教你从技术+业务角度回答)

覆盖百度、阿里、腾讯、字节等大厂的最新面试题,帮你提前准备,面试时不慌!

以上资料如何领取?

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

为什么现在必须学大模型?不是焦虑,是事实

最近英特尔、微软等企业宣布裁员,但大模型相关岗位却在疯狂扩招:

- 大厂招聘:百度、阿里的大模型开发岗,3-5年经验薪资能到50K×20薪,比传统开发岗高40%;

- 中小公司:甚至很多传统企业(比如制造业、医疗公司)都在招“会用大模型的人”,要求不高但薪资可观;

- 门槛变化:不出1年,“有大模型项目经验”会成为很多技术岗、产品岗的简历门槛,现在学就是抢占先机。

风口不会等任何人——与其担心“被淘汰”,不如主动学技术,把“焦虑”变成“竞争力”!

最后:全套资料再领一次,别错过这次机会

这份完整版的大模型 AI 学习资料已经上传CSDN,朋友们如果需要可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

更多推荐

已为社区贡献6条内容

已为社区贡献6条内容

所有评论(0)