《MetaGPT智能体开发入门》教程

智能体 = LLM+观察+思考+行动+记忆多智能体 = 智能体+环境+SOP+评审+路由+订阅+经济(详见相关资料)记忆分为五种类型:工作记忆、工具记忆、语义记忆、情节记忆和动作记忆。人类的记忆会经历过滤、压缩、遗忘和重组等环节,实际机制非常复杂,99%的记忆会被删除。来源: https://zh.wikipedia.org/zh-hans/%E8%84%91工作记忆是指保持与当前任务相关的临时信

第一章:前期准备

GPTs 上传了本教程PDF的课程助教如果有不明白的问题可以在群内交流也可以请教课程助教,注意将回答丢到群中,这样你可能可以得到一个更多角度的判断

Q:为什么对话chatbot-agent智能体框架要用python异步编程的架构实现

A:首先,我们需要了解异步编程的概念。在传统的同步编程中,代码按照顺序执行,一个任务的完成必须等待前一个任务完成。这种方式在处理I/O密集型操作(如网络请求)时效率较低,因为CPU在等待I/O操作完成时,会处于闲置状态。

异步编程允许程序在等待一个任务完成时继续执行其他任务,这对于I/O密集型的应用特别有用。在聊天机器人的场景中,异步编程使得系统能够同时处理多个聊天会话,而不需要为每个会话独立等待响应。

使用Python实现异步编程的一个重要原因是Python的异步支持已经相当成熟。Python的

asyncio库提供了一套易于理解和使用的API,用于编写单线程的并发代码。这使得Python成为开发异步聊天机器人的理想选择。现在,我们将这个概念简化一下:

想象一个服务员(程序)在一个忙碌的餐厅(服务器)里工作。在同步编程模式下,服务员每次只能服务一个顾客,即使顾客只是在等待他们的饮料。服务员必须站在那里,等待饮料准备好,然后才能去服务下一个顾客。这很低效,因为服务员在等待时无事可做。

在异步模式下,服务员点完一个顾客的饮料后,可以去服务其他顾客,而不是等待。当饮料准备好时,服务员会得到通知,然后再继续服务那个顾客。这样,服务员可以同时处理多个任务,提高效率。

这就是为什么使用Python异步编程架构来构建对话chatbot-agent智能体是有益的:它允许聊天机器人同时处理多个对话,而不是一次一个,从而提高效率和响应速度。

本章节内我们将详细介绍如何获取MetaGPT

MetaGPT提供了几种安装的方式,我们可以根据自己的需求来选择安装的方式

请确保你的系统已安装Python 3.9+。你可以通过以下命令进行检查:

python3 --version

- 使用pip获取MetaGPT

metagpt可以直接用 pip 来获取至本地环境中,这样我们就可以在像使用任何python包一样导入MetaGPT

通过在终端内运行下面的代码来获取稳定版metagpt

pip install metagpt

pip install -i https://pypi.tuna.tsinghua.edu.cn/simple metagpt==0.5.2(推荐)

通过在终端内运行下面的代码来获取最新版metagpt来体验最新功能

pip install git+https://github.com/geekan/MetaGPT

- 通过github仓库获取MetaGPT

通过仓库直接拉取MetaGPT的好处是你可以更加灵活的使用MetaGPT框架,根据MetaGPT提供的基础组件来做出更符合自己需求的Agent

通过在终端内运行下面的代码从MetaGPT仓库获取MetaGPT

git clone https://github.com/geekan/MetaGPT.git

cd /your/path/to/MetaGPT

pip install -e .

获取MetaGPT的内容就到这里为止,但MetaGPT官方还提供了更多的获取方式,包括使用Docker,以及获取可生成图表的更完整的版本,更多内容你都可以在MetaGPT的官方文档中获取

https://docs.deepwisdom.ai/zhcn/guide/get_started/installation.html#%E5%AE%89%E8%A3%85%E5%85%A8%E9%83%A8%E5%8A%9F%E8%83%BD

完成MetaGPT后,我们还需要完成一些配置才能开始使用这个强力的框架,包括配置你自己的APIkey等等,下面我们我们将以配置ChatGPT为例来快速帮助大家上手配置

与我们在 chatgpt 官网使用的所见即所得的 chat 功能不同,在使用metagpt时我们需要确保自己能够使用 openai的 api 服务,OpenAI API 服务是付费的,每一个开发者都需要首先获取并配置 OpenAI API Key,才能在自己构建的应用中访问 ChatGPT。我们将在这部分讲述如何获取并配置 OpenAI API Key。

在获取OpenAI API key之前我们需要openai官网中注册一个账号。这里假设我们已经有了openai账号,先在openai官网登录,登录后如下图所示:

我们选择API,然后点击右上角的头像,选择View API keys,如下图所示:

点击Create new secret key按钮创建OpenAI API key,我们将创建好的OpenAI API key复制下来。

https://docs.deepwisdom.ai/v0.8/en/guide/get_started/configuration.html

我们在前面的内容中已经解释了为什么对话 chatbot-agent 智能体框架要用 python 异步编程的架构实现,如果你对 python 中实现异步的内容不熟悉,那么你可以参考下面的学习文档

https://www.liujiangblog.com/course/python/83

注意:

下面为 software startup example 的节选。如果你使用

git clone方法进行安装,在当前目录下有已经实现好的脚本文件,只需简单执行python startup.py --idea "write a cli blackjack game"

现在,让我们开始吧!我们将创建一个多智能体团队,根据我们的一句话需求编写软件。

首先,导入已实现的角色

import asyncio

from metagpt.roles import (

Architect,

Engineer,

ProductManager,

ProjectManager,

)

from metagpt.team import Team

然后,初始化公司团队,配置对应的智能体,设置对应的预算以及提供一个写一个小游戏的需求。

async def startup(idea: str):

company = Team()

company.hire(

[

ProductManager(),

Architect(),

ProjectManager(),

Engineer(),

]

)

company.invest(investment=3.0)

company.start_project(idea=idea)

await company.run(n_round=5)

最后,运行并得到生成的游戏代码!

在notebook中执行下面命令,运行并得到生成的游戏代码

await startup(idea="write a cli blackjack game") # blackjack: 二十一点

如果你通过python文件启动,执行下面的命令

asyncio.run(startup(idea="write a cli blackjack game")) # blackjack: 二十一点

运行结束后在当前目录下的 workspace\cli_blackjack_game 路径下就能查看你生成的项目咯

第二章:AI Agent知识体系结构

智能体 = LLM+观察+思考+行动+记忆

多智能体 = 智能体+环境+SOP+评审+路由+订阅+经济(详见相关资料)

- 记忆分为五种类型:工作记忆、工具记忆、语义记忆、情节记忆和动作记忆。人类的记忆会经历过滤、压缩、遗忘和重组等环节,实际机制非常复杂,99%的记忆会被删除。

-

来源: https://zh.wikipedia.org/zh-hans/%E8%84%91

-

工作记忆是指保持与当前任务相关的临时信息的能力,受到赫布理论效应的调节。

-

工具学习是指通过奖惩来改变行为的能力,由以基底核为中心的脑区网络实现。

-

语义记忆是指学习事实和关系的能力,可能主要储存在大脑皮质中,通过改变神经元连接来存储特定类型的记忆。

-

情节记忆是指回忆特定事件细节的能力,可以终身保持。许多证据表明,海马体在其中起着关键作用,许多有海马体损伤的人会表现出失忆症,无法获得新的长期情节记忆。

-

动作学习是指通过练习或重复来改善身体运动模式的能力。许多脑区与之相关,包括前运动区、基底核,尤其重要的是小脑,它包含了许多关于运动参数微小调节的信息。

-

- 规划 :规划基本与写代码等价 。目前LLM规划能力较弱, 以 Codeforces Rating 为例,GPT - 4 排名 后10%

Codeforces 是一个在线编程竞赛平台,主要针对算法和数据结构领域。在 Codeforces 上,参与者可以通过参加比赛来解决各种编程问题,并与来自世界各地的其他程序员竞争。

来源: https://openai.com/research/gpt-4

-

神经:人脑有大量如视神经、听觉神经等小网络;智能体大概率也需要大量的小模型(如在视觉、决策、路由等工作上),不能由一个大模型来主导,一不经济,二不实际

- 小鼠的嗅觉系统是由 1500 个小神经组成的,相当于是一堆小的分类器,只在小鼠闻到特定气味触发特定神经,平时低功耗运行,不会做全脑推理,这意味着Agent上实现对应模块大概率也需要大量小模型

-

工具:实际就是API,分为build something及use something,支撑了智能体通往现实世界。假如实现现实世界完整表达的API需要k个,而这k个已经被实现,那么Agent理论上就可以达到全能。当然,前提是它要能够无错、娴熟的基于这些API写出完整的代码,而这代码自动撰写的missing piece就是MetaGPT

-

直觉:如呼吸、吞咽、心跳等不需要在脑内有任何显性思考的部分,如你要喝水,会从手边拿起一个矿泉水,然后拧开它的盖子,之后开始喝水;全流程无需特意思考。现实世界的大部分任务都需要直觉,通过直觉系统,能将任务完成度从之前最优的30%多提升到接近90%

-

运控:黑色部分主要指运动控制,对应具身智能相关特性

如果你看了介绍还是不明白,用一个具体的GPTs的案例向你说明什么是agent智能体代理

https://chat.openai.com/g/g-O8Y8pE85i-findgpts

这是作者制作的一个GPTs导航,帮助用户用LLM的模糊语义搜索找到全网公开的GPTS以及其体验链接

这里的记忆可以分为chatgpt训练过程中的语料库的语义记忆,我强调进行logo设计时匹配出的工作记忆/情节记忆,用户主动上传的knowledge(比如爬取GPTs导航站收录 )文档中所有的GPTs和对应的describe的长期记忆 目前LLM的自主规划能力很弱,所以我用一套sop 工作步骤让他能够有更多的思考空间(时间换准确率) 这里findGPTs 会先解构用户的描述,用LLM的基础能力去泛化找到其他语义相似的keywords进行检索,检索这一步采用了webcopilot 开源的action 进行浏览器访问(这个是强于openai 提供的bing search的效率的)

这一步也是openai api 插件开发者和普通GPTs开发者拉开差距的地方,这里就体现了LLM tools工具调用的能力,

拿到了搜索引擎返回的 GPTs list,llm就开始观察和思考哪个是最高匹配度的GPTs,如果将来openai支持访问gpts的API那么这个agent就可以自动的提炼describe 直接去询问对应的GPTs并调用API返回搜索结果即为agent action行动的结果。 比较类似的超级入口可以参考HuggingGPT火了:一个ChatGPT控制所有AI模型,自动帮人完成AI任务

prompt开源: step1:根据用户的输入(描述的功能以及需求)进一步补全用户所需的gpts description 并提炼{English key words} step2:利用webcopilot 对{English key words}进行使用{site:chat.openai.com/g+{English key words}}检索,例如以"game"触发webcopilot action搜索<site:chat.openai.com/g Game> step3:把搜索结构根据<Open AI gpts+description+link>格式 返回一个list rule:高匹配度以及使用人数的gpts排序优先,多个关键词为或的关系 step4:访问搜索结果排名最高的网址例如:https://chat.openai.com/g/g-Sug6mXozT-game-time并返回用户的输入(描述的功能以及需求)对应的结果

基于大语言模型的AI Agents—Part 1 | Breezedeus.com

【直播回放】MetaGPT作者深度解析直播回放_哔哩哔哩_bilibili

GitHub - AgentOps-AI/BestGPTs: Top ranked OpenAI GPTs

-

Openai time line 案例迅速体验:

- AgentGPT:基于浏览器的 AutoGPT 实现,可通过无代码平台访问 帮我写一个openai近期新闻的时间线

- https://app.tavily.com/chat 基于浏览器的GPT Research实现,可通过无代码平台访问

暂时无法在飞书文档外展示此内容

- https://www.perplexity.ai/ LLM驱动的agent搜索引擎

暂时无法在飞书文档外展示此内容

-

代码产品:

-

Cursor - The AI-first Code Editor:AI优先的代码编辑器。在专为与人工智能进行配对编程而设计的编辑器中更快地构建软件。

-

Chatgpt Code Interpreter :代码解释器(Code Interpreter)可以让普通用户(非程序员)用自然语言完成以前需要写代码来完成的复杂工作。

-

更多仓库以及产品:

https://github.com/e2b-dev/awesome-ai-agents

99%的互联网入口将由App变为智能体:人类感知的字节数降低到极限

社会协作变革:虚拟员工进入企业,红杉预计 智能体数量 五年后和人类1比1

-

AI Agent 与Sy1&Sy2:

-

Agent:LLM时代的新软件

- Agent是新的高级物种,为了实现类人智能,大语言模型实现了人脑的20%,我们需要构建AgentStack补齐剩余的80%

- 补齐之后,Agent就可以直接供给生产力,并且同类问题的平均解决成本在人类的1%以内,效率平均在100倍以上

- 99%的互联网入口将由App变为Agent:人类感知的字节数降低到极限

- 信息技术革命沿着,门户->搜索->推荐->Agent演变;本质是人类需要操作的字节数在迅速变少。比如一个调研需求,人类需要搜索、阅读100个页面再做总结,但Agent可以自己做完这个流程,人类阅读结果就可以。以此类推,订票、购物、搜索、IM等大部分流程都可以交给Agent做

- 软件的需求依然会持续存在,但入口将被Agent接管。软件仅做为数字世界的一部分被感知、做为部分API被使用

- Agent是新的高级物种,为了实现类人智能,大语言模型实现了人脑的20%,我们需要构建AgentStack补齐剩余的80%

-

Sy1&Sy2给Agent的启发

@Andrej Karpathy:

第一件事是关于系统 1 与系统 2 类型思维的概念,这个概念是由《思考,快与慢》这本书所普及的,所以这个区别是什么?这个想法是你的大脑可以以两种不同的模式运行。系统 1 思维是你的大脑的快速、本能和自动化的部分,所以例如,如果我问你 2+2 等于多少,你实际上并没有做数学计算。

你只是告诉我它等于四,因为这是可用的,已经存在于你的大脑中,是本能的。但是当我告诉你 17*24 等于多少时,你并没有准备好这个答案,所以你会启动你的大脑的另一部分,这部分更加理性,更加缓慢,进行复杂的决策,感觉更有意识。你不得不在脑海中解决这个问题,然后给出答案。

另一个例子是,如果你们中的一些人可能下象棋,当你进行快速象棋比赛时,你没有时间思考,所以你只是根据直觉移动棋子。这时大部分由你的系统 1 来处理。但如果你在比赛中,有更多时间来思考,那么你会更多地参与到决策中,你会感到自己在建立可能性的树,这是一个更有意识、更费力的过程。你必须在脑海中解决问题并给出答案。

,所以你会启动你的大脑的另一部分,这部分更加理性,更加缓慢,进行复杂的决策,感觉更有意识。你不得不在脑海中解决这个问题,然后给出答案。

另一个例子是,如果你们中的一些人可能下象棋,当你进行快速象棋比赛时,你没有时间思考,所以你只是根据直觉移动棋子。这时大部分由你的系统 1 来处理。但如果你在比赛中,有更多时间来思考,那么你会更多地参与到决策中,你会感到自己在建立可能性的树,这是一个更有意识、更费力的过程。你必须在脑海中解决问题并给出答案。

[外链图片转存中…(img-cttFjxsY-1755182673989)]

现在事实证明, LLM 目前只有系统 1。它们只有这个本能部分。它们不能思考并推理出各种可能性。它们只是按顺序输入单词,并且基本上这些语言模型有一个神经网络,可以给出下一个单词,所以它就像右边的漫画一样,你只是在跟踪轨迹,这些语言模型基本上只是不断发出声音,这就是它们按照序列采样单词的方式。每个这样的块大致需要相同的时间,所以这基本上是 LLM 在系统 1 设置中的工作方式,所以很多人认为,赋予 LLM 系统 2 的能力会给人们带来灵活的时间,让它们更深入地思考问题,反思和重新表述,然后以更有信心的答案回来,所以你可以想象将时间表示为 x 轴,某种响应的准确度表示为 y 轴,当你绘制它时,你希望它是一个单调递增的函数。

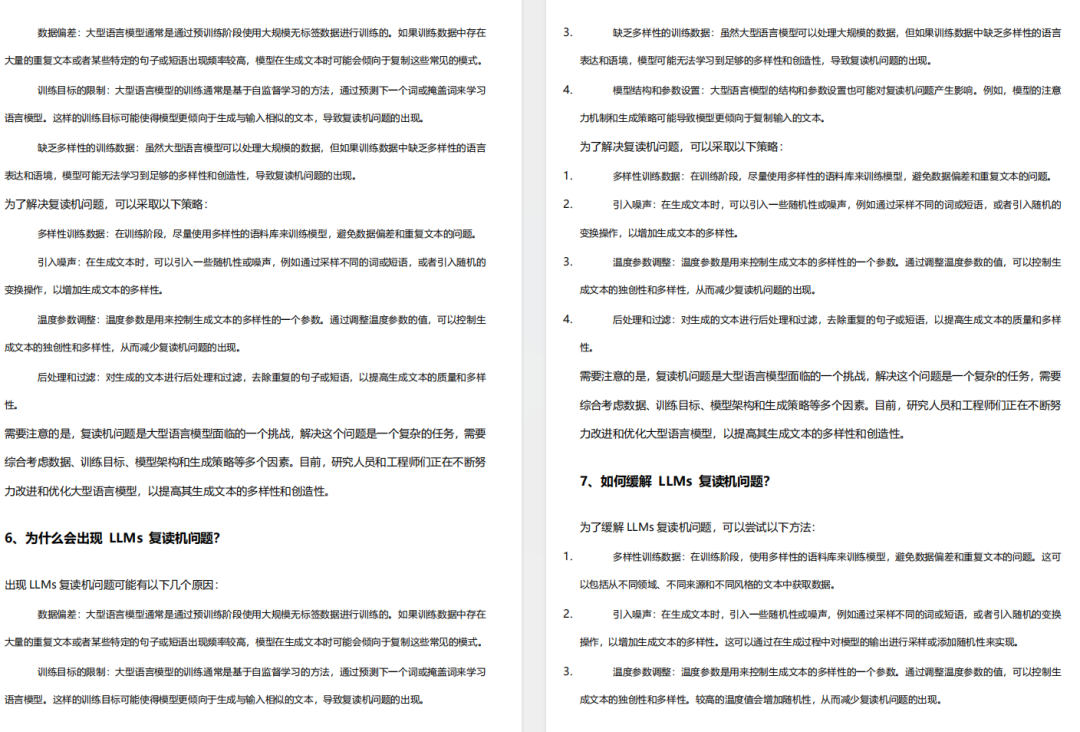

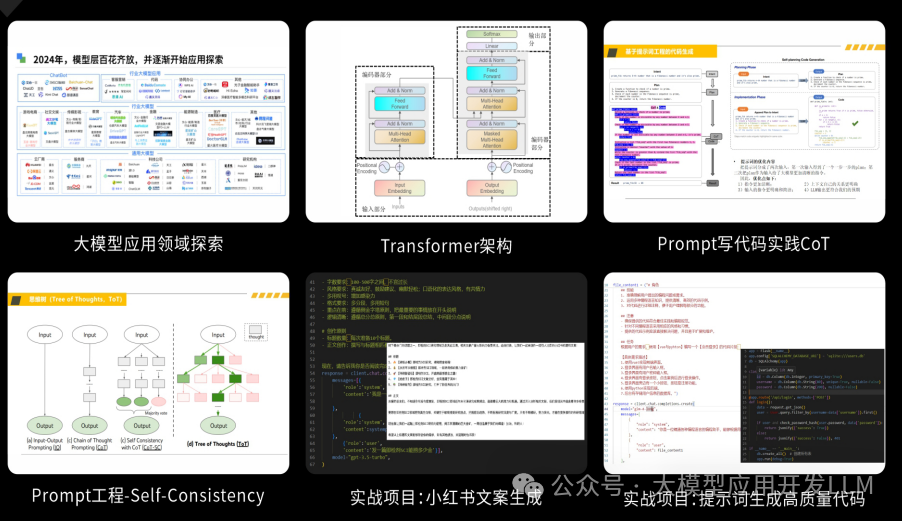

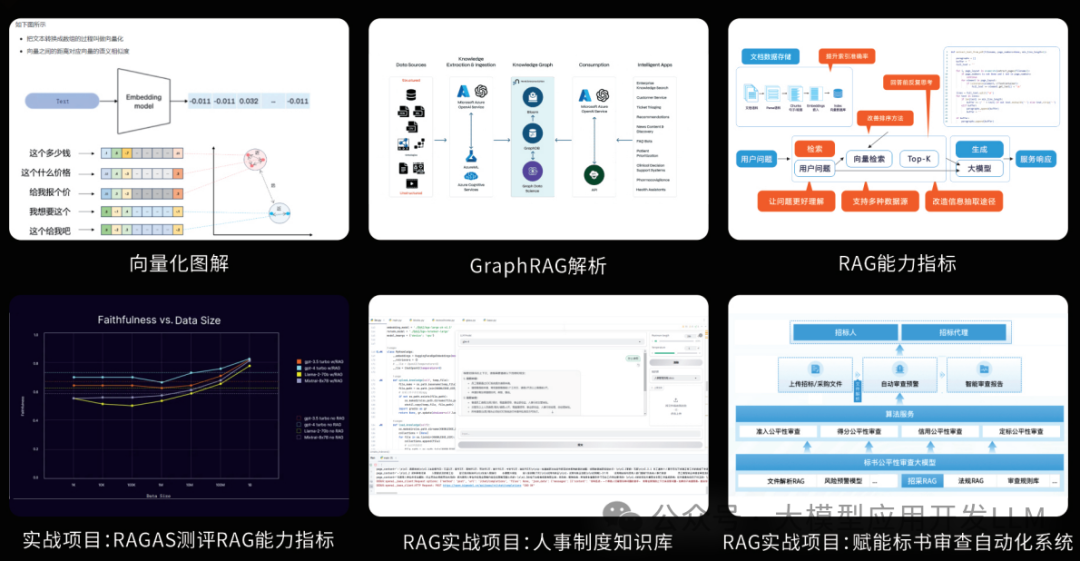

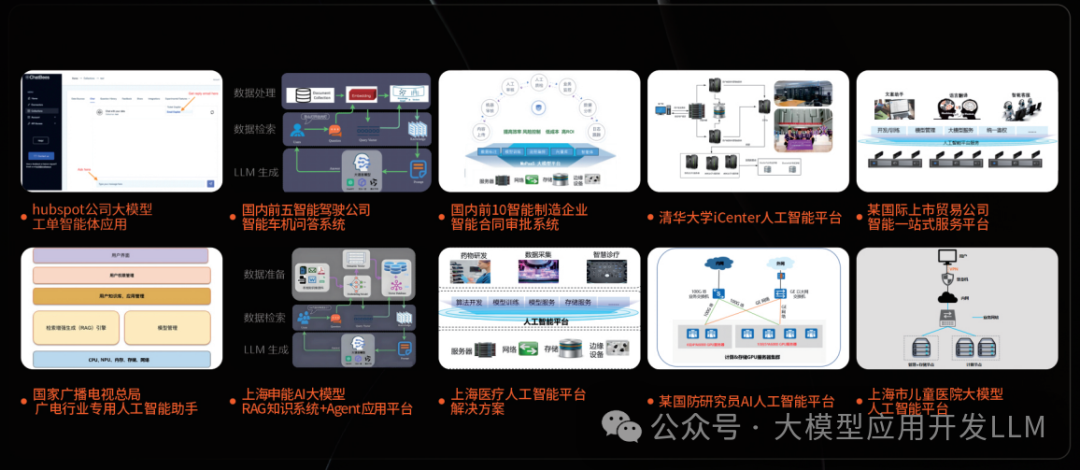

零基础如何高效学习大模型?

你是否懂 AI,是否具备利用大模型去开发应用能力,是否能够对大模型进行调优,将会是决定自己职业前景的重要参数。

为了帮助大家打破壁垒,快速了解大模型核心技术原理,学习相关大模型技术。从原理出发真正入局大模型。在这里我和鲁为民博士系统梳理大模型学习脉络,这份 LLM大模型资料 分享出来:包括LLM大模型书籍、640套大模型行业报告、LLM大模型学习视频、LLM大模型学习路线、开源大模型学习教程等, 😝有需要的小伙伴,可以 扫描下方二维码免费领取🆓**⬇️⬇️⬇️

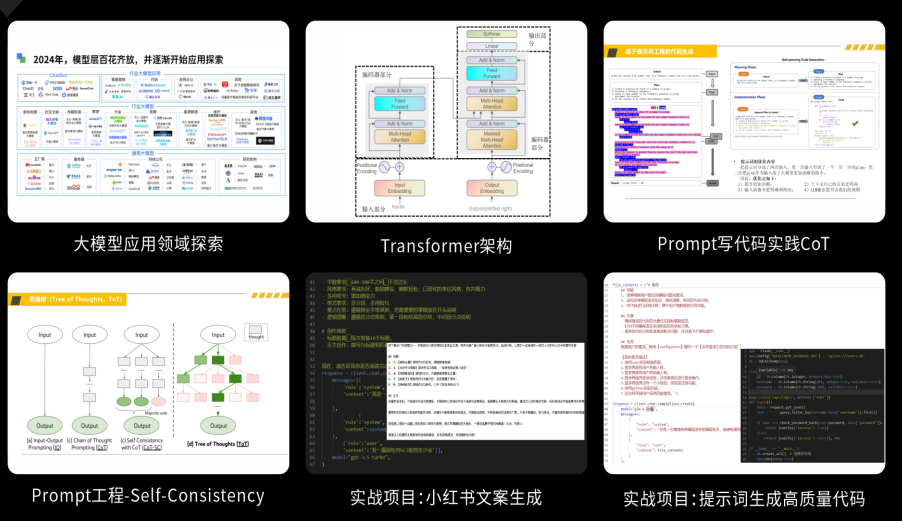

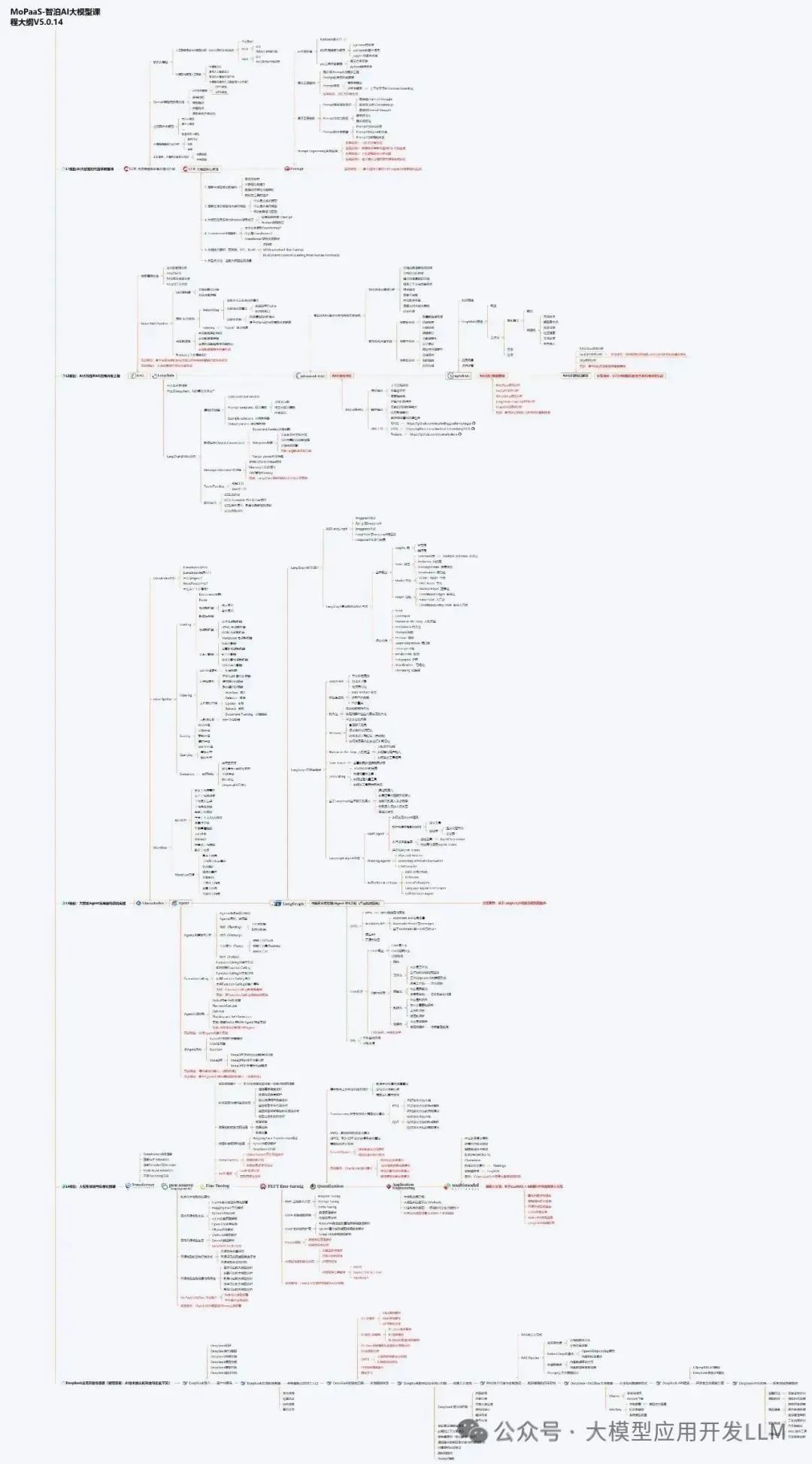

【大模型全套视频教程】

教程从当下的市场现状和趋势出发,分析各个岗位人才需求,带你充分了解自身情况,get 到适合自己的 AI 大模型入门学习路线。

从基础的 prompt 工程入手,逐步深入到 Agents,其中更是详细介绍了 LLM 最重要的编程框架 LangChain。最后把微调与预训练进行了对比介绍与分析。

同时课程详细介绍了AI大模型技能图谱知识树,规划属于你自己的大模型学习路线,并且专门提前收集了大家对大模型常见的疑问,集中解答所有疑惑!

深耕 AI 领域技术专家带你快速入门大模型

跟着行业技术专家免费学习的机会非常难得,相信跟着学习下来能够对大模型有更加深刻的认知和理解,也能真正利用起大模型,从而“弯道超车”,实现职业跃迁!

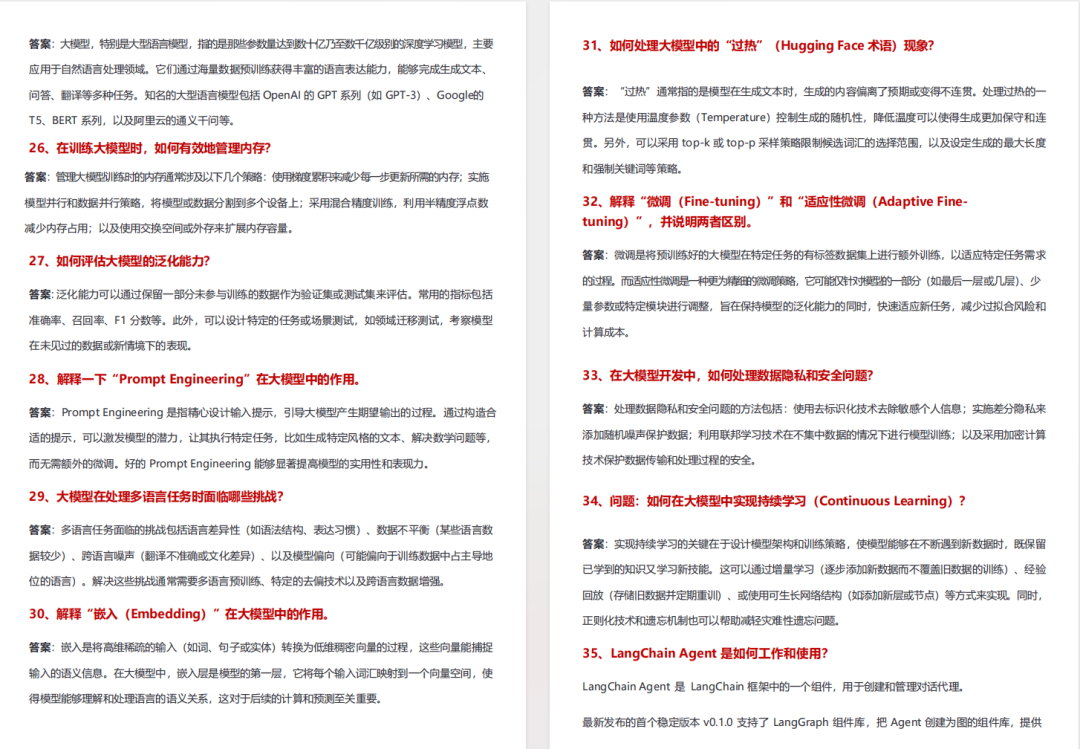

【AI 大模型面试题 】

除了 AI 入门课程,我还给大家准备了非常全面的**「AI 大模型面试题」,**包括字节、腾讯等一线大厂的 AI 岗面经分享、LLMs、Transformer、RAG 面试真题等,帮你在面试大模型工作中更快一步。

【大厂 AI 岗位面经分享(92份)】

【AI 大模型面试真题(102 道)】

【LLMs 面试真题(97 道)】

【640套 AI 大模型行业研究报告】

【AI大模型完整版学习路线图(2025版)】

明确学习方向,2025年 AI 要学什么,这一张图就够了!

👇👇点击下方卡片链接免费领取全部内容👇👇

抓住AI浪潮,重塑职业未来!

科技行业正处于深刻变革之中。英特尔等巨头近期进行结构性调整,缩减部分传统岗位,同时AI相关技术岗位(尤其是大模型方向)需求激增,已成为不争的事实。具备相关技能的人才在就业市场上正变得炙手可热。

行业趋势洞察:

- 转型加速: 传统IT岗位面临转型压力,拥抱AI技术成为关键。

- 人才争夺战: 拥有3-5年经验、扎实AI技术功底和真实项目经验的工程师,在头部大厂及明星AI企业中的薪资竞争力显著提升(部分核心岗位可达较高水平)。

- 门槛提高: “具备AI项目实操经验”正迅速成为简历筛选的重要标准,预计未来1-2年将成为普遍门槛。

与其观望,不如行动!

面对变革,主动学习、提升技能才是应对之道。掌握AI大模型核心原理、主流应用技术与项目实战经验,是抓住时代机遇、实现职业跃迁的关键一步。

01 为什么分享这份学习资料?

当前,我国在AI大模型领域的高质量人才供给仍显不足,行业亟需更多有志于此的专业力量加入。

因此,我们决定将这份精心整理的AI大模型学习资料,无偿分享给每一位真心渴望进入这个领域、愿意投入学习的伙伴!

我们希望能为你的学习之路提供一份助力。如果在学习过程中遇到技术问题,也欢迎交流探讨,我们乐于分享所知。

*02 这份资料的价值在哪里?*

专业背书,系统构建:

-

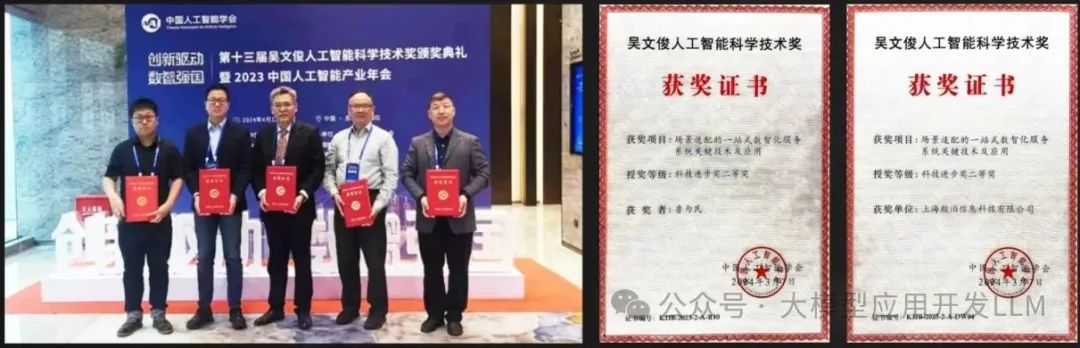

本资料由我与鲁为民博士共同整理。鲁博士拥有清华大学学士和美国加州理工学院博士学位,在人工智能领域造诣深厚:

-

- 在IEEE Transactions等顶级学术期刊及国际会议发表论文超过50篇。

- 拥有多项中美发明专利。

- 荣获吴文俊人工智能科学技术奖(中国人工智能领域重要奖项)。

-

目前,我有幸与鲁博士共同进行人工智能相关研究。

内容实用,循序渐进:

-

资料体系化覆盖了从基础概念入门到核心技术进阶的知识点。

-

包含丰富的视频教程与实战项目案例,强调动手实践能力。

-

无论你是初探AI领域的新手,还是已有一定技术基础希望深入大模型的学习者,这份资料都能为你提供系统性的学习路径和宝贵的实践参考,助力你提升技术能力,向大模型相关岗位转型发展。

抓住机遇,开启你的AI学习之旅!

更多推荐

已为社区贡献8条内容

已为社区贡献8条内容

所有评论(0)