【论文翻译】Embodied navigation-具身导航

具身导航是一种新兴的导航范式,通过物联网(IoT)和人工智能(AI)技术,使移动物体能够与物理世界交互,获取局部地图、定位物体并优化导航路线。本文系统综述了具身导航的研究进展,涵盖感知、导航、效率优化及其赋能的任务。感知部分探讨了几何感知和语义理解,导航部分分析了基于几何和学习增强的方法,效率优化部分讨论了延迟、能效和鲁棒性改进策略。具身导航赋能的任务包括自动驾驶、辅助机器人、仿生应用等。尽管具身

摘要

导航是现代信息应用系统的基本组成部分,其应用范围涵盖军事、交通、物流乃至探索等领域。传统导航依赖于绝对坐标系统,该系统提供物理世界的精确地图、移动物体的位置以及优化的导航路线。近年来,许多新兴应用对导航提出了新的需求,例如,在没有GPS或其他定位手段的水下/地下导航、无地图的未探索区域导航以及没有特定路线的任务导向型导航。物联网(IoT)和人工智能(AI)的进步使我们能够设计新的导航范式——具身导航,它允许移动物体与物理世界交互以获取局部地图、定位物体并相应地优化导航路线。我们对具身导航的研究进行了系统而全面的综述,涵盖了感知、导航和效率优化等关键方面。除了这些领域的进展之外,我们还研究了由具身导航赋能的新兴任务,这些任务需要在多样化且不断变化的环境中实现灵活的移动性。此外,我们识别了在现实世界中部署具身导航系统所面临的挑战,并将其扩展到更广泛的领域。我们旨在通过本文为这一快速发展的领域提供有价值的见解,促进未来的研究以弥合现有差距,并推动基于具身导航的通用自主系统的发展。

关键词:人工智能,物联网,具身人工智能,导航,感知,大语言模型 (LLM)

1 引言

导航一直是自主系统(如机器人 [1,2]、自动导引车 (AGV) [3–5]、无人机 (UAV) [6–8])的一项基本能力,用于在复杂环境 [9–14] 中完成各种任务,包括家政服务、包裹配送和灾难救援。导航系统基于对环境的认知来定位自身、规划路径并向目标位置导航,同时避开潜在障碍物。这样一个复杂的过程需要感知、决策和运动控制的深度集成,所有这些对于此类系统在真实世界场景中的成功部署至关重要。

随着对能够在多样化和复杂环境中自主运行的更智能、更有能力和更通用的机器的需求日益增强,导航任务的范围和复杂性也相应发展。导航已经从工厂和仓库等结构化环境中用于基本自动化的基于路标点的导航,发展到利用基于视觉的感知进行即时定位与地图构建 (SLAM) [15–17],从而在没有预定义路径的动态环境中导航。随着人工智能 (AI) 的进步,人类对自主系统的期望从基本导航演变为执行复杂的、目标导向的任务。现代导航系统现在被期望执行超越单纯移动的高级功能。例如,自动驾驶汽车不仅要为交通运输而导航,还必须遵守交通法规并确保乘客安全;服务机器人被期望在家庭和办公室自主导航,以协助完成清洁、整理或取物等任务。然而,人工智能的进步主要由大规模学习人工筛选的静态互联网数据驱动,这虽然在图像识别、语音合成和文本理解等任务中取得了显著改进,但复杂的导航任务对于人工智能代理仍然是一个严峻的挑战。具身导航强调与物理世界的交互,是这一追求中的一个关键前沿。与静态数据驱动的导航系统不同,具身导航系统必须在不同的任务目标下,有时甚至在人类指令 [18] 的指导下,持续感知并响应动态的、通常不可预测的环境。

我们旨在对具身导航的研究进行系统而全面的综述。关于具身导航的文献主要分为四个方面:感知、导航、效率优化以及具身导航赋能的任务。

-

感知 (Perception)。感知为导航系统的后续规划和控制阶段奠定了基础。在第2节中,我们回顾了具身导航系统的感知模型,这些模型利用不同的传感器和传感模式来感知和解释其周围环境。这可以细分为几何感知(侧重于理解环境的空间布局和结构)和语义理解(涉及识别环境中的物体和场景,同时推理它们之间的相互关系以及它们与导航目标的关系)。

-

导航 (Navigation)。它包括代理在复杂环境中导航的动作规划和运动控制(本文更侧重于前者)过程,这是导航系统的核心。第3节深入探讨了各种导航方法,这些方法反映了研究人员为引导代理在物理环境中实现特定目标所采用的不同策略,主要分为两类方法:基于几何的方法(利用传统的地图构建和定位技术)和学习增强的方法(利用机器学习的进步来增强导航能力)。

-

效率优化 (Efficiency optimization)。为了在许多导航系统运行的资源限制下满足复杂导航任务的性能要求,针对具身导航的专门效率优化至关重要。第4节讨论了延迟优化、能效优化和鲁棒性改进的各种策略,这些对于这些系统在实际应用中的部署至关重要。

-

具身导航赋能的任务 (Embodied navigation enabled tasks)。凭借具身导航的先进能力,可以推动那些需要在多样化变化环境中实现灵活移动性的新兴任务。在第5节中,我们回顾了由具身导航赋能的具体任务,包括自动驾驶、通用辅助机器人、仿生应用的导航以及微环境中的导航。这些应用中的每一个都带来了独特的挑战和机遇,突显了具身导航系统的多样化潜力。

尽管具身导航前景广阔,并且近年来取得了重大进展,但仍有许多重要领域需要进一步改进和深入研究。在本文末尾,我们还将讨论这些关键问题,强调那些持续阻碍具身导航潜力完全实现的局限性和开放性问题。尽管取得了进步,但诸如真实世界适用性、多智能体协作、仿生神经架构以及围绕安全和隐私的担忧等挑战仍然构成重大障碍。必须解决这些挑战,以推动该领域向前发展,并实现研究人员和实践者共同期望的强大、通用的系统。

2 感知

在本节中,我们首先在 2.1 小节介绍具身导航的一些理论基础。在这些基础之上,对周围环境和智能体的感知为后续的规划和控制阶段提供了支持。在 2.2 小节中,我们回顾了几何感知任务,其主要目标是通过处理一个或多个传感器的数据来重建环境的几何结构和/或定位智能体或目标。由于对环境的高层次理解能够支持更复杂的导航任务,例如目标导航和视觉导航,近期的许多工作都致力于构建环境的语义或隐式表示。此外,这些超语义表示在鲁棒性和存储效率方面更具优势。我们在 2.3 小节中将获取这些超语义表示以及利用此类表示定位智能体的过程视为超语义感知。

2.1 理论基础

首先,我们简要回顾传统导航的理论基础。随后,我们介绍由具身智能体的感知数据所构成的感知空间。我们将证明感知空间是一个完备的赋范向量空间,具体来说是一个巴拿赫空间。它在导航方面与物理世界以及 R 3 R^3 R3是一致的。此外,我们还将给出感知空间的一些性质。

2.1.1 传统导航的基础

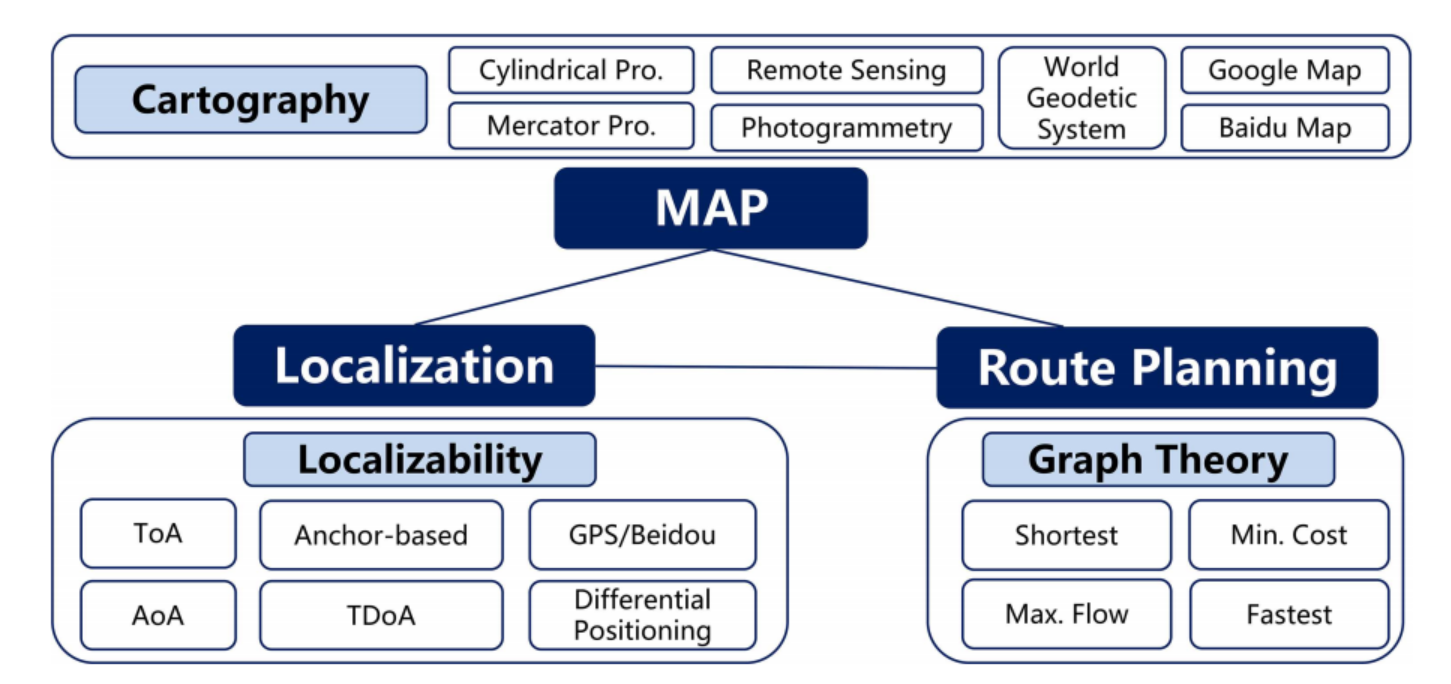

传统导航基于三个理论基础及相关技术。如图1所示,地图制图学致力于地图的创建,采用圆柱投影、墨卡托投影、摄影测量学、遥感技术、世界测量系统以及其他地理信息系统(GIS)。定位技术利用三角测量法来确定具身智能体在地图上的位置。定位的例子包括导航卫星系统(GPS、北斗、GNSS等)、差分全球定位系统(DGPS)、带有锚节点的信标、基于到达时间(ToA)、到达时间差(TDoA)和到达角(AoA)的三角测量。利用地图和智能体在地图上的实时位置,应用图论来指导智能体的移动路线。采用各种优化目标来生成不同的路线,例如最短路径、最大流量、最小路径成本以及最快路线。

图1 (彩图)传统导航的基础与相关技术。

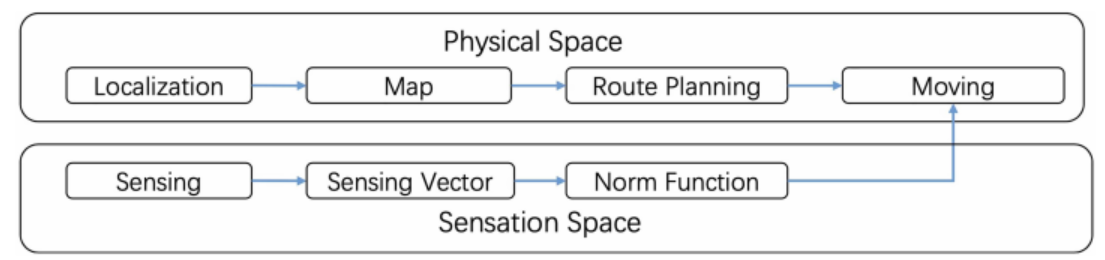

图2 (彩图)智能体关于感知空间和物理空间的工作流程。

2.1.2 感知空间(向量空间)

在移动过程中,移动智能体通过卫星信号或无线信号强度等感知能力获取环境信息。它获取一张通常预先构建的地图,在地图上定位自身,并采用路径优化算法来指导其实时移动。这一工作流程如图2所示。根据多年的实践经验,这种方法是充分且有效的,但仍存在一个悬而未决的问题:这是导航唯一必要的方式吗?

我们可以观察到,感知数据实质上引导着智能体的移动,而不是在导航之前确定的地图或路由算法。仅凭感知数据,即使没有映射到物理世界,也可能足以引导移动。为了很好地回答这个问题,我们有以下观察。

定义1(感知空间)。假设移动智能体配备了某种感知能力,能够持续提供感知数据。感知数据是来自各种来源的多模态数据,例如无线信号(信号强度、信号幅度、信号相位、TDoA)、加速度计、陀螺仪和摄像头(图像及参数)。不失一般性,我们将这些感知数据表示为一个数据向量 s = ( s 1 , s 2 , … , s n ) s = (s_1, s_2, \dots, s_n) s=(s1,s2,…,sn),并有以下定理。

定理1(感知数据 s s s 构成一个向量空间 S S S)。为了证明感知数据 s s s 构成一个向量空间 S S S,我们有以下陈述:

- 交换律。对于所有感知向量 x , y ∈ S x, y \in S x,y∈S,有 x + y = y + x x + y = y + x x+y=y+x。

- 结合律。对于所有向量 x , y , z ∈ S x, y, z \in S x,y,z∈S,有 x + ( y + z ) = ( x + y ) + z x + (y + z) = (x + y) + z x+(y+z)=(x+y)+z。

- 加法单位元。对于任何向量 x ∈ S x \in S x∈S,向量空间包含加法单位元 0 0 0,使得 0 + x = x + 0 = x 0 + x = x + 0 = x 0+x=x+0=x。

- 加法逆元。对于每个向量 x ∈ S x \in S x∈S,存在一个 − x ∈ S -x \in S −x∈S,使得 − x + x = 0 -x + x = 0 −x+x=0。

- 分配律。 c ( x + y ) = c x + c y c(x + y) = cx + cy c(x+y)=cx+cy 且 ( x + y ) c = c x + c y (x + y)c = cx + cy (x+y)c=cx+cy。

- 标量乘法结合律。 c ( d x ) = c d x c(dx) = cdx c(dx)=cdx。

- 单位元。 1 x = x 1x = x 1x=x。

请注意,为了保持感知数据在物理世界中的物理意义,向量空间 V V V 中的附加运算可能与物理世界 R R R 中的运算不同。例如,来自图像的感知数据应转换到频率空间进行运算。红色加蓝色可能会产生紫色,这违反了附加运算的封闭性。因此,红色和蓝色都应转换到相应的频率和强度,在频率空间中相加,然后再转换回颜色空间中的紫色。

感知空间中的范数。为了在感知空间中导航,我们需要在感知空间 S S S 中定义范数。该范数应与物理空间一致,从而使两个空间中的导航也保持一致。在实践中,由于感知向量是在物理世界中获得的,因此感知空间 S S S 中的每个感知向量 x x x 仅与物理空间 R R R 中的一个物理位置 r r r 相关联。令 f : S → R f : S \rightarrow R f:S→R 为从感知空间 S S S 到物理世界空间 R R R 的映射函数。我们在 S S S 中定义范数函数 D D D 如下:

∀ x ∈ S , D ( x ) = ∣ f ( x ) ∣ 2 , (1) \forall x \in S, D(x) = |f(x)|_2, \tag{1} ∀x∈S,D(x)=∣f(x)∣2,(1)

其中 ∣ ⋅ ∣ 2 |\cdot|_2 ∣⋅∣2 是 l 2 l_2 l2 范数。根据向量空间中的定理, ∀ x , y ∈ S , d ( x , y ) = ∣ D ( x ) − D ( y ) ∣ \forall x, y \in S, d(x, y) = |D(x) - D(y)| ∀x,y∈S,d(x,y)=∣D(x)−D(y)∣ 在 S S S 上定义了一个度量。并且该度量与 R R R 中的欧几里得距离是一致的。

2.1.3 感知子空间的等距性

感知空间是一个巴拿赫空间,即一个完备的向量空间。由于其基数远大于物理空间 R 3 R^3 R3,根据向量空间的定理,我们有以下推论:

- 存在一个感知子空间,它与 R 3 R^3 R3 等距。找到这样的子空间的关键是定义一个保距映射函数 f f f,使得对于任何 x , y ∈ S x, y \in S x,y∈S,有 d S ( x , y ) = d R 3 ( f ( x ) , f ( y ) ) d_S(x, y) = d_{R^3}(f(x), f(y)) dS(x,y)=dR3(f(x),f(y))。

- 保距映射函数 f f f 是单射的,否则两个不同的点(例如 a a a 和 b b b)可能被映射到同一点,这与度量的重合公理(即 d ( a , b ) = 0 当且仅当 a = b d(a, b) = 0 \text{ 当且仅当 } a = b d(a,b)=0 当且仅当 a=b)相矛盾。此外,偏序集之间的保序嵌入也是单射的。显然,感知子空间与物理世界之间的等距性是一种拓扑嵌入。

- 在实践中,物理空间中的每个点,如果可以在导航过程中使用,都将具有相应的感知数据。因此,等距函数 f f f 是双射的,即全局等距,并且具有反函数。

- 每个时间序列 { r ( t ) } ∈ R \{r(t)\} \in R {r(t)}∈R 都有相应的 { s ( t ) = f ( r ( t ) ) } ∈ S \{s(t) = f(r(t))\} \in S {s(t)=f(r(t))}∈S,使得 d ( r ( t 1 ) , r ( t 2 ) ) = d ( f ( r ( t 1 ) ) , f ( r ( t 2 ) ) ) d(r(t_1), r(t_2)) = d(f(r(t_1)), f(r(t_2))) d(r(t1),r(t2))=d(f(r(t1)),f(r(t2)))。

2.2 几何感知

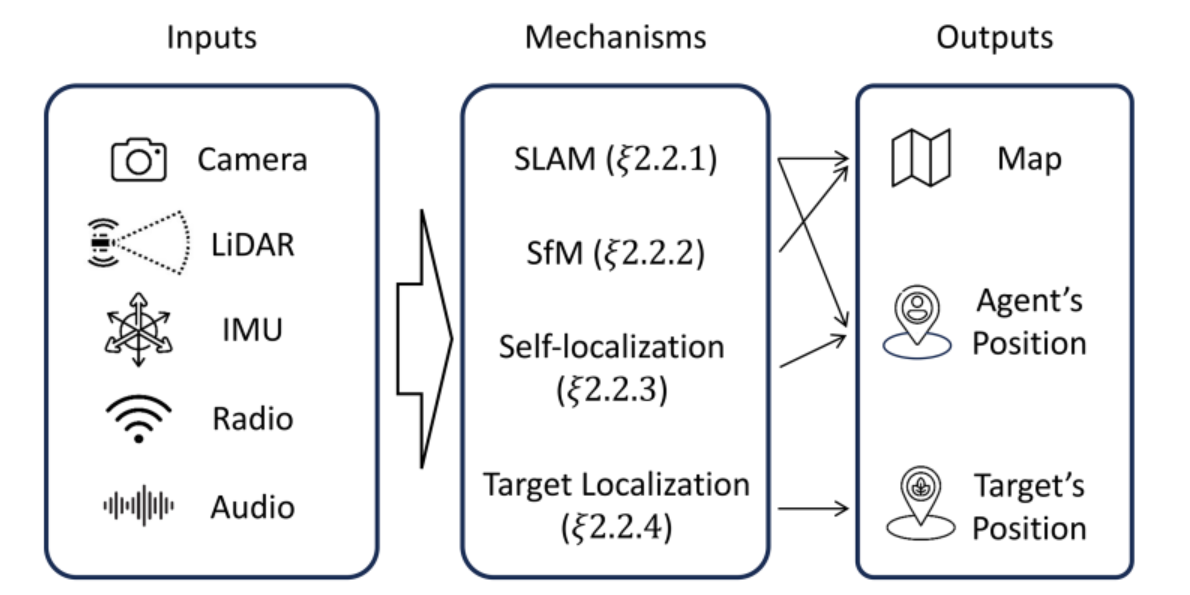

几何感知旨在重建环境的三维/二维几何结构,并获取智能体或导航目标的几何位置。如图3所示,几何感知可以使用不同的传感器来实现,并且存在四种具有不同输出的几何感知机制。第一种机制是即时定位与地图构建(SLAM)(参见2.2.1小节),其中智能体试图实时地同时构建环境地图并在地图中定位自身。SLAM使具身智能体能够自主地在未知环境中导航。第二种是运动恢复结构(SfM)(参见2.2.2小节),其目标是基于一个或多个智能体捕获的无序帧集来重建大规模环境的几何结构。与SLAM相比,SfM可以实现更高的重建精度,并且由于其对重建时间的更宽松要求,支持更大环境的重建。第三种是自定位(参见2.2.3小节),其中智能体旨在在已知环境中定位自身,该环境的几何地图由其他智能体上的SLAM程序或预先通过SfM构建。最后一种是目标定位(参见2.2.4小节),其中智能体旨在定位导航目标。

图3 几何感知。

2.2.1 SLAM

SLAM指的是同时构建环境的几何地图(即建图)并在自主生成的地图中定位智能体(即定位)的过程。它允许配备摄像头的智能体在不依赖任何人工制作的地图或预先部署的基础设施的情况下,实时自动理解未知环境。里程计、回环检测和后端是SLAM中三个最重要的子过程。里程计通过分析输入序列专注于局部建图和定位;回环检测用于检测智能体是否到达先前访问过的位置;后端模块则进一步优化前端模块(即里程计和回环检测)的结果,以最大化后验概率为目标。

过程 I. 里程计 (Odometry)。

我们根据其底层的传感器模态对不同的里程计方法进行分类。

- 视觉里程计 (Visual odometry)。在这一部分,我们首先介绍两种经典的视觉里程计方法,即特征点法和直接法。由于经典方法存在一些挑战,许多基于深度学习的方法被提出来应对这些挑战。我们还系统地回顾了这些基于深度学习的技术。

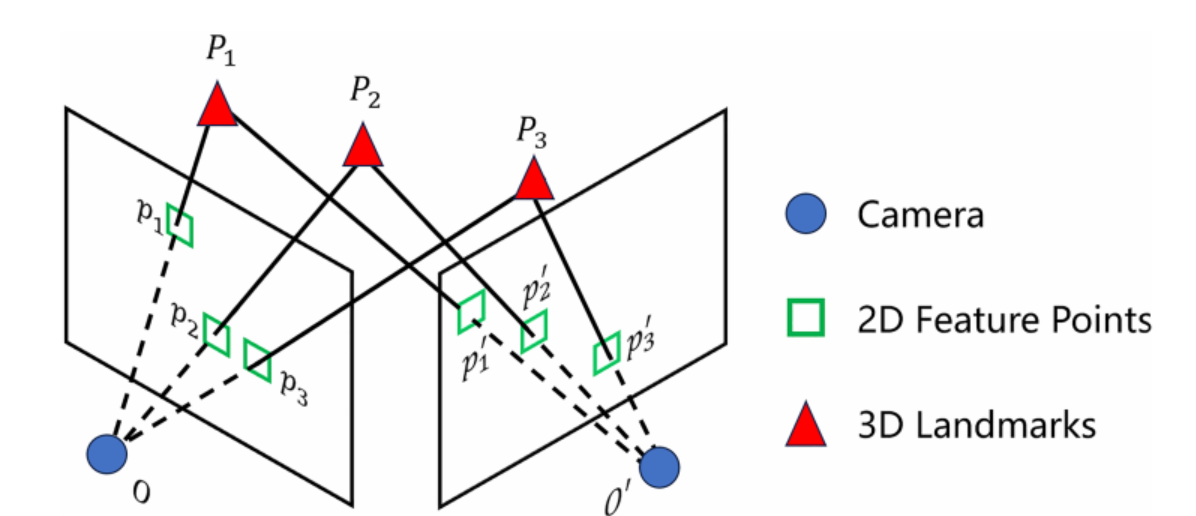

特征点法的工作流程如图4所示。首先,从每一帧中提取像SIFT [19]、SURF [20]和ORB [21]这样的特征。特征通常是在多个图像中可检测到的角点,由一个关键点(位置)和一个描述子(周围图像信息)组成。在单目视觉SLAM中,关键点是二维坐标,而在双目或RGB-D SLAM中,如果深度感知失败,它们可以是带有深度的三维点或二维点 [22]。然后使用特征描述子在帧之间或与地图上的三维路标点匹配关键点。假设匹配的关键点对应于静态物体,通过最小化这些关键点的重投影误差来估计相机位姿。常用方法包括对极几何(二维-二维匹配)、迭代最近点(ICP)(三维-三维匹配)和PnP(三维-二维匹配)。最后,通过三角测量等方法确定二维关键点的深度,以在地图上创建新的三维路标点。

另一种常用的视觉里程计方法是直接法。直接法不是匹配提取的特征,而是通过最小化光度误差来直接估计不同帧之间的相对位姿。尽管直接法在效率、对无特征场景的鲁棒性以及构建稠密或半稠密几何地图的能力方面具有优势,但它严重依赖光度不变性假设,并且可能比特征点法更容易受到光照变化或复杂光照场景的影响。

尽管这两种方法在许多场景中都能很好地工作,但它们在动态场景和光照/天气条件下的鲁棒性较弱。传统方法 [15,23–31] 已被提出来通过优化亮度/光度信息来解决这个问题。然而,这些手工策略带来的鲁棒性提升相对有限。为了应对这些挑战,许多深度学习方法得到了发展。为了处理动态场景,研究人员提出通过语义分割来识别非刚性上下文,然后从视觉里程计使用的特征或像素集中剔除非刚性上下文的点。在非刚性上下文剔除(NRCC)方面的一项早期工作是Pair-Navi [32],这是一个基于视觉SLAM中领导者和跟随者之间轨迹共享的点对点室内导航系统。后来一个名为EdgeSLAM [33] 的系统通过策略性地将NRCC任务卸载到强大的边缘服务器,使得该过程能够在资源受限的移动设备上运行。针对动态光照/天气条件的挑战,最近的研究提出用深度特征描述子 [34, 35] 替换原始的强度值或手工制作的描述子。

图4 (彩图)基于对极几何的特征点法示例。相机连续拍摄两帧图像,其位姿从 O 变为 O′。首先,从这两帧图像中总共检测到六个特征点(即 p1, p2, p3, p′1, p′2, p′3)。利用特征描述子,生成了三对匹配的特征,包括 (p1, p′1), (p2, p′2) 和 (p3, p′3)。对极几何假设每一对匹配特征对应一个坐标未知的静态三维路标点。在此假设下,可以获得 O′ 和 O 之间的相对相机位姿。最后,通过三角测量获得三维路标点(P1, P2 和 P3)的坐标。

-

LiDAR里程计 (LiDAR odometry)。基于深度学习的视觉SLAM已经取得了进展,但基于光探测和测距(LiDAR)的SLAM由于其在雾天和光照变化等挑战性条件下的更佳性能而在工业界很受欢迎 [16]。LiDAR创建点云,点云是具有精确角度和距离数据的点的集合。它通过发射激光束并测量其返回时间来工作 [17]。LiDAR里程计通过匹配不同时间的点云地图中的特征来计算运动。LiDAR系统有二维和三维类型:二维用于简单的室内空间,而三维更适合具有更多空间信息的复杂室外区域。

处理LiDAR里程计的关键是扫描匹配,它通过分析连续的LiDAR点云地图扫描来确定智能体的位置。与视觉里程计类似,根据扫描匹配的执行方式,LiDAR里程计可分为 (i) 直接法,(ii) 基于特征的方法,以及 (iii) 基于深度学习的方法 [36]。

直接法是一种通过直接比较从LiDAR扫描获得的点云数据来估计运动的方法。与其他匹配方法(如特征法)不同,直接法避免从点云中提取特定特征。相反,它利用整个点云数据进行对齐。这些方法的主要目标是通过最小化连续点云之间的几何差异来估计传感器的运动轨迹 [37]。LiDAR里程计的两种主流直接法是:迭代最近点(ICP)和正态分布变换(NDT)。ICP迭代地将一个点云中的点与另一个点云中最近的点进行匹配,并更新变换以最小化对应点之间的距离,直到收敛 [38]。它简单有效,但对初始对齐和噪声敏感。

LiDAR里程计中的基于特征的方法从点云中提取并匹配不同的特征来估计运动。它们专注于特定的几何结构,如边缘、角点或平面,与使用整个点云的直接法相比,提高了效率和准确性。这些特征在连续扫描之间进行匹配,以确定相对运动。LOAM [39, 40] 是一种流行的方法,它提取边缘和平面特征,并通过匹配它们来估计运动和构建地图。它在实时性能和准确性之间取得了平衡。LeGO-LOAM [41] 是LOAM针对地面车辆的扩展,它优化了特征提取和匹配,针对平坦地面以提高效率。R-LOAM [42] 通过结合参考对象的先验知识进一步扩展了LOAM,以提高定位精度。它使用已知的三维模型及其全局位置,将网格特征添加到点特征中进行优化。R-LOAM采用轴对齐包围盒树进行高效的网格特征匹配,减少了绝对姿态误差并提高了地图质量。

用于LiDAR里程计的深度学习方法越来越受欢迎,因为它们可以提高运动估计和建图的准确性和效率 [43–46]。LO-Net [47] 是一个实时的深度学习框架,它使用卷积网络来学习特征并捕捉数据动态。它包括一个特殊的损失函数和一个扫描到地图的模块以提高准确性。Liu等人 [48] 的另一种方法使用鸟瞰图投影和深度学习进行精确的运动估计。他们的方法解决了常见的挑战,并在KITTI数据集上优于传统的SLAM方法,实现了长距离下的低漂移。 -

无线电里程计 (Radio odometry)。无线电里程计利用无线电信号来估计位置和运动。它采用各种无线电技术,如WiFi、超宽带(UWB)和毫米波(mmWave)来确定智能体的位置和轨迹。通过测量和分析无线电信号的强度、延迟、到达时间(ToA)和相对位置,无线电里程计可以提供准确的定位和导航信息 [49, 50]。

基于WiFi的SLAM由于其广泛的覆盖范围,对于研究和日常生活都很有价值。Liu等人 [51] 提出了C-SLAM-RF,这是一个使用WiFi RSS(接收信号强度)和基于智能手机的PDR(行人航位推算)的系统,适用于大型室内环境。Arun等人 [52] 介绍了P2SLAM,它使用WiFi进行室内SLAM,以解决其他传感器在特定环境中的问题。它从WiFi信号中提取特征,并将其与里程计集成。最近,WAIS [53] 被提出,它将WiFi感知与视觉SLAM相结合,以减少计算和内存需求。WAIS在提高准确性的同时显著减少了资源使用,并提供了一个名为WiROS的开源工具箱用于WiFi测量。

UWB和mmWave技术由于其波长较短,可提供更高精度的定位。Wang等人 [54] 将UWB与视觉惯性里程计相结合,即使在具有挑战性的环境中也能实时创建无漂移的地图。Cao等人 [55] 使用多个UWB节点进行机器人之间的相对定位,通过优化提高了准确性。对于毫米波,Palacios等人 [56] 提出了CLAM,这是一种用于5G网络的分布式SLAM算法,解决了波束赋形训练和设备关联的挑战。He等人 [57] 提出了一种低成本的毫米波SLAM方案,该方案无需大量硬件即可实现亚米级精度。这些方法展示了UWB和毫米波如何在各种场景中增强定位和建图能力。

无线电具有广泛的适用性和低功耗特性,使其在里程计方面具有广阔前景 [50]。研究人员正在探索各种无线电技术,如蓝牙 [4]、射频识别(RFID)[58] 和Zigbee [59],或将它们组合起来 [60] 以实现更好的定位和运动估计。GPS通常与其他传感器结合使用,而不是单独用于里程计 [61, 62]。当与惯性测量单元(IMU)、摄像头、LiDAR或其他无线电系统一起使用时,GPS融合可以提高里程计和导航的准确性。 -

惯性里程计 (Inertial odometry)。惯性里程计是一种使用来自惯性测量单元(IMU)的数据来估计智能体位置和方向变化的方法。通过对IMU提供的加速度和角速度数据进行积分,可以计算出智能体的速度和位置。与视觉里程计和LiDAR里程计相比,惯性里程计通常用于外部信号不可靠或不可用的环境,例如地下、室内或其他GPS拒止环境。

TLIO [63] 提出了一种用于纯IMU状态估计的扩展卡尔曼滤波器(EKF)框架,将来自IMU测量的相对状态估计与一个回归三维位移估计及其不确定性的神经网络相结合。该方法解决了由传感器偏差和噪声引起的显著漂移问题,在位置和方向估计方面优于传统的速度积分和AHRS(姿态航向参考系统)滤波器。Chen等人 [64] 使用深度循环神经网络从原始惯性测量中估计用户位移,并将其表述为一个优化问题。它解决了误差增长以及对固定传感器位置或周期性运动模式的依赖问题。该方法在各种条件下都表现出高精度,包括非周期性运动(如购物车跟踪)和动态活动(如跑步)。DUET [65] 是一种基于深度学习的IMU在线校准方法,旨在补偿加速度计和陀螺仪的运行时误差,从而改进基于惯性的里程计。通过使用差分误差学习策略,它从位移和方向增量中学习传感器误差,从而减轻里程计计算过程中的积分误差。在公开的视觉惯性数据集上的实验表明,位置估计精度提高了20%,与现有方法相当,但复杂度更低。

如前所述,惯性里程计提供高频数据更新,使其能够快速响应极端环境中的动态变化 [66]。然而,由于积分的特性,惯性里程计中无界误差漂移会随时间累积,构成一个主要挑战。因此,IMU通常在里程计中起辅助作用,常与视觉里程计 [67] 和LiDAR里程计 [68] 等其他方法结合使用。通过提供高频运动信息(例如角速度和加速度),IMU弥补了其他传感器数据的不足,从而增强了系统定位和建图的准确性和鲁棒性。这些研究将在稍后详细阐述。 -

跨不同模态的里程计 (Odometry across different modalities)。视觉里程计在详细的环境建图和回环检测方面表现出色,LiDAR里程计在恶劣光照条件下提供高精度测量,无线电里程计具有广泛的适用性和低功耗,而惯性里程计则提供高频更新。将这些方法结合起来建立多模态里程计,可以增强整个系统的鲁棒性和准确性,弥补每种传感器类型的个体局限性 [69–72]。

结合视觉和LiDAR里程计是该领域的一个自然进展 [73–75]。Zhang等人 [76] 使用视觉里程计进行初始运动估计,并使用LiDAR进行优化,从而提高了在挑战性条件下的鲁棒性和准确性。诸如线条 [77] 和平面 [78] 等环境特征变得越来越重要,增强了复杂环境中视觉-LiDAR融合的效果。最近,NALO-VOM [5]——一个用于UGV(无人地面车辆)导航的LiDAR引导单目视觉里程计系统,解决了传统方法中环境地图稀疏的问题。它使用在LiDAR数据上训练的平面预测网络来实现尺度一致的相机位姿和半稠密地图,从而提高了导航能力。

IMU通常与其他传感器结合用于里程计,为实时校准提供高频运动数据。在视觉惯性里程计 [79, 80] 中,ESVIO [81] 引入了基于事件的双目视觉惯性里程计,使用事件流、标准图像和惯性测量。它包括用于基于事件处理的ESIO和用于集成图像辅助事件流的ESVIO,从而改善了在挑战性环境中的状态估计。对于LiDAR惯性里程计 [82, 83],AdaLIO [84] 通过根据IMU检测到的环境类型动态调整体素化和法向量估计,解决了狭窄空间中的参数退化问题。这种方法改善了在受限空间中的里程计性能,正如在公开数据集上所显示的那样。LiDAR、视觉和惯性里程计融合结合了所有三种传感器的优势 [85, 86],解决了LiDAR惯性方法中常见的问题 [72]。LVIO-Fusion [87] 集成了LiDAR-视觉-惯性里程计和建图,用于在挑战性环境中进行鲁棒的状态估计和精确的建图。它将动态体素建图LiDAR惯性里程计与直接图像投影相结合以进行光流匹配,并将视觉惯性里程计与从粗到精的状态估计相结合。评估表明其在挑战性场景中具有卓越的准确性和鲁棒性。

过程 II. 回环检测 (Loop closure detection)。

当智能体重新访问先前到过的地方时,理想情况下它应该能够检测到回环,从而可以优化估计的位姿和重建的三维环境。然而,由于里程计旨在估计相对位姿,估计漂移会随着时间的推移而累积,并可能导致无法识别的回环。通过采用回环检测技术来识别回环,可以闭合回环,从而更准确地感知几何结构以及智能体的位姿。

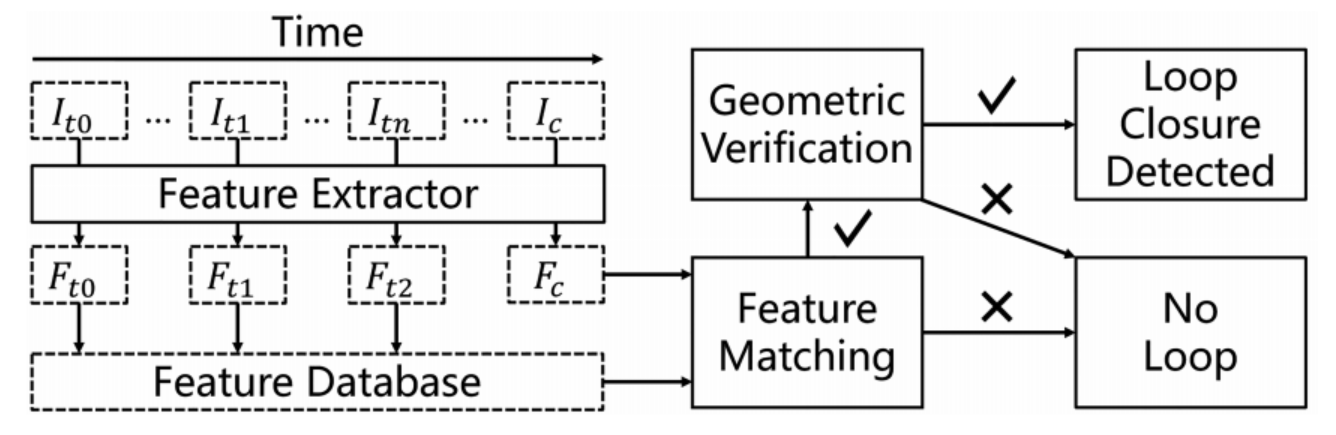

- 基于视觉的方法 (Vision-based methods)。基于视觉(或基于外观)的回环检测的通用工作流程如图5所示。相机连续拍摄周围环境的图像。然后使用诸如时间均匀采样 [88]、空间均匀采样 [89] 和外观均匀采样 [90] 等采样策略从图像流中采样关键帧(即 I t 0 , I t 1 , … , I t n I_{t0}, I_{t1}, \dots, I_{tn} It0,It1,…,Itn)。提取这些关键帧的特征描述子 [91–93],然后将其存储在特征数据库中。对当前帧 I c I_c Ic 采用相同的特征提取器,并将生成的特征描述子 F c F_c Fc 与特征数据库中的描述子进行匹配。如果 F c F_c Fc 与数据库中的某个特征描述子非常相似,则可以进一步采用更严格的几何验证以避免误报检测。

图5 视觉回环检测的典型工作流程

-

基于LiDAR的方法 (LiDAR-based methods)。正如在里程计中所展示的,值得注意的是,与视觉传感器(例如RGB相机)相比,LiDAR在变化的照明条件下提供更鲁棒的感知信息。然而,在回环检测中,LiDAR点云仅包含几何信息,缺乏图像中存在的对于位置识别至关重要的丰富信息 [94]。因此,基于LiDAR的方法在当前研究中相对较少。基于LiDAR的回环检测的工作流程与基于视觉的方法类似,其中用于LiDAR的方法的特征描述子主要包括基于直方图的描述子和基于分割的描述子。基于直方图的描述子将点云图表示为直方图,例如正态分布集 [95, 96] 和三维格式塔描述子 [97]。基于分割的描述子将计算对象信息作为预处理步骤,将点云图表示为语义对象 [98–100],这显著减少了匹配时间。最近,PADLoC [101] 被提出作为一种在基于LiDAR的SLAM中用于联合回环检测和配准的新方法,它使用基于Transformer的头部进行点云匹配,并使用一种独特的损失函数将匹配问题重新定义为语义标签的分类任务。

-

基于无线电的方法 (Radio-based methods)。由于雷达传感器受益于广泛的部署和高精度的建图能力,基于无线电的回环检测虽然研究少于基于视觉和基于LiDAR的方法,但近年来受到了越来越多的关注 [102]。与图像相比,雷达图像用于描述子的像素级特征不那么独特,并且受到多径反射问题的影响,这使得基于无线电的回环检测更具挑战性。RadarSLAM [103] 利用M2DP [37](一种旋转不变的全局描述子)来表示最初转换为点云的FMCW(调频连续波)雷达图像。在M2DP中,点云密度特征的左奇异向量和右奇异向量被用作描述子。为了减少多径SLAM中基于无线电的回环检测的累积误差,Gao等人 [104] 提出了Wi-Loop SLAM,包括一种延迟选择策略和一个带有基于粒子的和积算法(SPA)的贝叶斯模型,以确保准确的环路优化,有效地校正了传播路径受阻环境中的状态估计漂移。为了在大型环境中实现鲁棒的SLAM,TBV [105] 通过结合多种位置识别技术 [106,107] 并将环路选择延迟到验证之后,内省地验证回环候选,解决了错误约束的挑战,并将其与鲁棒的里程计流水线集成。

-

跨不同模态的回环检测 (Loop closure detection across different modalities)。与里程计类似,多传感器融合方法可以结合不同模态的优势,以实现更鲁棒的回环检测性能 [108–111]。VINS-Mono [112] 利用DBoW2 [113](一种最先进的词袋位置识别方法)进行图像帧的回环检测,并使用IMU实现高频状态估计以进行闭环。对于LiDAR惯性系统,Shan等人 [114] 在点云图上实现了基于欧几里得距离的回环检测,其中IMU用于估计智能体的运动以消除点云畸变,并作为LiDAR里程计优化的初始猜测。然后,LVI-SAM [85](一个用于紧耦合激光雷达-视觉-惯性里程计的框架)提出了一种两步法,其中回环首先由视觉惯性系统识别,然后由LiDAR惯性系统进一步优化。最近,Chghaf等人 [115] 提出了一种SLAM中回环检测的新方法,通过相似性引导粒子滤波(SGPF)利用多种模态进行搜索,集成了用于基于相机的词袋和用于基于LiDAR的扫描上下文的位置识别。TS-LCD [116] 被引入作为一种基于多传感器融合的回环检测方案,采用基于数据处理和插值的时间戳同步方法,以及用于视觉和激光回环融合验证的二阶回环检测方案。

过程 III. 后端 (Backend)。

本质上,里程计和回环检测分别解决了短期和长期数据关联的问题。由于来自不同模态的数据具有不同的特性,因此提出了不同的方法来处理不同模态的数据关联。尽管用于不同模态的里程计和回环检测方法存在显著差异,但所采用的后端优化技术在这些模态之间高度一致。原因是后端仅利用前端模块提供的数据关联关系来构建观测方程(详见下文)。

从形式上讲,后端的目的是在给定 z k z_k zk(与时间步 k k k 的路标点相关的观测数据)和 u k u_k uk(与运动相关的传感器数据,如IMU或轮式编码器)的情况下,估计未知量 x k x_k xk(智能体在时间步 k k k 的状态以及观测到的路标点的坐标)的值。通常使用两个基本方程来描述状态估计过程。一个是运动方程:

x k = f ( x k − 1 , u k ) + w k (2) x_k = f(x_{k-1}, u_k) + w_k \tag{2} xk=f(xk−1,uk)+wk(2)

其中 f f f 表示运动过程, w k ∼ N ( 0 , R k ) w_k \sim N(0, R_k) wk∼N(0,Rk) 表示随机噪声。另一个是观测方程:

z k = h ( x k ) + v k (3) z_k = h(x_k) + v_k \tag{3} zk=h(xk)+vk(3)

其中 h h h 表示观测过程, v k ∼ N ( 0 , Q k ) v_k \sim N(0, Q_k) vk∼N(0,Qk) 表示随机噪声。 z k z_k zk 和 x k x_k xk 之间的对应关系由特定模态的前端模块提供。常见的优化目标是最大后验概率(MAP),即最大化概率 P ( x ∣ z , u ) P(x|z, u) P(x∣z,u)。通过合理的近似,MAP问题可以重构为一个最小二乘问题:

argmin x , y ( ∑ k ∣ ∣ f ( x k − 1 , u k ) − x k ∣ ∣ R k 2 + ∑ k , j ∣ ∣ h ( y j , x k ) − z k , j ∣ ∣ Q k , j 2 ) . (4) \underset{x,y}{\text{argmin}} \left( \sum_k ||f(x_{k-1}, u_k) - x_k||^2_{R_k} + \sum_{k,j} ||h(y_j, x_k) - z_{k,j}||^2_{Q_{k,j}} \right). \tag{4} x,yargmin

k∑∣∣f(xk−1,uk)−xk∣∣Rk2+k,j∑∣∣h(yj,xk)−zk,j∣∣Qk,j2

.(4)

该问题的一个常见解决方案是卡尔曼滤波器 [117]。卡尔曼滤波器以增量方式执行估计。在每个时间步 k k k,卡尔曼滤波器估计 x k x_k xk 的值,并且不打算用最新的数据(即 z k z_k zk 和 u k u_k uk)更新先前的未知变量(即 x 0 , … , x k − 1 x_0, \dots, x_{k-1} x0,…,xk−1)。时间步 k k k 的估计包括两个步骤。第一步根据运动方程 (2) 预测先验状态估计 x ^ k − \hat{x}^-_k x^k−。第二步校正先验状态估计 x ^ k − \hat{x}^-_k x^k− 以获得最终的估计结果——后验状态估计 X ^ k \hat{X}_k X^k。校正通过以下方式实现:

x ^ k = x ^ k − + K k ( z k − h ( x k ) ) . (5) \hat{x}_k = \hat{x}^-_k + K_k(z_k - h(x_k)). \tag{5} x^k=x^k−+Kk(zk−h(xk)).(5)

直观地说, z k − h ( x k ) z_k - h(x_k) zk−h(xk) 充当反馈信号,反映了预测观测值 h ( x k ) h(x_k) h(xk) 与实际观测值 z k z_k zk 之间的差异。

然而,卡尔曼滤波器最初是为固定且线性的运动和观测过程以及已知的 高斯噪声等简单情况设计的,因此在更复杂的真实世界SLAM系统中无法获得最优结果。许多卡尔曼滤波器的变体被提出来应对这一挑战,相关的综述可以在 [118] 中找到。

后端的另一个主流解决方案是基于图的优化。在基于图的优化中,顶点表示未知变量,而边表示运动和观测方程。基于图的优化的优化目标仍然是MAP或等效的最小二乘问题,但基于图的优化与卡尔曼滤波器或其变体有几个不同之处。首先,基于图的优化通常通过非线性优化方法(如高斯-牛顿法和列文伯格-马夸尔特法)来解决问题,这些方法比卡尔曼滤波器或其变体更节省内存,因此更适合大规模环境。其次,基于图的优化可以根据其过去、当前和未来的方程更新未知变量,而卡尔曼滤波器或其变体则以增量方式运行,即仅根据当前的运动和观测更新当前位姿的估计。因此,基于图的优化可以实现更高的精度。由于上述优点,基于图的优化最近越来越受欢迎,并已集成到几个著名的SLAM系统中,例如maplab [119, 120] 和ORB-SLAM3 [121]。

2.2.2 SfM (运动恢复结构)

SfM在某种程度上与SLAM相似——它也试图从一系列传感器数据中重建三维环境。然而,这两个概念并不相同,它们之间存在一些差异。首先,SfM更侧重于重建而非定位,并且更侧重于重建精度而非重建吞吐量。其次,由于对重建吞吐量的要求较为宽松,SfM方法可用于重建非常大的环境。例如,通过处理来自谷歌街景的92亿张全景图像,已经构建了一个全球范围的三维SfM点云 [122];通过对雅虎一亿张图像数据集进行操作,实现了世界规模的基于SfM的建模 [123]。第三,SfM问题的输入数据更加不规则——数据可能由不同的传感器型号捕获,并且其捕获时间可能是无序的。例如,前面提到的雅虎一亿张图像数据集是通过从雅虎的Flickr图像和视频共享平台收集用户上传的图像和视频而创建的 [124]。相比之下,SLAM涉及来自固定传感器(或在多模态SLAM情况下为一组固定的传感器)的一组有序传感器数据。

SfM的传统应用包括地球科学和文化遗产记录。随着越来越多的配备摄像头的自动驾驶汽车出现在道路上,研究人员最近提出使用SfM从众包图像中离线重建城市场景 [125],而重建的场景反过来又可以指导这些自动驾驶汽车的在线导航。研究了各种相机设置、天气条件和算法对重建质量的影响。在上述研究的基础上,进一步提出了一些关于数据收集的有用指南。

随着配备GPS的智能手机的普及,众包已成为许多在线地图服务提供商(如谷歌地图 [126])进行实时事故检测和路况监测的实际方法。类似地,随着越来越多的自动驾驶汽车和移动机器人得到部署,基于众包的SfM可能成为创建和更新公共室外和室内环境点云的实际方法,这些点云可用于指导具身智能体的导航。

然而,要为具身导航构建一个实用的、基于众包且由SfM驱动的地图服务,仍有许多问题有待解决。首先,考虑到蜂窝数据成本,上传所有收集到的视频帧相当昂贵,因此必须采用有效的策略仅上传最关键的帧或感兴趣区域。其次,为导航实时下载点云数据对现有网络基础设施的带宽提出了挑战。可能的补救措施包括比特率自适应点云下载 [127,128] 和点云压缩 [129]。第三,通过使用GPS坐标 [125],可以将室外环境的重建点云与真实世界维度(即比例和方向)对齐。然而,室内环境重建点云的对齐应基于其他类型的无线信号,例如WiFi [130–132] 和蓝牙信标信号 [133,134],因为GPS在建筑物内部会遭受严重的遮挡和失真。然而,无线室内定位本身仍然面临一些挑战 [135],包括精度低 [136]、严重依赖基础设施(例如WiFi指纹图 [137] 和支持蓝牙信标的硬件 [133,138])。我们预见到未来需要进行大量研究,以实现为室外和室内具身导航提供基于众包且由SfM驱动的大规模地图服务的宏伟愿景。

2.2.3 自定位

在这一部分,我们关注智能体试图在已知环境中导航的场景。如果一个环境已经被探索过并且预先构建了相应的地图,我们就称该环境为已知环境。地图可以由不同的程序构建,例如服务器上的SfM程序或其他智能体上的SLAM程序。智能体无需从头开始绘制环境地图,只需在现成的地图中定位自身即可。这种离线建图的范式已经被许多自动驾驶解决方案所采用。例如,百度Apollo高精地图 [139] 目前已覆盖超过360个城市的1100多万公里道路,并且每天处理超过1亿次请求。这种范式的益处是多方面的。首先,由于避免了计算密集型的建图过程,降低了智能体上的计算开销。其次,与SLAM不同,这种范式中的地图构建过程对吞吐量的要求更为宽松,因此可以使用SfM等计算量更大的构建方法为智能体提供更精确的地图。

为了实现自定位的目标,智能体使用传感器捕获一些数据,然后将数据与离线地图进行匹配。根据所涉及的传感器类型,我们将现有研究分为基于视觉的方法和基于WiFi的方法。我们在此不讨论基于LiDAR的方法,因为最近的一篇综述 [140] 已经讨论过它们。

视觉方法 (Visual methods)。视觉定位的传统流程包含两个步骤。第一步是将查询图像(即需要估计位姿的图像)中的像素与地图中的三维点相关联。这种对应关系可以通过手工制作的特征描述子 [19–21] 或学习到的特征描述子 [35, 141] 来识别。第二步涉及基于几何的位姿求解器(例如PnP和RANSAC),以根据已识别的对应关系估计位姿。

上述流程的一个主要问题是对应关系匹配过程的延迟较高,该过程包含特征检测、特征描述和特征匹配等几个子步骤。此外,由于环境变化等因素,对应关系匹配过程可能并不总是可靠的,因此上述流程的准确性受到限制。因此,一种称为场景坐标回归(SCR)的新方法被提了出来。SCR不是使用特征描述子进行匹配,而是直接将查询图像输入到随机森林 [142–144] 或神经网络 [145] 中,以获得查询图像的每像素场景坐标。尽管SCR比传统流程具有更高的准确性,但它存在泛化性问题,因为关于三维场景的信息被编码到随机森林或深度神经网络(DNN)的学习权重中。SANet [146] 通过设计一个场景无关的网络来避免这个问题,其中三维场景与查询图像一起输入到深度网络中。SANet适应新场景既不需要重新训练也不需要微调。

最近备受关注的另一种解决方案是绝对位姿回归(APR)。APR旨在以端到端的方式获取给定查询图像的位姿,并且不采用基于几何的位姿求解器。尽管APR在概念上很简单,但目前面临两个挑战。首先,与包含基于几何的位姿求解器的方法相比,其准确性有限。其次,它们存在过拟合问题,因此需要重新训练或微调。目前最先进的方法marepo [147] 仍然需要数分钟的训练才能适应新场景。总之,需要更多的研究来进一步改进APR。

WiFi方法 (WiFi-based methods)。除了作为最常见的网络接入技术之一,WiFi还被许多地图服务提供商(例如谷歌地图和高德地图 [148])用于在室内环境中提供定位服务,在这些环境中GPS信号被遮挡,基于GPS的定位不准确。与基于摄像头或LiDAR的方法相比,基于WiFi的室内定位具有一些独特的优势。首先,基于WiFi的方法没有漂移累积,因为它们通过使用WiFi接入点(AP)作为锚点来定位WiFi设备(例如智能手机和支持WiFi的机器人)。其次,基于WiFi的方法对光照变化和普通视觉纹理的复杂室内环境具有鲁棒性。第三,基于WiFi的方法具有低得多的计算和能量开销。

基于WiFi的二维定位的一种常用方法是利用几何约束,例如WiFi设备与一个或多个AP之间的距离或角度。利用这些几何约束,可以通过三角测量等几何算法轻松推断出WiFi设备的位置。通常需要对WiFi无线电信号进行分析以获得这些几何约束。例如,信号的细粒度信道状态信息(CSI)特征可用于推断距离 [149]。当AP或设备具有天线阵列并且阵列中的连续天线之间存在与无线电信号角度相关的相位差时,可以推断出WiFi设备与一个或多个AP之间的角度 [150]。

尽管几何方法很直观,但在具有丰富多径的复杂室内环境中,其性能可能会下降。基本上讲,多径是环境中反射体(例如墙壁和地板)导致无线电信号从多个路径到达接收器的现象。为几何定位精确建模丰富的多径具有挑战性,因此许多方法转而采用基于指纹的定位思想。指纹定位的核心思想是构建一个指纹数据库,该数据库包含环境中不同位置的指纹(即诸如CSI之类的信号特征)。通过将未知位置测得的特征与数据库中的指纹进行比较来估计位置,从而解决定位问题。构建和更新数据库的过程非常耗时,因此提出了各种方法(例如基于众包的方法 [131,132])来减轻开销。

文献中的大多数基于WiFi的方法只能估计WiFi设备的二维位置。最近的一些方法能够估计WiFi设备的位置和方向,这可以为支持WiFi的智能体提供更多信息,以帮助它们更好地在环境中导航。MonoLoco [151] 使用一种称为多径三角测量的新颖几何算法来同时估计其二维位置和方位角(即二维平面中的旋转角度)。Wi-Drone [7] 通过设计两种六自由度(6-DoF)跟踪算法并通过因子图融合这两种算法,实现了支持WiFi的无人机的六自由度位姿估计。

2.2.4 目标定位

感知到目标位置后,智能体可以采取适当的行动向目标导航。这里我们主要关注复杂场景,其中目标被遮挡,或者由于环境中存在相似物体(例如,图书馆中许多视觉上相似的书籍)而无法通过其视觉外观有效识别。根据目标位置信息传递给智能体的方式,面向目标的几何感知可以分为基于音频的方法和基于RFID的方法。如下文所述,基于音频的方法更适用于家庭辅助机器人,而基于RFID的方法更适用于工业机器人。

基于音频的方法 (Audio-based methods)。基于音频的目标导向几何感知通常假设导航目标正在发出声音,并利用声音信号来定位可能由于遮挡而视觉上不可见的目标。基于音频的感知对于家庭辅助机器人非常有用,因为机器人可以导航到正在说话的人或正在响铃的电话。为了降低通过深度学习进行声源定位的难度,Gan等人 [152] 提出训练一个声音感知模块来估计目标和智能体之间的相对位置。进一步训练一个分类模型来确定智能体是否到达声源。此外,还实现了一个声学引擎以在虚拟环境中生成声音信号。类似地,Chen等人 [153] 提出利用导航目标发出的声音信号来增强导航,但他们使用了更复杂且声学上更逼真的仿真引擎以及一个不明确预测声源位置的端到端导航模型。后来,Chen等人 [154] 提出了一种全向信息收集机制,以从多个方向收集视觉-声学信号,并在导航能力方面取得了巨大改进。

基于RFID的方法 (RFID-based methods)。在讨论RFID在目标导向几何感知中的作用之前,我们首先简要介绍一下RFID。一个典型的RFID系统由两部分组成:RFID标签和RFID读取器。RFID标签可以存储某种识别号码,该号码可以通过RFID读取器利用无线电信号进行检索。通过将RFID标签附着到物品上并在数据库中记录物品与识别号码之间的对应关系,可以轻松确定物品的身份。关于RFID的更详细介绍可以在 [155] 中找到。除了提供身份信息外,从RFID标签发出的无线电信号还隐含地指示了标签的位置 [156–158],即无线电信号的某些特性(例如相位值和强度)与标签的位置相关,因此可以用于定位贴有RFID标签的物品。RFID技术对于目标导向感知非常有用,尤其是在工业机器人的背景下。首先,RFID技术已广泛部署于零售、制造、农业、医疗保健和物流等各个行业。2023年全球RFID标签出货量超过448亿个 [159],因此利用现有的RFID基础设施进行目标导向感知是可行的。相比之下,基于音频的目标感知可能仅适用于家庭机器人而非工业机器人,因为工业应用中的物品通常不配备任何发声组件。其次,在许多应用中存在大量外观相似的物品,例如图书馆管理中的书籍、服装店中的衣服以及物流中的包裹。即使对于熟练的人类操作员来说,仅凭外观信息有效区分这些相似物品也具有挑战性,但通过RFID技术可以轻松解决这个问题 [160]。第三,与摄像头和LiDAR相比,RFID信号可以穿透日常遮挡物,使具身智能体能够更有效地识别部分或完全被遮挡的导航目标。

许多早期研究单独使用RFID来实现目标导向的几何感知。例如,MobiTagbot [161] 通过在多个贴有RFID标签的物品周围移动并在适当位置收集相位值来识别它们的空间顺序。然而,由于RFID信号提供的关于环境的信息有限,单独使用RFID将使智能体难以实现碰撞避免或障碍物清理。RF-Grasp [162] 通过融合RFID信号和RGB-D图像来解决这个问题,以引导机器人手臂探索环境并抓取目标物品。与不使用RFID的基线相比,RF-Grasp将成功率和效率提高了40%–50%。然而,RF-Grasp需要一个独立的RFID读取器,该读取器需要与机器人手臂进行校准。RFusion [163] 通过将RFID读取器天线和摄像头都集成到机器人手臂上来解决这个限制。RF-Grasp和RFusion都利用RFID信号来定位贴有RFID标签的系统。然而,在许多真实世界的场景中,可能存在标记物品和未标记物品的混合。FuseBot [164] 通过从考虑范围中排除标记物品的位置,将基于无线电的目标感知扩展到未标记物品。

上述基于RFID的系统的一个主要局限性是它们的性能仅在有限范围或受限环境中得到验证。MobiTagbot [161] 需要视线路径以及标记物品与RFID读取器之间的方向匹配,但在真实世界场景中可能无法满足这些要求。RFGrasp [162]、RFusion [163] 和FuseBot [164] 假设工作空间是一个小桌子,并且机器人手臂位于固定底座上。预计还需要进行更多的研究,以进一步提高基于RFID的目标感知在复杂真实世界场景中的实用性。

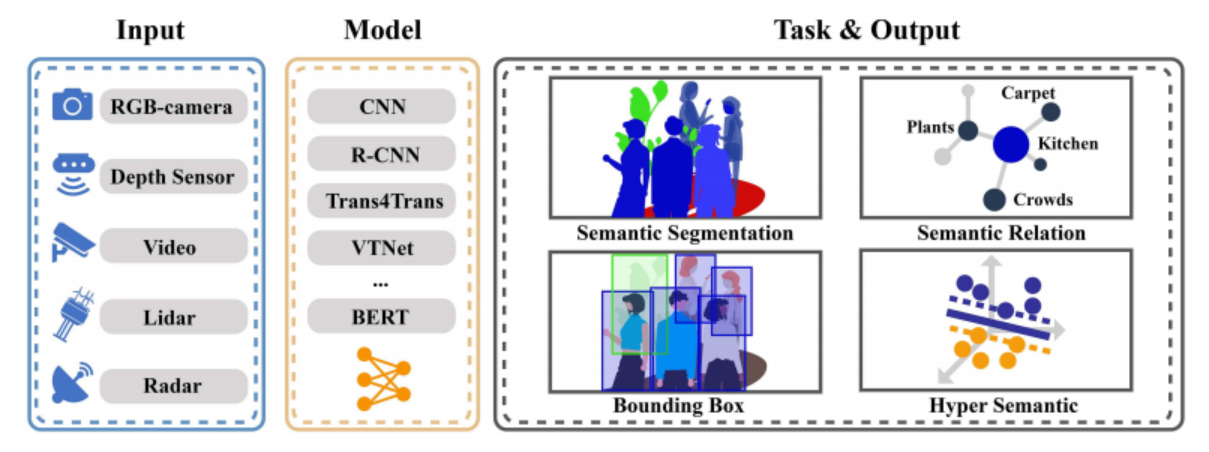

2.3 语义理解

在使用SLAM等技术构建几何环境后,语义建图成为一个至关重要的过程,它为环境中的不同区域和对象分配有意义的标签。几何地图提供了物理布局,包括墙壁、障碍物和路径的形状和位置,而语义建图通过添加上下文信息来增强这一点。这个附加的信息层使智能体能够理解每个区域和对象代表什么。通过整合语义标签,智能体对其周围环境有了更丰富的理解,使其能够执行更复杂的任务,更自然地与人类交互,并更高效、更安全地导航。该研究领域深入探讨了语义任务的各个方面,如图6所示,包括语义标记(将图像的每个像素分类为有意义的类别)、语义关系(识别和理解环境中不同实体之间的关系)以及由多模态语义集成赋能的超语义(结合来自各种传感器的数据以创建对环境的全面和连贯的理解)。总之,这些进步使得更复杂和直观的交互成为可能,使语义建图成为现代导航系统中不可或缺的组成部分。

图6 感知的语义理解。

2.3.1 语义标记

语义分割在具身导航中起着至关重要的作用,在这种导航中,智能体必须与其环境进行智能交互。通过为图像中的每个像素分配一个类别标签,语义分割使智能体能够理解场景的布局、识别对象并区分可导航区域和不可导航区域。这种精细的理解对于路径规划、障碍物规避和对象交互等任务至关重要,使智能体能够在复杂、动态的环境中高效、安全地导航。最初,语义分割主要利用基于卷积神经网络(CNN)的方法 [3, 165–167] 进行对象检测和场景理解。然而,随着Transformer架构的出现和快速发展,当前语义分割的主流方法已逐渐转向利用Transformer。这些架构在捕获长程依赖关系和上下文信息方面表现出卓越的性能,这对于准确的语义分割任务至关重要。在下一节中,我们将深入探讨基于Transformer架构的语义分割技术,重点介绍其方法论以及它们为该领域带来的改进。

正如Dosovitskiy等人 [168] 所展示的,Transformer架构通过适应图像输入,彻底改变了语义分割。这种适应性使得Transformer能够用于语义分割,从而有效地处理图像块以捕获长程依赖关系和上下文信息,这对于准确的分割至关重要。后来,Carion等人 [169] 证明了基于Transformer的方法优于传统的CNN和R-CNN方法。Transformer在建模图像内的全局关系方面表现出色,从而在对象检测和分割任务中取得了优越的性能。这种改进归功于Transformer中的自注意力机制,它比基于CNN的方法更有效地捕获图像不同部分之间的复杂细节和关系。此外,Zhang等人 [170] 引入了Trans4Trans模型,该模型突出了基于Transformer的方法在检测具有挑战性的透明对象方面实现更好性能的能力。这对于诸如为视障人士提供导航辅助等应用尤其有益,因为在这些应用中,识别玻璃门等透明障碍物对于安全至关重要。Trans4Trans模型的双头设计有效地分割了普通对象和透明对象,展示了Transformer架构在真实世界场景中的多功能性和鲁棒性。

2.3.2 语义关系

语义分割通过将图像划分为具有语义意义的区域,为自主智能体理解和导航其环境提供了基础层,使智能体能够区分各种对象和表面。然而,除了这初步步骤之外,还存在一些先进的方法,它们利用语义分割数据进一步增强对对象之间关系的理解,从而优化导航效率。理解对象关系的能力具有多种优点,例如根据相关对象的检测来预测某些对象的存在,使导航更加直观和有效,并提高导航系统的整体鲁棒性。

Wu等人 [171] 引入了一种将贝叶斯关系记忆与语义建图相结合的方法,以改进导航任务。该系统维护一个概率地图,用于捕获对象与其位置之间的关系。通过在记忆框架内集成语义信息,智能体可以对对象的存在和位置做出更准确的预测。这种概率方法有助于更好地进行路径规划和决策,从而实现更高效的导航。以概率方式捕获的对象之间的关系通过预测相关对象的位置,帮助智能体更有效地导航。

在Mousavian等人 [172] 的研究中,从语义分割和检测掩码中派生的高级视觉表示用于训练DNN,以捕获空间布局和上下文线索。这些网络实现了强大的泛化能力,并通过理解分割对象之间的关系,使智能体能够有效地导航到指定的目标对象。类似地,Yang等人 [173] 使用图卷积网络(GCN)整合语义先验,以编码关于对象关系和环境中典型放置的知识。这种预测能力使智能体能够根据观察到的场景上下文,就去哪里搜索对象做出明智的决定,即使在以前未见过的环境中也是如此。此外,在Du等人 [174] 的研究中,利用Transformer架构处理图像输入,捕获局部和全局上下文信息。Transformer中的自注意力机制使智能体能够识别场景中详细的对象特征及其关系,从而即使在复杂环境中也能实现高精度的导航。通过这些先进技术对对象之间的关系进行建模,这些研究共同证明了如何利用语义信息来构建对环境的全面理解,从而促进更有效和高效的导航。

2.3.3 超语义

近年来,包括视觉、听觉和语言输入在内的多模态传感器技术的进步,显著增强了我们收集和整合各种类型数据的能力,从而能够获得除对象类别/关系之外的更准确和全面的环境语义特征。我们将此称为超语义。这种来自多种感官模态并在潜在空间中表示的数据融合,使得创建对环境更全面的理解成为可能,这对于开发鲁棒且自适应的智能体至关重要。

视觉和语言的整合代表了超语义在具身导航中应用的一个关键方向,称为视觉与语言导航(VLN),它综合了计算机视觉和自然语言处理的进展,旨在使智能体具备在视觉丰富的环境中理解和执行复杂自然语言指令的能力。Shah等人 [2] 介绍了LM-Nav,这是一个利用大型预训练模型进行导航、视觉和语言处理的系统,无需在目标环境中进行微调。LM-Nav利用GPT-3等模型进行语言解析,CLIP进行视觉-语言关联,ViNG进行视觉导航,在复杂的真实世界环境中表现出强大的性能。类似地,Hao等人 [175] 提出了一种用于VLN的预训练和微调范式,使用图像-文本-动作三元组的大型数据集来提高在各种环境中的泛化能力。在一项相关的努力中,Pashevich等人 [176] 引入的片段式Transformer利用Transformer模型处理视觉与语言任务中的长期依赖关系,进一步提升了VLN系统的能力。此外,VLN研究探索了具身AI在任务完成方面的整合。例如,Suglia等人 [177] 引入的具身BERT模型旨在处理高维、多模态输入以完成语言条件下的任务,在ALFRED基准测试等任务的性能上取得了显著改进。

利用音频信息进行超语义研究已显示出导航性能的显著改进。例如,Gan等人 [152] 提出了一个模型,其中智能体整合音频和视觉数据以导航到声源,采用视觉感知映射器和声音感知模块来构建空间记忆并推断声音位置。类似地,Chen等人 [178] 引入了一种方法,其中智能体使用具有语义意义的音频线索(例如门吱吱作响)来引导导航,将这些线索与视觉观察相结合,即使在声音停止后也能保持方向。此外,Paul等人 [179] 的AVLEN框架专注于在多模态方法中使用音频、视觉和语言输入,允许智能体定位音频事件,并在必要时通过自然语言向人类指导者寻求帮助。这些方法共同证明,将音频数据整合到导航系统中可以显著增强智能体在动态环境中执行复杂任务的能力。此外,Yan等人 [180] 提出的非局部融合网络(NLFNet)证明了选择性融合多模态输入信息(包括RGB、深度、偏振和热成像图像)到超语义信息的有效性。这种方法通过利用不同光学传感器提供的互补信息提高了分割精度,从而解决了在各种具有挑战性的真实世界场景中对象识别的问题。这项工作强调了整合不同光学信息以补充视觉数据的重要性,进一步增强了语义识别的鲁棒性。

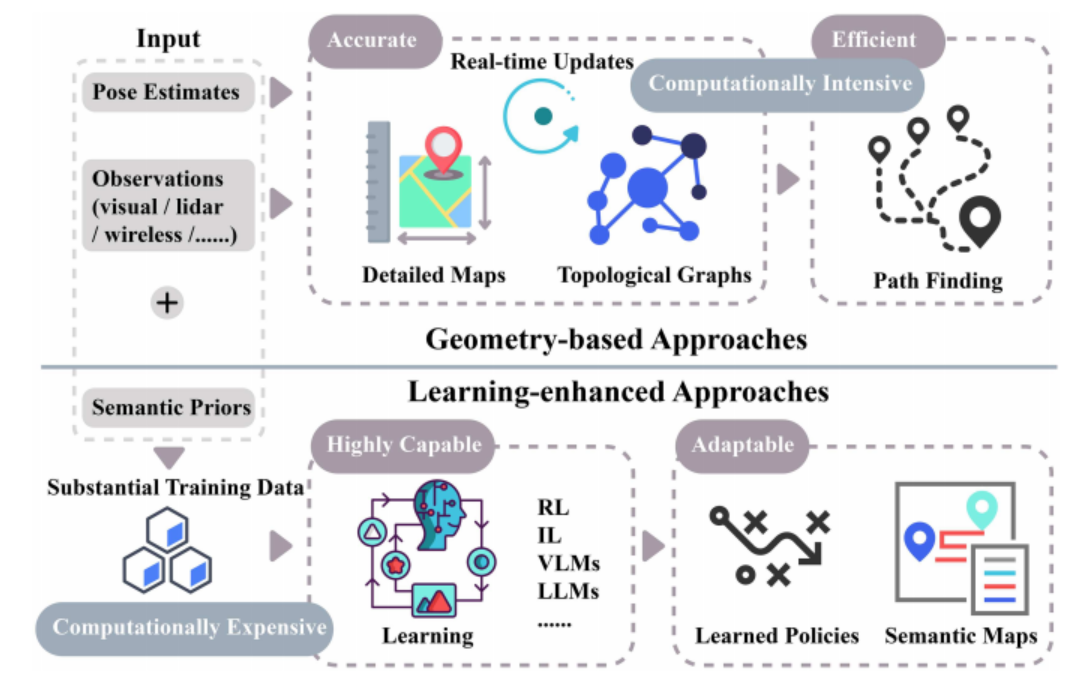

3 导航

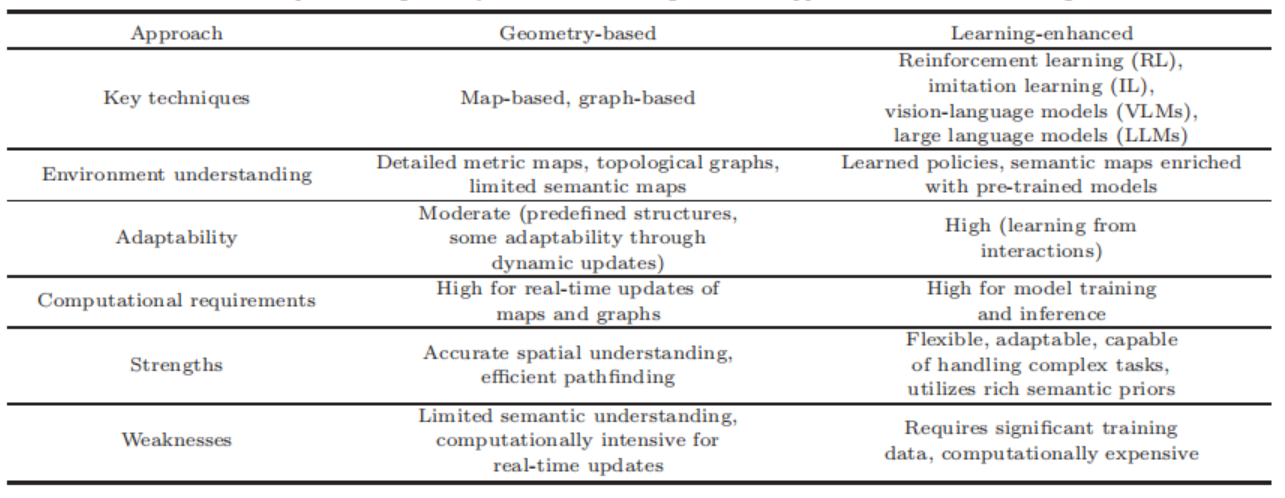

具身导航是具身AI的关键组成部分,涉及引导智能体在物理环境中实现特定目标。本节深入探讨了具身导航中采用的各种方法,如图7所示,将它们分为基于几何的方法和基于学习的方法。每种方法都有其独特的优势和挑战,反映了研究人员为增强具身智能体导航能力所采用的不同策略。我们在表1中对这两种方法进行了简要比较。

图7 基于几何的方法和学习增强的方法。

表1 具身导航中基于几何的方法与学习增强方法的比较

3.1 基于几何的方法

基于几何的导航方法依赖于实时构建和更新环境的空间表示,而不使用强化学习(RL)技术。这些方法侧重于在智能体探索环境时创建和优化地图和图形,利用几何和拓扑结构进行有效导航。其核心思想是使智能体能够动态地全面了解其周围环境,从而通过结构化的空间表示促进有效的导航。

3.1.1 基于地图的导航

基于地图的导航涉及创建和持续更新提供环境空间信息的详细地图。这些地图可以是富含语义信息的占据栅格图,在智能体探索时动态构建。此过程有助于智能体理解空间布局并在环境中定位对象。占据栅格图将环境划分为离散的单元格,每个单元格指示某个位置是被占据、空闲还是未知。这些地图还可以通过语义类别和概率进行增强,从而提供对环境的细致而全面的表示。

基于地图的导航技术的发展可以通过一系列为该方法奠定基础的开创性研究追溯,随后是建立在这些早期工作基础上的最新进展。

占据栅格建图的概念最早由Elfes [1] 提出,为处理传感器数据和地图构建提供了一种鲁棒的方法。该方法使用空间信息的概率化网格表示,允许机器人集成来自多个传感器和不同视角的数据,以增量方式更新一致的地图。

在占据栅格奠定的基础上,研究人员探索了高效的寻路算法以优化导航。最早且最具影响力的算法之一是A算法 [181],它结合了Dijkstra算法和最佳优先搜索的特点,以有效地找到最短路径。A使用启发式方法引导其搜索,使其比单独使用Dijkstra算法更快、更高效。认识到在动态环境中适应性的需求,Stentz [182] 引入了D算法,这是A算法的扩展,专门设计用于实现地图和路径的实时更新。这一进步对于动态路径规划至关重要,使机器人能够响应环境中发生的变化。与此同时,Leonard和Durrant-Whyte [183] 引入的SLAM框架解决了使机器人能够在确定自身位置的同时构建未知环境地图的挑战。这种方法允许同时构建地图和定位机器人,这是在未知领域自主导航的关键能力。

随着该领域的发展,概率方法的整合变得越来越重要。Thrun、Burgard和Fox的《概率机器人学》[184] 系统地介绍了用于机器人定位和建图的概率方法,包括对占据栅格的详细讨论。这本综合性著作对于理解和实施基于地图的导航技术至关重要,强调了概率方法在处理不确定性和集成传感器数据方面的重要性。

最近的进展通过整合现代计算方法和更丰富的数据集,显著改进了基于地图的导航。例如,Luo等人 [185] 提出了Stubborn方法,该方法引入了一种语义无关的探索策略和多尺度碰撞图,解决了基于地图的框架中探索和对象识别的关键挑战。这种方法表明,即使没有语义理解,通过仔细的探索和碰撞避免技术也可以实现鲁棒的导航。

类似地,Ramakrishnan等人 [186] 开发了PONI方法,这是一种基于地图的方法,利用势函数将导航问题分解为可管理的组件,在保持有效导航能力的同时减少了计算需求。该方法展示了分离感知和运动如何能够带来更高效的导航策略。

延续这一趋势,Georgakis等人 [187] 在其基于地图的方法中采用了一种创新的主动学习框架,用于创建和利用语义地图。通过主动选择训练样本以最大化信息增益,他们显著提高了导航效率。他们的方法利用不确定性估计和上限置信区间策略来平衡探索和利用,在未知环境中表现出卓越的性能,并突出了将传统建图与主动学习相结合以增强目标导向导航的优势。

此外,Zhu等人 [188] 的基于地图的方法使用语义线索来预测到目标对象的距离,选择最佳的中间目标并改进导航路径。该方法展示了将语义理解与距离预测相结合以在先前未见过的环境中高效导航的潜力。

这些进展说明了基于地图的导航技术的持续发展。通过建立在基本原理之上并整合现代计算方法,研究人员显著增强了自主导航系统的鲁棒性、效率和能力。这种从早期的占据栅格图到复杂、动态和语义丰富的导航策略的演进,展示了该领域在复杂环境中的持续创新和适应能力。

3.1.2 基于图的导航

基于图的导航方法将环境表示为一个由节点和边组成的网络,其中节点对应关键位置或路标,边表示它们之间可通行的路径。这种拓扑表示允许智能体通过沿着图中的路径导航,在每个节点根据可用的边做出决策。与严重依赖度量地图和详细空间表示的基于地图的方法不同,基于图的方法侧重于不同位置之间的连通性和关系。这种方法允许更抽象和灵活的导航策略,尤其是在大型复杂环境中。

基于图的导航的早期开创性研究之一是Kuipers于1978年发表的《空间知识建模》[189],他在其中引入了TOUR模型。该模型构建了人类用于通过相互连接的节点和边网络在大型空间中导航的认知地图。Kuipers的工作为在导航中使用图结构奠定了基础,系统地形式化了用节点表示关键位置、用边表示路径来表征环境的思想。这种方法强调了部分知识状态和渐进学习的重要性,显著影响了后续在拓扑建图和基于图的导航方面的研究。

在这些基础思想之上,Thrun和Bücken [190] 通过整合基于网格的地图和拓扑地图,推进了基于图的导航。他们提出了一种混合方法,该方法使用神经网络和贝叶斯积分构建基于网格的地图,然后通过将网格划分为由关键线连接的连贯区域来生成拓扑地图。这种方法有效地在度量地图上创建了一个图结构,利用了基于网格表示的精度和拓扑图的效率。通过结合这些范式,他们的方法增强了机器人自主规划和导航的能力,从而能够在复杂环境中以更高的准确性和效率进行实时导航。

为了进一步增强基于图的导航能力,最近的进展引入了图卷积网络(GCN)。GCN将卷积神经网络(CNN)的概念扩展到图结构数据,从而能够有效地处理和分析非欧几里得数据。由Kipf和Welling [191] 引入的GCN已在包括导航任务在内的各种应用中发挥了重要作用。通过利用图的结构特性,GCN能够提取和利用丰富的关系信息,从而促进更复杂和有效的导航策略。

Kiran等人 [192] 在基于图的导航中对GCN的一个显著应用是使用空间关系图(SRG)和GCN进行目标导向导航。他们的框架从机器人的轨迹中学习SRG,对区域和对象出现之间的邻近性进行建模。然后使用贝叶斯推断和基于GCN的嵌入对区域进行排序和选择以进行探索。在AI Habitat环境中的Matterport3D基准测试中,该方法显著提高了导航的准确性和效率,优于最先进的基线方法。

在此基础上,Liu等人 [193] 提出了ReVoLT框架,该框架将关系推理与Voronoi局部图规划相结合。这种分层方法使用GCN和其他方法来推断语义子目标并规划路径。在AI Habitat环境中的实验表明,ReVoLT显著优于现有方法。

所讨论的研究突出了基于图的导航方法的演变和改进。这些将环境建模为相互连接的节点和边的方法,为导航提供了一个灵活的框架,尤其是在广阔而复杂的环境中。诸如GCN之类的技术的出现显著提高了智能体处理和利用这些图中关系信息的能力,从而增强了其导航性能。这些进展强调了基于图的导航在具身AI领域中的鲁棒性和适应性,为更复杂和更有能力的导航系统铺平了道路。

3.2 学习增强方法

学习增强的导航方法利用机器学习的力量,使智能体能够通过与环境的交互来学习最优的导航策略。与严重依赖构建和更新空间表示的基于几何的方法不同,学习增强方法侧重于智能体通过持续学习和经验来适应和改进其导航策略的能力。本小节探讨了各种学习增强的导航策略,强调它们在决策上独特地依赖于学习,而不仅仅是预定义的几何结构。

3.2.1 强化学习(RL)与模仿学习(IL)

强化学习(RL)和模仿学习(IL)是强大的技术,使智能体能够通过在其环境中的交互来发展复杂的导航策略。RL方法涉及训练智能体通过反复试验来最大化累积奖励,而IL涉及模仿专家演示以实现期望的结果。与3.1小节中讨论的基于几何的方法(侧重于创建详细的空间表示)不同,RL和IL强调从交互和经验中学习以改进导航策略。我们深入探讨了RL和IL在导航任务中的应用,重点介绍了增强智能体在复杂环境中导航能力的关键进展和方法。

从基础研究向前发展,Chaplot等人 [167] 的研究引入了SemExp方法。该方法使用现有的对象检测和语义分割模型构建了一个片段式语义地图,使智能体能够通过利用语义先验和长期片段式记忆,根据目标对象类别高效导航。虽然早期的研究已将语义理解纳入导航任务,但这种开创性的方法通过展示优于各种基线的性能,显著推动了该领域的发展。

在这些早期基础之上,Ye等人 [194] 探索了辅助任务和探索奖励的整合,以增强目标导向导航的性能。通过设计一系列辅助任务,智能体可以更好地理解和探索其环境,从而提高其导航效率。这项研究证明了多任务学习和探索奖励在优化导航策略方面的潜力,标志着RL和IL应用发展的又一步。

随着领域的不断发展,解决探索任务的复杂性需要创新的解决方案。为了应对设计有效奖励函数和可扩展性的挑战,Ramrakhya等人 [195] 开发了Habitat-Web框架。该框架利用基于Web的应用程序,通过众包收集大规模的人类演示数据。使用真实的人类演示使智能体能够通过IL学习复杂的导航和操作任务,从而增强了学习策略的鲁棒性和通用性。这种方法强调了人类数据在推进导航技术方面的重要性。

与此同时,为了解决视觉导航中的可移植性和零样本学习问题,Al-Halah等人 [196] 提出了一个即插即用的模块化迁移学习框架。该框架允许智能体利用预训练模型执行各种导航任务,而无需额外的训练数据。这种方法显著提高了训练效率和任务泛化能力,使智能体能够在新导航任务上进行零样本学习,从而弥合了预训练模型和新环境之间的差距。

将RL与IL相结合以克服行为克隆(BC)的局限性标志着另一项重大进步。Ramrakhya等人 [197] 开发了PIRLNav方法,该方法涉及使用IL预训练策略并使用RL对其进行微调。这种组合解决了BC策略泛化能力差和收集演示数据成本高的问题,从而产生了一种更具适应性和效率的导航策略。这种混合方法证明了RL和IL之间的协同作用,进一步推动了导航能力的边界。

3D感知导航的进一步发展强调了从3D环境中细粒度空间信息中学习的重要性。Zhang等人 [198] 提出了一种集成同步探索和识别的方法,允许智能体构建详细的3D环境模型,并显著增强目标导向导航的性能。这项创新强调了详细空间理解在实现高导航效率方面的必要性。

为了应对与专家互动有限的挑战,Singh等人 [199] 引入了Ask4Help框架。该框架使智能体能够在需要时向专家请求帮助,从而在不改变原始智能体参数的情况下进行有效训练。它在任务性能和专家协助请求之间取得了平衡,降低了专家参与的总成本。该方法说明了利用专家知识来增强训练过程的实用方法。

上述研究说明了将RL和IL应用于导航任务的重大进展。通过学习算法和优化策略的不断改进,RL和IL已显著增强了智能体在复杂环境中导航的能力。这些方法已被证明在使智能体能够从交互和经验中学习方面至关重要,从而开发出能够适应具身导航中各种挑战的鲁棒且高效的导航策略。

3.2.2 视觉语言模型(VLM)与大型语言模型(LLM)

视觉语言模型(VLM)和大型语言模型(LLM)集成了视觉处理和自然语言理解,以增强导航能力。这些模型使用大规模预训练网络来解释和生成视觉信息和自然语言描述,使智能体能够遵循复杂的指令并做出明智的决策。与构建空间表示的基于几何的方法以及从交互中学习的RL/IL方法不同,VLM和LLM将语义理解与视觉线索相结合。

诸如CLIP [200]、ALIGN [201]和FLAVA [202]之类的VLM通过整合视觉和语言特征增强了视觉语义理解。类似地,诸如GPT-3 [203]、T5 [204]和BERT [205]之类的LLM在理解和生成自然语言方面表现出强大的能力。GPT-4的引入进一步推动了LLM所能达到的界限,具有更复杂的语言处理能力。这些突破共同促使VLM和LLM在复杂导航任务中得到有效应用。我们探讨VLM和LLM如何(单独或共同)促进在复杂环境中的导航。

VLM的最新进展在零样本导航方面显示出巨大潜力。Majumdar等人 [206] 引入了一种使用CLIP创建视觉语言嵌入空间的方法,使智能体能够在开放世界环境中导航。该方法通过允许智能体理解并导航到以任意自然语言术语(例如“一字螺丝刀”或“浴室水槽”)描述的对象,解决了传统ObjectNav中的封闭世界假设。在零样本能力概念的基础上,Zhou等人 [207] 的另一种方法通过整合软常识约束进一步增强了导航能力。这种方法利用CLIP模型创建的多模态目标嵌入,提高了智能体在不熟悉环境中的性能,并实现了在开放世界环境中鲁棒且灵活的导航。

LLM也通过其先进的语言理解和推理能力在导航任务中取得了重大进展。Zhou等人 [208] 提出的框架利用GPT-4的显式推理能力来处理复杂的VLN任务。该模型在复杂规划、常识推理和处理意外事件方面表现出色,从而增强了智能体通过详细指令和动态环境进行导航的能力。作为补充,Schumann等人 [209] 的另一个框架探索了用于街景中视觉和语言导航的LLM智能体的具身化。通过强调语言表达,该方法使智能体能够有效地解释和执行街景环境中的导航指令,展示了LLM在真实世界导航场景中的实际应用。

整合VLM和LLM提供了一种协同方法,可以利用两种模型的优势。Huang等人 [210] 引入了一种通过结合VLM和LLM为机器人导航创建视觉语言地图(VLMaps)的方法。VLM从机器人的视频流中生成视觉语言嵌入,而LLM处理指令以将这些目标置于视觉上下文中,从而增强理解和导航精度。这种方法使机器人能够遵循详细的空间指令,从而在复杂环境中实现精确导航。Shah等人 [2] 开发了LM-Nav框架,该框架采用预训练的语言、视觉和动作模型进行鲁棒的机器人导航。该框架使用CLIP作为VLM将图像与文本路标相关联,并使用GPT-3作为LLM来解析和翻译指令。通过关联图像语言数据并基于这种组合理解执行动作,LM-Nav弥合了视觉理解和语言推理之间的差距。这种集成方法增强了机器人处理复杂的真实世界导航任务的能力,展示了VLM和LLM之间强大的协同作用。

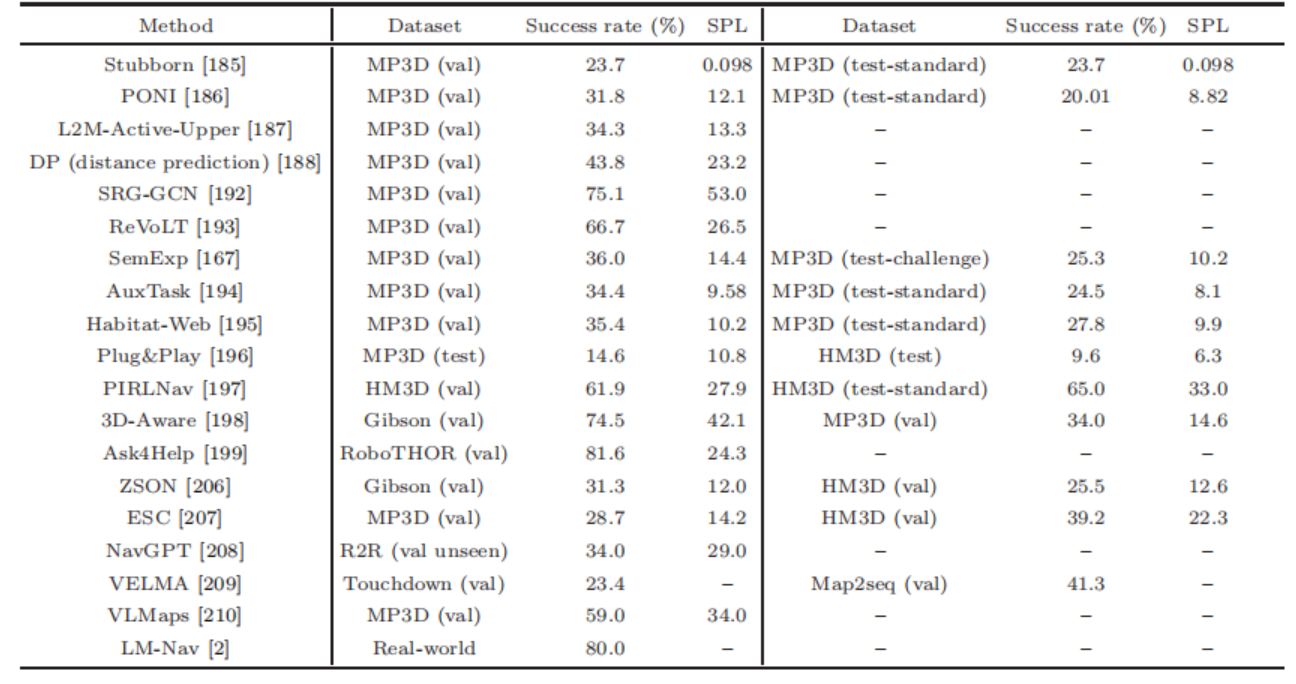

VLM和LLM的整合通过将视觉语义与先进的语言处理相结合,显著增强了导航系统的能力。VLM在创建丰富的视觉语言嵌入方面表现出色,允许在开放世界环境中进行零样本导航,而LLM则为解释复杂指令提供了强大的推理和语言理解能力。总而言之,这些模型能够实现鲁棒且灵活的导航策略,正如VLMaps和LM-Nav框架等方法所证明的那样。这些方法突出了VLM和LLM在弥合视觉和语言理解之间差距方面的协同潜力,为能够在多样化和动态环境中运行的更具适应性和智能性的导航系统铺平了道路。在表2 [2, 167, 185–188, 192–199, 206–210] 中,我们列出了主流目标导向和视觉语言导航方法的成功率和路径长度加权成功率(SPL)以进行比较。从结果中我们可以观察到,包含语义先验、探索策略或人类演示的方法通常会获得更好的性能,这突出了在具身导航任务中利用高级场景理解和数据效率的重要性。

表2:目标导向和视觉语言导航方法的成功率和SPL比较

4 具身导航的效率优化

效率在具身导航系统的设计和运行中至关重要。这些系统必须在复杂环境中导航,同时实时响应变化。为实现这一目标,必须优化几个关键因素,包括延迟、能效和鲁棒性。这些因素中的每一个都在确保系统能够安全有效地执行其任务方面发挥着至关重要的作用。本节将讨论优化这些方面的挑战和策略。

4.1 延迟优化

为确保安全,具身导航智能体通常对端到端延迟有严格的预算。对于无人机、自动驾驶汽车和机器人来说,高延迟可能导致错失避开障碍物或采取最佳路径的机会,这对于安全高效的导航至关重要。此外,高效导航涉及持续的路径规划和重新规划。低延迟确保智能体可以根据新信息快速调整其路径,从而优化行驶时间和能耗。因此,优化端到端延迟对于具身导航任务至关重要。

然而,确保具身导航智能体的实时反应涉及若干挑战。首先,具身导航智能体通常涉及多个任务,例如感知、控制和决策,其中许多任务通常依赖于计算密集型算法,例如DNN,这可能导致高延迟。在有限资源下实现高计算效率是具身导航中的一个挑战 [211]。其次,具身智能体的环境是动态的,受到温度变化、硬件老化和后台进程等因素的影响。这要求边缘设备切换应用程序或模型以处理变化环境中的新任务 [212]。因此,在动态环境中保持稳定的计算延迟是另一个重大挑战 [213,214]。第三,网络和通信挑战在确保实时性能方面起着至关重要的作用。依赖远程处理或云服务的系统可能会面临显著的网络延迟,需要快速可靠的通信链路。已经提出了多种技术来应对这些挑战。

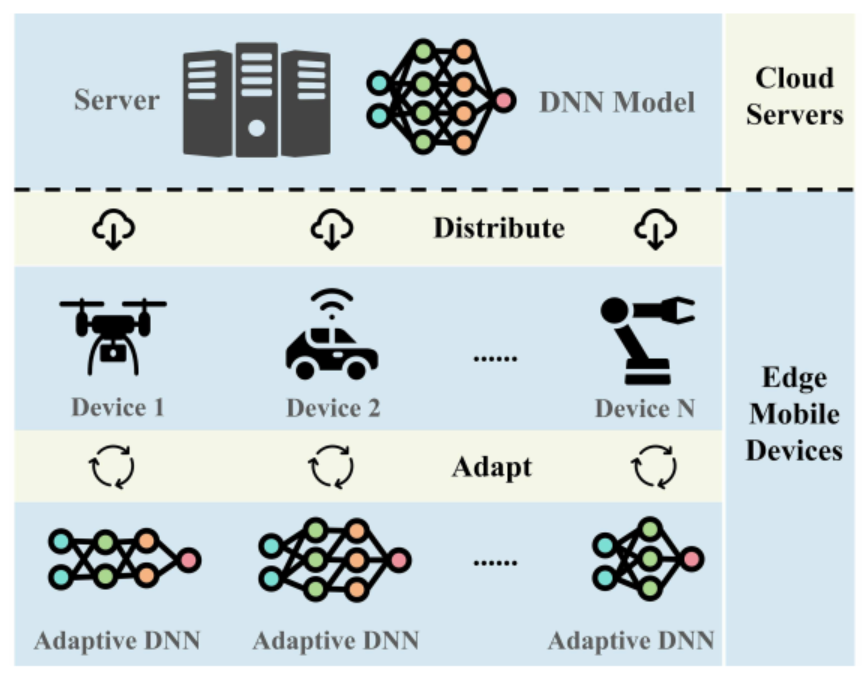

4.1.1 自适应计算

自适应计算是根据导航任务的实时需求动态调整计算资源分配,如图8所示。这确保了即使在动态环境中也能满足延迟预算,正如各种研究 [213–215] 所强调的那样。MCDNN [212] 通过模型调度实现这一点,采用优化编译器和运行时调度程序来促进跨移动和云设备执行多个DNN模型,从而优化资源利用率并增强整体系统性能。NestDNN [213] 引入了一种独立于云连接运行的设备上自适应深度学习框架,它考虑了运行时资源的可变性,从而能够为移动视觉系统量身定制资源感知型DNN模型。LegoDNN [215] 引入了一种新颖的块粒度DNN模型扩展方案。该方案专为在移动设备上运行多个DNN工作负载而设计,提供了一种模块化方法,可以高效地扩展和管理DNN模型。AdaptiveNet [214] 提出了一种创新的模型弹性化方法,旨在在部署后调整DNN架构。与以前的研究相比,AdaptiveNet可以在部署后调整DNN架构,从而可以精确测量模型质量。这些研究为在动态和资源受限的环境中确保延迟预算提供了鲁棒的解决方案。

图8 自适应计算。

4.1.2 并行处理

利用多个处理器和专用硬件加速器来分配计算任务也可以实现更快的处理和响应时间 [216,217]。借助CPU、GPU和NPU等各种处理单元,机器人和智能车辆等移动设备可以通过在不同处理器上并行执行来减少推理延迟 [218]。已经探索了高效的并行方法来优化计算分布 [219]、平衡负载 [220] 以及最小化处理器之间的通信成本 [221]。BioDrone [8] 通过基于FPGA的交叉视神经束启发式事件过滤(CEF)和外侧膝状体核启发式事件匹配(LEM)算法的实现,利用并行计算来确保实时反应。这些算法并行处理事件数据,显著减少了延迟。DNNFusion [222] 引入了先进的算子融合技术和高效的代码生成,从而减少了内存压力并提高了执行效率,从而实现了DNN模型的高并行度和低延迟。NN-Stretch [219] 通过将深度学习模型转换为多分支结构来增强其计算并行性。它通过将传统的单分支模型转换为具有多个分支的更短更宽的模型来实现这一点,并针对异构多处理器上的执行对其进行优化。

4.1.3 通信优化

对于依赖远程服务或与其他智能体通信的具身导航系统,高效的通信对于保持低延迟至关重要。首先,边缘计算可以缓解与云依赖相关的延迟问题。通过在更靠近源头的位置处理数据,边缘计算减少了数据在设备和云之间来回传输所需的时间。EdgeSLAM [33] 使用一种新颖的计算卸载策略和自适应任务调度算法来实现基于SLAM的实时导航。该系统还考虑了动态网络条件并相应地调整系统参数。SwarmMap [6] 提出了一个在边缘卸载设置中扩展协作式基于SLAM的智能体的框架。它可以通过实现地图信息跟踪器、SLAM专用任务调度程序和地图骨干分析模块来实现众多智能体之间的实时协作。其次,优化数据传输量也至关重要。数据压缩 [223] 和选择性数据传输 [224] 等技术可以显著减少需要在网络上传输的数据量,从而减少延迟。CoEdge [225] 引入了一个专为分布式实时深度学习任务量身定制的协作边缘系统,通过批处理传感器输入和聚合推理结果来提高数据传输效率。VILAM [226] 通过提取和传输静态环境的紧凑表示、提取低频测量以及利用并行处理技术来优化数据传输。这减少了数据量并确保了高效的实时通信和定位。

4.2 能效优化

对更好电源和能源的迫切需求是自主系统发展的最主要挑战之一。特别是对于无人机和移动机器人,由于尺寸限制,其电池存储容量有限。此外,导航任务通常需要在恶劣环境中执行,这增加了操作复杂性。长时间任务对能效提出了更高的要求,这对于扩展操作尤为关键。因此,提高路径规划的能效对于具身导航任务的性能至关重要。

然而,在机器人路径规划中提高能效涉及若干重大挑战。我们总结了三个主要挑战:

- 复杂环境和障碍物 (Complex environments and obstacles)。路径规划算法必须不断适应变化,这可能是计算密集型且耗能的。

- 算法效率 (Algorithmic efficiency)。许多传统的路径规划算法,例如基于网格地图或基于采样的方法,可能本身并不节能。它们通常侧重于找到最短或最安全的路径,而没有明确考虑能源成本。

- 实时处理 (Real-time processing)。在优化能效的同时实现实时处理是困难的,特别是对于在动态环境中运行的自主移动机器人。这需要先进的计算技术,并且通常需要专门的硬件来确保能够动态计算和调整节能路径。

应对这些挑战需要多学科的方法,整合算法设计、机器人硬件和能源管理系统方面的进展。许多研究已经提出了相应的解决方案,以提高具身导航中路径规划的能效。这些方案包括用于单智能体系统的贝叶斯算法、遗传算法和强化学习算法,以及用于多智能体路径覆盖问题的多阶段启发式算法。具体而言,单个智能体的路径规划问题在自动驾驶电动汽车、无人机和移动机器人等场景中有着丰富的应用。参考文献 [227] 集成了一种混合进化算法和Q学习,同时考虑了无人机速度和与障碍物的距离。为了克服传统优化方法的局限性,该方法将遗传算法与Q学习相结合。通过考虑无人机速度和与障碍物的距离,该方法根据实时信息优化路径规划决策。参考文献 [228] 提出了一种基于深度强化学习的多智能体路径规划方案。目标是在完成卸载任务的同时最小化无人机的总能耗。基于参考文献 [229] 中介绍的环境分割航空影像,它演示了从分割中建立粗略能量图的过程。在离线阶段,该图用于构建基于高斯过程(GP)的环境表示的协方差函数。在线阶段,导航期间收集的能量测量值用于使用GP回归估计整个环境的能量分布,从而减少无人机导航期间的能耗。此外,多个智能体的协同任务处理也是一个非常常见的场景,例如无人机网络通信。该领域的能源优化工作也非常重要。无人机集群最重要的路径规划问题是考虑使用多架无人机覆盖任何包含障碍物的区域,称为覆盖路径规划(CPP)问题。CPP问题的目标是为每架无人机找到覆盖整个区域的路径。参考文献 [230] 采用贝叶斯方法对路段的能耗进行建模,以实现高效导航。开发了一个在线学习框架来学习模型参数,并研究了各种探索策略。然后将该框架扩展到多智能体环境,允许多个车辆根据环境变化动态调整导航策略并学习能量模型参数。在卢森堡SUMO交通数据集上的真实世界实验证明了该方法的能源优化性能。参考文献 [231] 分两步解决CPP问题:首先,将给定区域的工作量均匀分配给单个无人机;其次,为每架无人机解决最小能量路径规划(MEPP)问题。它引入了一种著名的Lin-Kernighan启发式方法来有效解决该问题。

4.3 鲁棒性改进

具身导航中的鲁棒性特指具身AI智能体(例如机器人)在面对一系列挑战时,能够持续有效地在其环境中导航的能力。这些挑战可能包括任务环境的变化,甚至传感器噪声。鲁棒的具身导航确保智能体能够适应这些变化并保持其导航性能,在没有故障或显著性能下降的情况下实现其目标。因此,鲁棒性是具身导航系统的一个关键特性,需要计算高效和密集的策略来确保泛化能力。接下来,我们将从适应环境变化和增强传感器可靠性两个方面介绍提高鲁棒性的方法。

4.3.1 适应环境变化

环境变化指的是部署环境与用于训练智能体的环境相比,具有不同的外观统计数据(例如天气变化)和运动动力学(例如变化的地面摩擦系数)[232]。Chattopadhyay等人 [232] 提出了一个框架RobustNav,作为评估具身智能体抵抗各种视觉和动力学干扰的鲁棒性的第一步。他们的研究结果表明,标准智能体在这种干扰下通常表现不佳,这凸显了诸如数据增强和自监督适应等鲁棒性技术的需求 [233]。RobustNav作为一个试验平台,用于增强在不同感知和驱动条件下的导航性能,并强调由于未见环境和情况的巨大多样性,零样本适应方法可能比适应每一种可能的目标场景更有效和可扩展。

Peng等人 [234] 提出了RDMAE-Nav,一个用于在存在视觉干扰的情况下增强PointGoal导航过程中具身智能体鲁棒性的导航框架。RDMAE-Nav集成了一个采用正则化去噪掩码自动编码器(RDMAE)的视觉模块以进行鲁棒的表示学习,以及一个策略模块。与最先进的方法相比,它实现了具有竞争力的性能,在各种视觉干扰下显示出显著的增强。

最近,一种新颖的适应方案——测试时适应(test-time adaptation),已被应用于具身导航。与训练阶段的模型适应不同,测试时适应在测试阶段在线更新模型以适应未标记数据 [235,236],从而在未知的部署环境中实现更好的知识获取和准确性提升。Gao等人 [237] 针对VLN任务提出了快速-慢速测试时适应(FSTTA),通过交替执行快速更新以实现即时适应性和慢速更新以减轻测试期间的累积误差,从而平衡适应性和稳定性。大量的实验表明,FSTTA显著提高了在四个流行的评估基准上的性能,验证了其有效性。

4.3.2 增强传感器可靠性

传感器噪声是指具身智能体传感器收集的数据中的随机变化和不准确性。这些变化可能源于硬件限制、环境干扰和恶意攻击,显著影响智能体对其环境的感知,并导致导航和决策中的错误。

Liu等人 [238] 通过生成时空扰动来创建具有3D对抗性噪声的样本,开创了针对具身智能体的视觉对抗性攻击研究。他们开发了一个轨迹注意力模块来检查场景视图的贡献,有助于定位那些对智能体预测产生最强刺激的3D对象。通过利用时间线索并针对空间维度,他们在最关键的场景视图中扰动关键上下文对象的物理属性(例如,3D形状和纹理)。结果表明,这些3D对抗性样本有效地攻击了最先进的具身智能体模型,并显著优于其他3D对抗性攻击方法。

Ying等人 [239] 也验证了视觉导航中具身智能体的恶意对抗性噪声。他们引入了δ-马尔可夫决策过程(δ-MDP)来建模通用对抗性扰动(UAP)的持续影响,并提出了两种新颖的一致性攻击方法:奖励UAP和轨迹UAP。大量的实验表明,在他们提出的恶意对抗性攻击下,现有具身视觉导航方法的性能显著下降。此外,Tian等人 [240] 研究了对抗性攻击下的多传感器感知。他们以视听事件识别任务作为视听具身导航任务的代理,以验证多模态对抗性攻击。同时,提出了一种基于视听非相似性约束和外部特征记忆库的视听防御策略。他们的实验表明,视听模型容易受到多模态对抗性攻击,并且他们的防御方法在不显著影响干净模型性能的情况下增强了视听模型的鲁棒性。

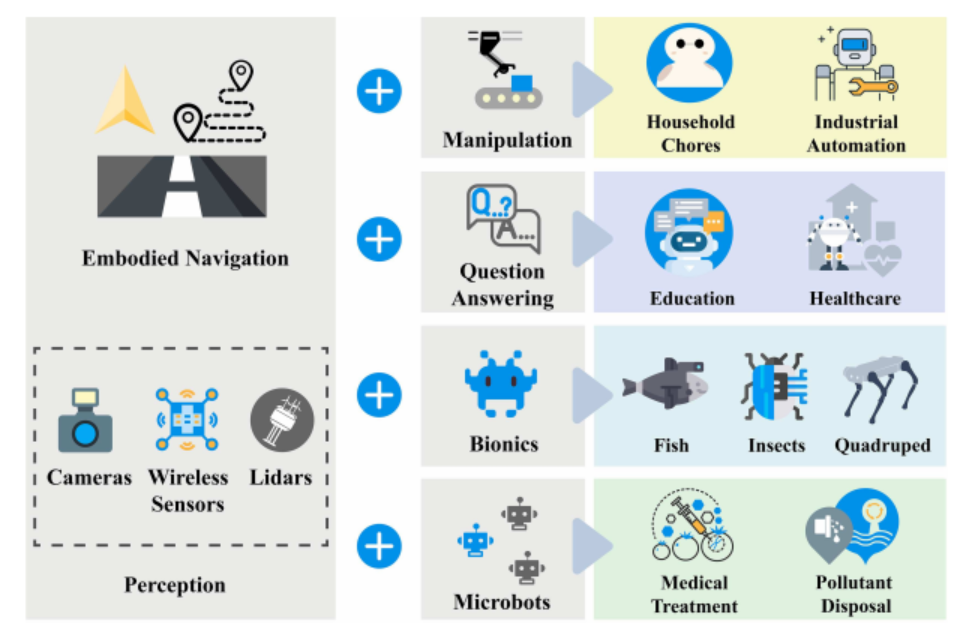

5 具身导航赋能的任务

本节重点介绍由具身导航赋能的任务,如图9所示,突出了其在先进机器人系统的功能和增强方面不可或缺的作用。通过展示其在各个领域的变革性影响,我们阐明了具身导航如何成为一个关键组成部分,它不仅扩展了操作能力,而且为机器人和人工智能领域带来了新的可能性。

图9 由具身导航赋能的任务。

5.1 自动驾驶

具身导航的特性使其能够直接惠及汽车和无人机等自动驾驶平台,使车辆能够实时感知和响应动态环境 [241–246]。传统系统通常依赖于预定义路线和静态地图,适应性有限。相比之下,具身导航使这些平台能够在不可预测的条件下安全高效地导航并做出即时决策。

5.2 通用辅助机器人

通用辅助机器人依靠具身导航在各种环境中有效运作,使其能够执行静态或移动能力有限的系统无法完成的任务。这些机器人将导航与操作和交互能力相结合,使其能够在复杂和非结构化环境中自主运行。

5.2.1 导航与操作

具身导航使机器人能够穿越复杂环境以到达并操作物体。没有这种能力,机器人的操作任务将被限制在一个有限的区域内。导航通过允许机器人移动到不同位置、适应新任务并与各种物体交互,扩大了操作范围,从而增强了它们在家庭杂务和工业自动化等任务中的实用性。

例如,TidyBot [9] 结合了这些功能,通过利用LLM从用户偏好中推断通用规则来自动化家庭清洁任务。TidyBot使用预定义的操纵原语,在真实世界评估中成功地将85%的物体放置在正确的容器中,证明了其在个性化和执行家庭任务方面的有效性。类似地,OK-Robot [10] 展示了VLM与机器人原语集成在家庭环境中进行拾取和放置操作的潜力。OK-Robot利用预训练模型进行对象检测和导航,在零样本任务中实现了58.5%的成功率,突出了开放知识模型如何在无需额外训练的情况下增强移动操作能力。这种方法强调了将导航与操作相结合以有效处理非结构化环境的多功能性。

为了进一步确保LLM和VLM生成的策略指令能够被机器人在当前环境中执行,SayCan [247] 引入了一种新颖的可供性函数。该函数将LLM生成的指令与环境可供性相结合,通过根据当前条件对行动的可行性进行评分来确定机器人的下一个可执行动作。这种集成显著增强了机器人导航和操作的灵活性和适用性,使机器人能够以更高的精度适应各种场景。在另一个不同但互补的方面,Inner Monologue [248] 将内省推理集成到机器人任务中,机器人通过维持内部对话来改进任务规划和执行。这种方法通过允许机器人持续评估其行动和环境条件来增强决策过程。通过整合这种形式的反思性推理,机器人可以在操作任务中实现更高的准确性,尤其是在动态和不可预测的环境中。

在这些集成灵活性的基础上,代码即策略(CaP)框架 [249] 使用LLM直接为机器人任务生成策略代码,解决了预定义技能的局限性。通过解释自然语言指令并生成可执行代码,CaP使机器人能够执行复杂的导航和操作任务。这种方法增强了智能体以最少的数据收集适应新任务和环境的能力,这对于辅助机器人至关重要。

5.2.2 导航与问答

导航与问答系统的集成为机器人提供了上下文和空间相关的信息。具身导航通过使机器人能够理解空间上下文并将其纳入响应、移动到相关位置并根据提出的问题执行操作,从而丰富了对话。这种能力对于在医疗保健和教育等环境中提供全面的帮助至关重要,因为在这些环境中,理解环境并与之交互可以显著提高服务质量。

Das等人 [250] 引入了具身问答(EQA)任务,其中AI智能体必须在3D环境中导航,以基于第一人称视觉回答有关其周围环境的问题。这个基础模型突出了语言理解、视觉识别和主动感知的集成,这对于智能体有效导航和收集必要的视觉信息至关重要。这项研究强调了具身导航的重要性,因为它直接影响智能体定位和解释相关视觉线索以准确回答问题的能力。

基于EQA中导航和交互的挑战,Gordon等人 [11] 通过其交互式问答(IQA)模型为任务引入了更动态的方面。他们的工作通过使智能体能够操纵其环境中的对象(例如打开门或重新排列物品)以访问以前无法到达的区域或发现隐藏信息,解决了初始EQA模型中静态环境的局限性。这种增强使智能体能够执行需要理解环境布局和其中对象功能方面的任务,从而显著扩展了智能体可以回答的问题范围。进一步扩展导航任务的复杂性,Yu等人 [251] 引入了多目标具身问答(MT-EQA)模型,该模型允许智能体解决涉及同一环境中多个目标的问题。这一发展是为了应对早期模型中单目标查询的局限性。通过实现跨不同空间位置的比较推理,MT-EQA模型使智能体能够执行更复杂的导航任务并回答更广泛的问题。该模型不仅测试智能体的导航能力,还测试其综合来自多个位置和对象的信息以形成准确响应的能力。

PaLM-E [252] 代表了LLM与具身导航和问答集成方面的一项重大进步,展示了如何将包括视觉数据和连续传感器读数在内的多模态输入无缝集成到语言模型中,以增强机器人的决策和导航能力。

5.3 仿生导航

对于模仿生物有机体的仿生机器人来说,具身导航是一个关键组成部分。这些机器人旨在复制生物的移动性和感知能力,这对于在复杂地形中导航至关重要。

受生物学原理启发的具身导航,使仿生机器人能够像其自然对应物一样移动和交互,使其适用于在多样化和具有挑战性的条件下进行搜索救援、环境监测和探索。

5.3.1 仿生鱼

具身导航赋予仿生鱼增强的水下机动性和适应性,这对于探索和与深海环境互动至关重要。受狮子鱼等深海生物启发的仿生鱼研究 [253, 254] 表明,具身导航对于水下机动性至关重要。它开发了一种能够在极端海洋深度运行的软体机器鱼,利用受狮子鱼头骨结构启发的分布式电子系统来增强抗压能力。这项创新解决了深海导航和采样的挑战,而无需笨重的保护容器。未来先进具身导航技术的集成可能会催生出更自主、更具弹性、更高效的水下探索机器人,能够以最少的人工干预执行深海采矿和环境监测等复杂任务。

5.3.2 仿生昆虫

仿生昆虫中的具身导航减少了对复杂外部传感器的依赖,从而能够以最小的处理能力实现流线型设计和高效性能。一项研究开发了一种无线控制的机器人昆虫 [255],即BHMbot,它实现了超快的无缆奔跑速度。通过模仿昆虫的腿部步态,这种2厘米长的微型机器人可以导航复杂的轨迹和障碍物,在狭窄空间内展现出高机动性和高效的移动能力。这种能力对于远程检查和环境监测等应用至关重要。另一项研究探索了昆虫的感官和运动机制以提高机器人效率 [256]。受苍蝇利用触角上的气流压力进行导航的方式的启发,这项研究将低分辨率传感器集成到微型机器人中,以在不增加显著功率需求的情况下提高性能。这种方法使微型机器人能够更有效地导航和适应其环境。未来的工作可以侧重于增强这些昆虫级机器人的自主性和鲁棒性,使其能够执行基础设施检查、环境监测和精准农业等复杂任务。

5.3.3 多环境机器人

具身导航增强了为在不同地形中导航而设计的机器人的多功能性和操作效率。一项关于四足机器人的研究 [257] 利用动态控制策略和状态估计来提高在各种陆地环境中的稳定性和适应性。这种方法利用实时反馈和具身导航来保持在不同地形上的稳定性,突出了机器人适应不断变化条件的能力。相反,一种仿生龟机器人 [258] 展示了使用自适应形态在陆地和水中导航的能力,从而实现了游泳和行走之间的平稳过渡。这种受海龟运动启发的设展示了具身导航在增强多环境操作中多功能性和效率的潜力。未来的发展可能会看到配备更先进感官和自适应系统的两栖机器人,进一步增强其应对不同地形和执行从环境监测到灾害响应等广泛任务的能力。

5.3.4 变形机器人

具身导航使变形机器人能够根据目标路线调整其形态,突出了它们在动态环境中的潜力。受章鱼和蠕虫等生物启发的变形机器人展示了具身导航在适应各种任务和环境方面的优势。研究人员开发了形状可编程的软体机器人 [259, 260],它们可以改变形态以执行抓取和移动等任务,突出了具身导航在使机器人能够与其周围环境动态交互方面的作用。Tang介绍了一种受蠕动运动启发的蠕虫状软体机器人,用于在亚厘米直径的管道中导航 [261]。该机器人使用介电弹性体致动器(DEA)进行推进和锚定,使其能够穿越各种管道几何形状,包括L形、S形和螺旋形管道。它展示了快速运动和适应性,这对于管道检查等任务至关重要。未来的进步可以增强变形机器人的适应性和多功能性,使其在搜索和救援行动中具有不可估量的价值,在这些行动中,这些机器人可以穿过碎片和狭窄空间来定位和协助幸存者。

5.4 微环境导航

本小节探讨了具身导航在微环境中的应用,重点关注用于复杂任务的小型化机器人,这些任务需要在密闭空间中操纵、适应微小变化并以高精度运行 [262]。

5.4.1 医疗

导航赋能的微型机器人可以通过实现微创手术和靶向药物输送,并通过在难以到达的区域进行详细分析来改善环境监测,从而彻底改变医疗程序 [12]。Schmidt等人 [13] 探索了使用微型机器人进行靶向药物输送系统,专门用于癌症治疗。它详细说明了如何使用外部磁场将微型机器人引导至肿瘤部位,从而提供一种集中的治疗方法,最大限度地减少对周围健康组织的损害。Dekanovsky等人 [14] 讨论了在体内靶向运输激素方面使用微型机器人。这些微型机器人设计用于在复杂的血管系统中导航,由外部磁场和实时成像技术引导。未来的研究可以侧重于将导航与实时跟踪、自适应系统和先进的推进机制相结合。通过解决这些领域的问题,具身导航可以为微型机器人在医疗中释放新的潜力,通过微创、高度靶向的治疗干预改善患者的治疗效果。

5.4.2 水污染物处理

在水污染物处理方面,具身导航对于提高各种微米和纳米机器人系统的有效性至关重要。一项研究引入了温度响应磁性纳米机器人,该机器人利用磁力推进和热敏聚集来有效去除水中的砷和阿特拉津,表现出高回收率和可重复使用率 [263]。另一项研究开发了光驱动纳米/微米马达,利用紫外光进行推进,显著改善了纳米塑料的捕获和降解,无需化学燃料,从而提供了一种环保的解决方案 [264]。如果进一步整合到这些系统中,具身导航有望通过在微环境中提供更精确的控制和增强的适应性来推动水净化领域的发展 [265]。

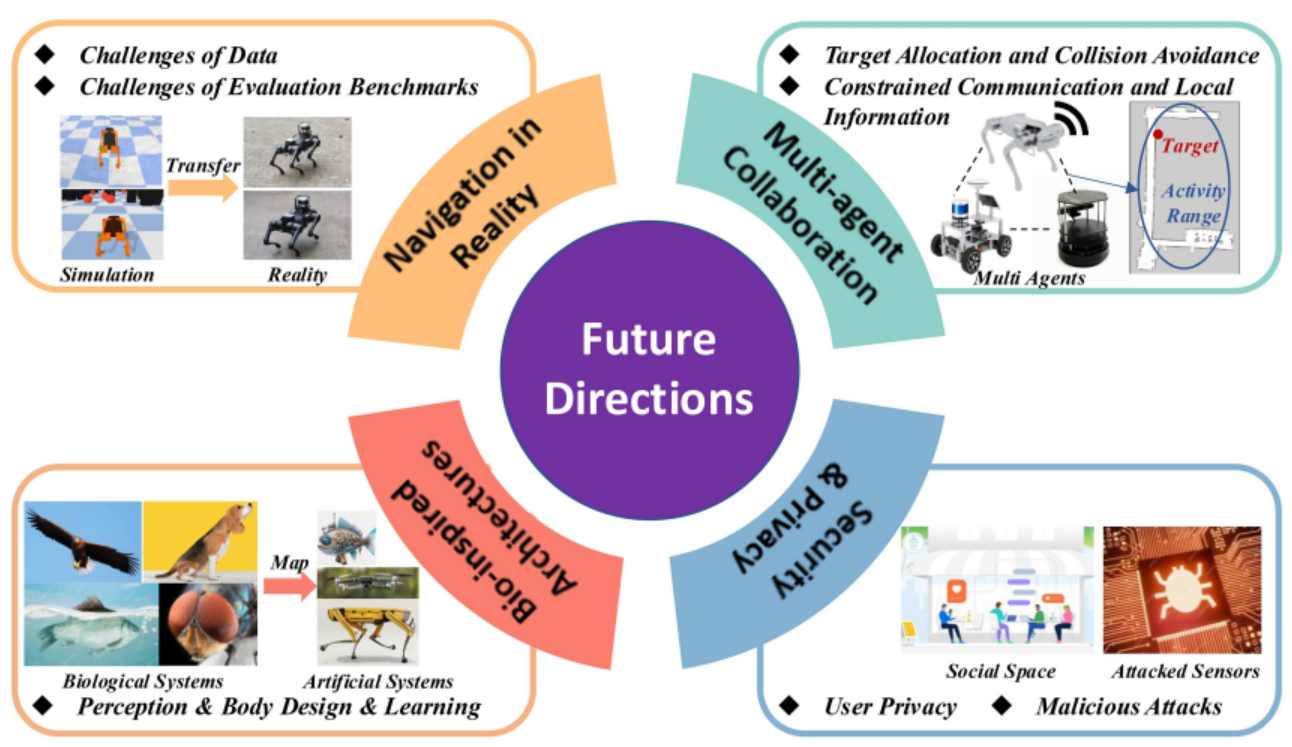

6 挑战与未来工作

作为一个新兴的研究领域,具身导航在当前研究中存在许多尚未解决的问题和相应的挑战。在本节中,我们重点介绍了未来可能取得进展的方向,概述了需要进一步探索和创新以解决现有局限性并推动该领域发展的关键领域,如图10所示。

图10 具身导航的挑战与未来工作。

6.1 现实世界中的具身导航

尽管许多具身导航的研究和基准测试都是在模拟环境中提出的 [266],但在大规模真实世界环境中仍然缺乏更深入和更广泛的探索,导致在分布变化下出现现实与性能的差距 [267]。这可以归因于两个主要原因:真实世界数据的相对稀缺以及缺乏全面的真实世界评估基准。(i) 数据方面的挑战。由于在真实世界环境中数据收集和人工操作的成本高昂,研究人员通常使用模拟数据进行模型训练和验证,这导致了在现实中性能下降。为了缩小这种现实与性能的差距,当训练期间真实世界数据有限 [268, 269] 或完全无法获取 [270–274] 时,Sim2Real可以成为一种将模拟中学习到的知识迁移到现实中的有效方法。(ii) 评估基准方面的挑战。除了数据之外,真实世界的评估基准对于在真实环境中进行充分的模型验证也是必要且相对缺乏的。在模拟评估基准 [275, 276] 成功的基础上,为具身AI任务创建真实世界基准是有意义的,但也需要大量的人力投入和财政资源。研究人员已经在该领域做出了一些努力 [277–280]。然而,要完全消除模拟与现实之间的性能差距,仍然有相当长的路要走。这种差距不仅因为真实环境中更复杂和动态的因素而持续存在,还因为真实具身智能体的异构性,它们具有不同的姿态和行为模式,例如四足机器人 [281]、模块化机器人 [282, 283],甚至仿生水下机器人 [253]。考虑到真实具身智能体的行为模式和动态任务环境,构建公平、可扩展且有效的真实世界评估基准将是未来工作的一个关键长期目标。

6.2 多智能体协作

多个具身智能体可以通过协作实现远超个体智能水平的群体智能 [284]。然而,与单智能体系统 [285, 286] 相比,当前具身导航研究对多智能体系统的关注相对较少。原因之一是现有评估基准中缺乏多智能体特性。据我们所知,只有少数基准 [287–289] 考虑了多智能体设置,为多智能体算法提供的验证方法有限。此外,与单智能体系统不同,具身导航中的多智能体系统面临着独特的挑战。智能体必须从自身的观察中学习,并且还要考虑其他智能体的转换,因此需要在导航策略、目标分配和碰撞避免方面进行额外的协作设计 [290]。为了应对上述挑战,现有研究通过深度强化学习 [291–293]、基于GNN的方法 [294–296] 或定制的模块化训练 [297–299] 来开发协作算法。

然而,多智能体协作的挑战远未得到充分解决。在更实际的场景中,多智能体系统通常面临通信限制(例如带宽和范围)[300]。此外,异构智能体(即具有不同功能和行为模式的智能体)的协作尚未得到充分探索,这既有意义又更具挑战性,因为它需要更多地考虑智能体的互补能力以及对任务更深入的场景理解 [301]。此外,与简单地导航到特定目标相比,多智能体系统可能需要执行更复杂的编队任务(例如,以领导者-跟随者配置进行集群飞行),而无法访问全局信息(即地图和所有智能体的状态),其中每个智能体必须以最小的转换导航到适当的目标,仅知道附近智能体的状态 [302, 303]。在这种情况下,从生物群体的集体行为(例如鸟类、鱼类和狼群)中汲取灵感可能是一个有前途且有趣的研究领域 [304, 305]。

6.3 具身导航的仿生神经结构

随着人工神经网络和系统的发展 [306],具身导航在准确性和效率方面不断取得突破。然而,我们距离创造出能够像生物有机体或人类一样与动态环境以及彼此之间自然安全地交互的具身智能体还很遥远。在自然界中,即使是小昆虫也能处理飞行、游泳和爬行等不同的行为模式,以及鲁棒的导航策略 [307, 308]。因此,现有的具身导航系统尚未弥合与生物神经系统之间的差距。

挑战在于如何将生物神经系统映射到具身智能体的感知、学习和行为。大多数现有的具身导航研究侧重于感知(例如,多模态传感器反馈 [179])和学习(例如,LLM驱动的具身策略 [286]),并取得了显著进展。另一方面,机器人设计方面的研究 [253, 309–311] 更侧重于“具身行为的智能”。这些研究支持这样一种观点,即在许多生物有机体的案例中,智能可以源于“具身性”本身 [312],例如昆虫的传感器分布 [313] 和动物的运动动力学 [314]。尽管做出了上述努力,但具身智能体感知、学习和行为解决方案的有效协调仍未解决。可能的方法包括:(i) 训练单个解决方案模块,然后将它们组装成完整的具身策略 [152],(ii) 采用端到端的自动训练方案 [194],或者 (iii) 进一步探索并从生物协调机制中汲取灵感 [315]。在未来探索验证这些方法的过程中,具身硬件 [316] 和生物机制 [317] 方面的更多支持和突破也可能是不可或缺的。

6.4 安全与隐私

随着具身AI应用的普及,具身智能体在公共场所和人类生活中扮演着越来越重要的角色。然而,具身智能体复杂的功能(例如导航、操作和问答)和计算范式(例如边缘计算)导致了更高的不确定性,并增加了其传感器、计算、通信和执行器遭受各种攻击的易感性,从而带来了严重的安全风险和挑战。现有一定数量的研究探讨了各种类型具身智能体的安全问题,例如社交机器人 [318]、无人机 [319]、无人地面车辆 [320, 321] 和高级自动驾驶 [322]。然而,专门针对具身导航安全性的讨论相对较少 [323]。在某种程度上,增强具身导航的鲁棒性(4.3小节)可以被视为确保安全的一个分支。

同时,由于具身智能体与非具身智能体相比能够从用户那里收集更多的私人信息 [324],用户隐私问题(例如训练数据泄露 [325] 和个人信息泄露 [326,327])在具身AI中变得越来越严重。最近,联邦学习已被引入具身导航,以提供一个保护隐私的具身智能体学习框架 [328]。当然,可以说,在具身导航领域,关于安全和隐私问题的研究仍然存在显著的空白。

7 结论

在本文中,我们对具身导航研究进行了深入的回顾。我们将文献分为四个关键领域:感知、导航策略、效率优化以及具身导航赋能的任务,并深入探讨了每个类别中的关键主题。我们还强调了仍然存在的重大挑战,包括真实世界的适用性、多智能体协作、仿生神经结构以及围绕安全和隐私的问题。我们希望本文能为研究人员和从业者提供对具身导航的透彻理解,并激励在这个充满希望且发展迅速的领域取得进一步的进展,从而成为一个基础性的参考文献。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)