在小红书学Agentic Workflow:一场技术概念的祛魅之旅

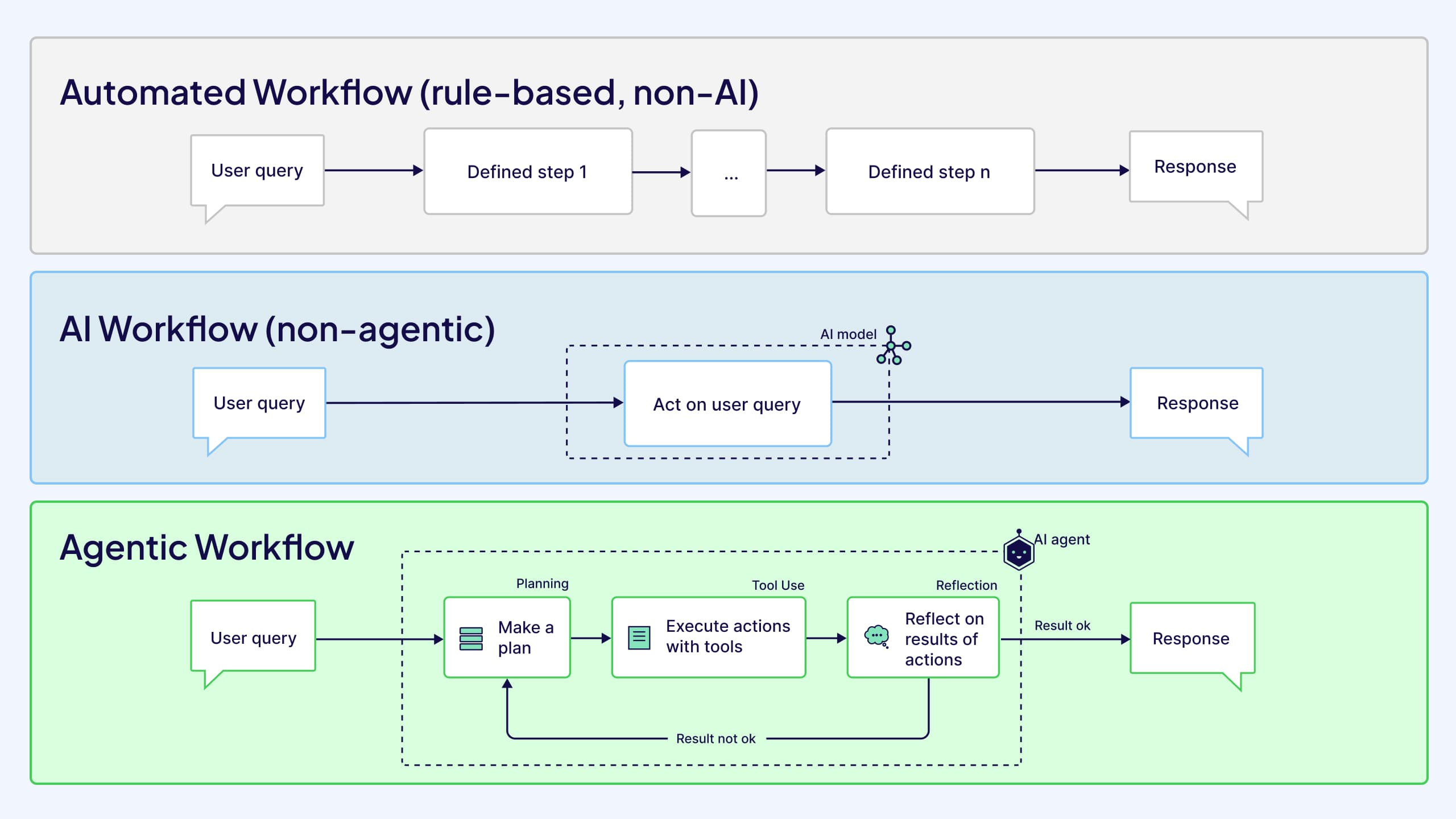

Agent强调自主决策能力(如任务拆解、动态纠错),依赖LLM的推理与规划能力。Workflow强调流程自动化(如条件判断、顺序执行),依赖预设规则与确定性逻辑。现在,当我们谈论agent时,大多时候是在讨论Agentic Workflow:在传统Workflow框架中嵌入LLM的动态决策能力,形成闭环任务编排引擎。Agentic Workflow设计包括四种模式:反思、工具使用、规划、多智能体协

背景

近期密集检索AI Agent技术资料时,观察到一个值得警惕的现象:在小红书/公众号等技术社区(别问我为啥在xhs学技术hhh),"X种Agent模式全解"类文章呈指数级传播。但细究内容好像都遵循工业化生产链路:机器翻译洗稿➡️概念排列组合➡️AI扩写充数(➡️知识付费)。当然,这片信息沼泽中仍有优质内容[手动狗头],需要我们仔细甄别。这或许就是当代技术学习者的必修课:在流量狂欢中修炼信息抗噪力。

|

|

|

在反复求证的过程中我意识到:Agent领域正在经历"术语通胀",而我们需要的是回归本源的"认知通缩"。

New technology brings with it a muddled mixture of confusing terminology, wild expectations, and self-proclaimed online experts.

这篇博客不追求宏大叙事,只是还原我的真实困惑:

-

Q1:当我们谈论Workflow和Agent时,我们究竟在讨论什么?

若仅将传统Workflow的节点替换为LLM调用(如从文案库查询文案→LLM生成文案),这是否构成真正的"智能体"?

这种改造是否只是自动化workflow的LLM包装,而非决策机制的质变?

Agent到底智能在哪?

-

Q2:Agent到底有哪几种较为本质(或者说基础的底层的?)模式?

各种模式大全仿佛在玩排列组合游戏,我能理解这些差异本质上是架构视角的不同:有人从任务流切分,有人从认知层级划分。

我们是否混淆了"技术实现细节"与"本质抽象范式"?

当前需要的不是叠加新模式,而是建立类似"冯·诺依曼结构"的底层认知坐标系——哪些是Agent的原子能力?哪些是工程层的变形?

一、Agent v.s. Workflow? --> Agentic Workflow

1.1 术语溯源:Agent与Workflow的前世今生

-

Agent(智能体)是指能够感知环境并自主采取行动以实现特定目标的实体。这并不是一个新的词,在LLM出现前,Agent在多智能体建模(ABM)和强化学习(RL)领域中已经被广泛的使用:

-

ABM中的Agent:具有自主决策能力的实体(如模拟人群疏散的虚拟人),遵循预设规则与环境交互。

-

RL中的Agent:通过试错策略最大化奖励(如AlphaGo),核心是状态-动作-奖励的闭环学习。

-

共同点:强调独立决策能力,但依赖明确规则或奖励函数设计。

-

-

Workflow(工作流)是任务流程的显式编排,广泛用于企业自动化

-

典型场景:数据ETL流水线、审批流程(如OA系统),节点间通过条件判断(If-Else)或顺序执行连接。

-

核心特征:确定性逻辑,依赖人工预设规则,无动态决策能力。

-

-

小结:Agent强调自主决策能力,Workflow强调流程自动化

1.2 LLM时代的Workflow演进:从自动化工作流到智能化工作流

refer: What Are Agentic Workflows? Patterns, Use Cases, Examples, and More

事实上我们现在说的无论是Workflow还是Agent,本质都是对任务节点的编排,最终还是落到Workflow。我的理解是:Agent引入LLM推动Workflow从静态规则走向动态智能。

1.2.1 自动化工作流(Automated Workflow)

-

基于预设规则的静态流程编排,任务节点通过条件判断(If-Else)或顺序执行连接。

-

确定性逻辑:流程完全依赖人工硬编码(如“文件上传→触发API→存入数据库”)。

-

无动态决策:仅执行明确指令,无法处理模糊需求。

1.2.2 AI工作流(AI-Augmented Workflow)

-

在传统Workflow中嵌入LLM能力,通过单步推理增强局部任务效率,但整体流程仍由人工预设。

-

LLM作为工具节点:仅替代特定人工操作(如NLP解析用户输入、生成文本摘要)。

-

流程固定:LLM不改变控制逻辑(如OCR识别发票→LLM提取字段→存入数据库)。

1.2.3 智能化工作流(Agentic Workflow)

-

LLM驱动的动态编排引擎,通过三大模块实现闭环流程(对应第2章核心模式):

-

Planner(规划器):LLM自主拆解任务(如"市场分析"→"抓取竞品数据→生成对比报告")。

-

Tool(工具调用):动态调用API/数据库突破静态知识限制。

-

Reflection(反思):自我验证结果合理性并修正错误(如发现数据矛盾时回溯流程)。

-

流程由LLM实时生成(非人工预设),实现动态决策与自主优化。

二、Agentic Workflow的模式

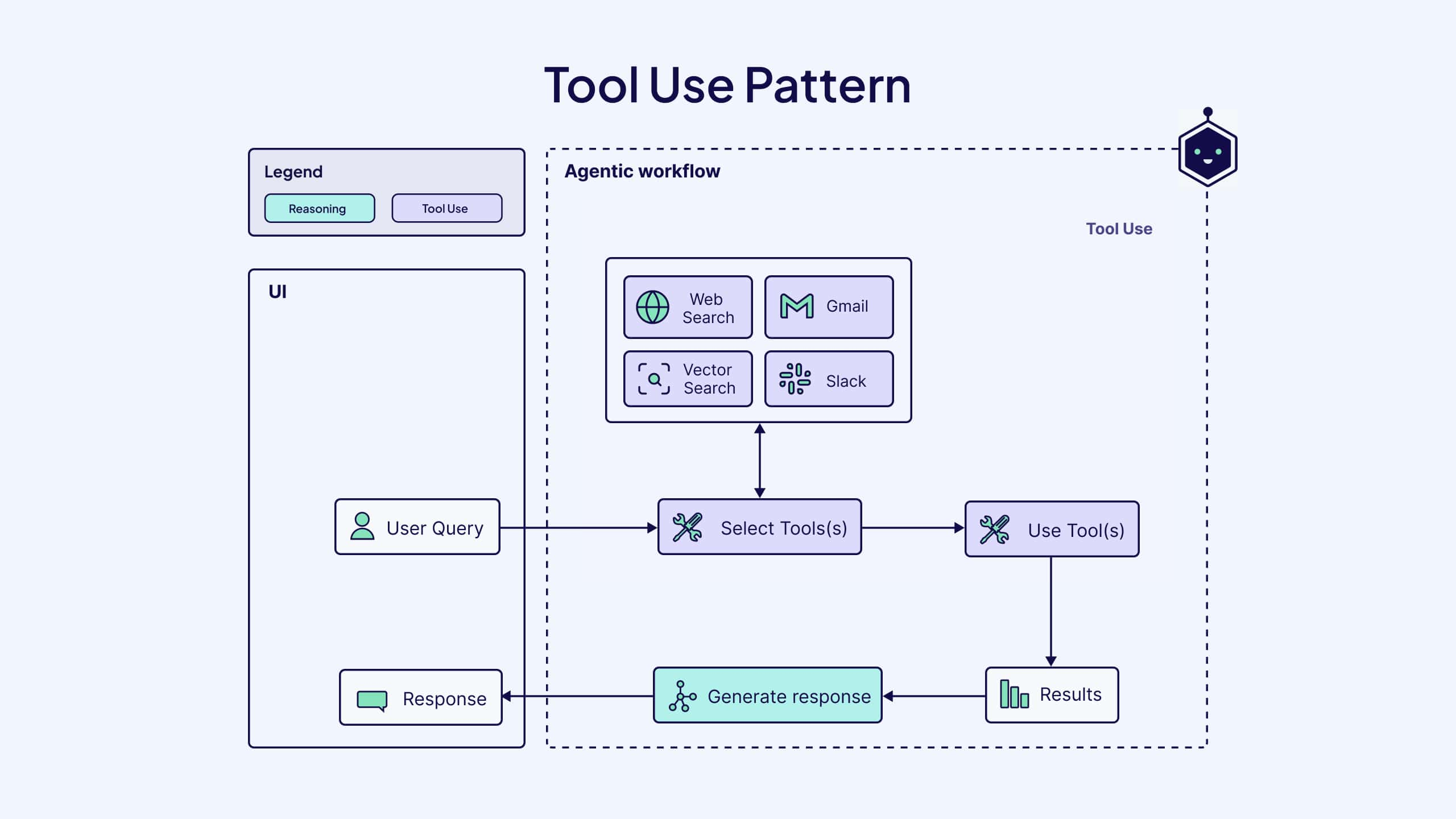

2.1 使用工具

工具调用能力感觉没啥好说的,是 Agentic Workflow 的“手脚”,使 LLM 从“纯语言模型”进化为“行动引擎”。通过调用外部工具突破静态知识边界,完成动态任务(如搜索网页、数据库检索、收发邮件)。

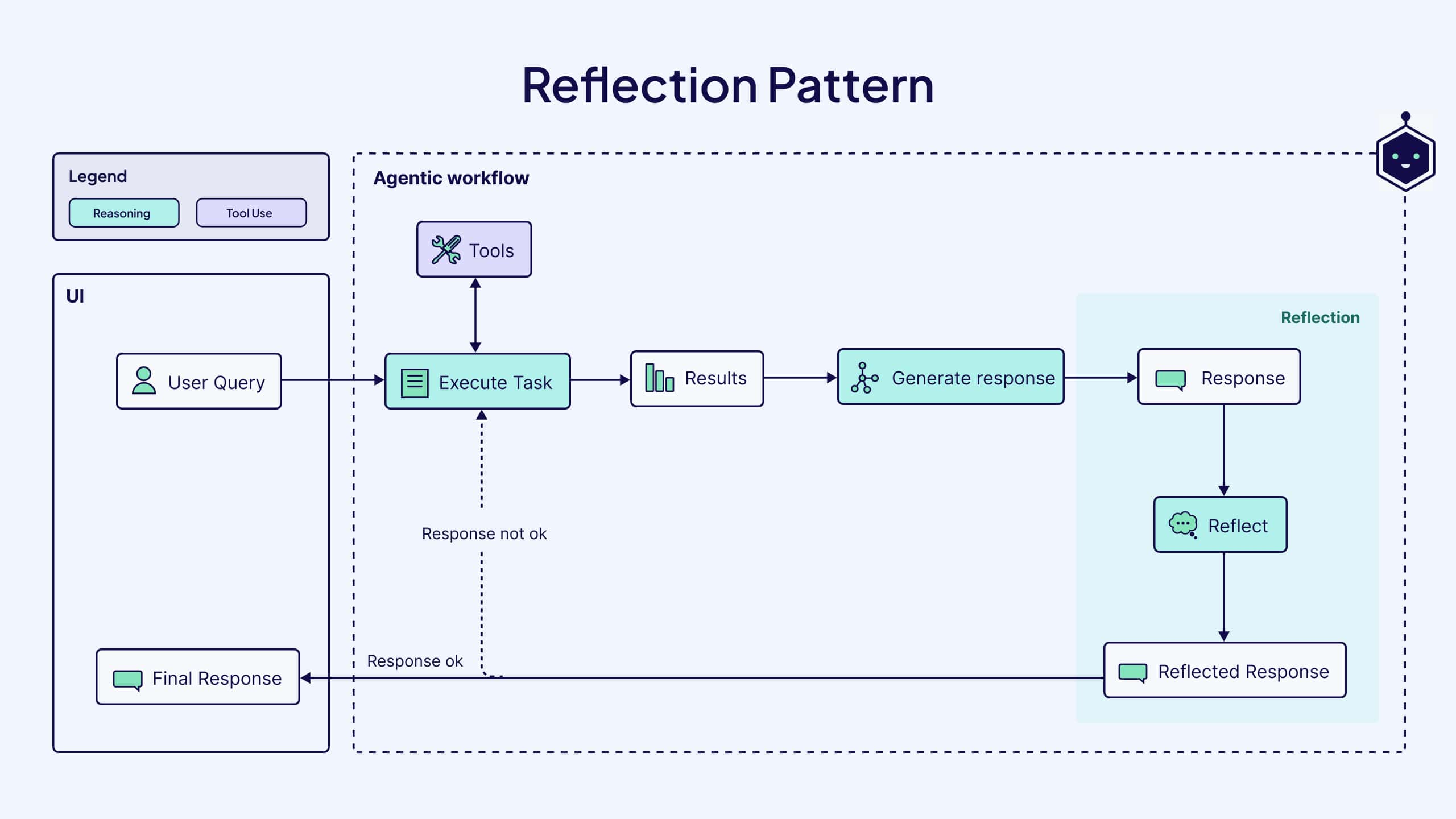

2.2 反射

-

反射模式是一种自反馈机制指让 Agent 审视和修正自己生成的输出。(其实最开始想写这篇文章就是看到小红书上有说这里需要用户反馈参与,但是我寻思我自己和 GPT 多轮对话让他帮我把文案修改到位,这是我给他纠错,咋就成他自己会反思了?)

-

这张图上的 Reflection 部分已经比较清晰了:是让 LLM 对 LLM 生成的 Response 进行反思,得到新的 Reflected Response。这里可以进行多轮 Reflect,生成初始 Response 的模型和进行反思的模型可以是同一个(如单模型切换角色),也可以是不同的(如 GPT-4 生成 + Llama-3 审核)。

-

这有点像 RL 中的 Actor-Critic Style——Actor 负责生成内容,Critic 负责评价内容并指导修正方向。

-

通过这种机制,LLM 的输出能在内部流程中完成自我校验和优化,而非依赖外部人工反馈。

[用户指令]

请帮写一篇带网感、含emoji的杭州美食攻略,适合小红书社区风格,要求:

① 不使用"最""首推""必吃"等绝对化用语;

② 每段不超过3句,用🔥、😋等表情符号点缀。

[LLM初稿]

杭州必吃的10家宝藏小店!🔥

1️⃣ 老张烤鸭:外皮酥脆到不行,杭州人从小吃到大的味道!

2️⃣ 阿婆豆腐脑:豆香浓郁,配红油简直绝绝子!😋

[反射触发]

请以"广告法合规官"身份审核以上内容,标记以下问题:

① 是否存在绝对化用语(如"必吃""首推");

② 是否有潜在虚假宣传风险(如"从小吃到大")。

[反思结果]

⚠️ 第1句:"必吃的10家" → 违反《广告法》第9条(绝对化用语)

⚠️ 第2句:"从小吃到大" → 存在"全民体验"的虚假暗示(《广告法》第28条)

⚠️ "绝绝子"虽非绝对化用语,但建议替换成更口语化的表达

[修正版]

杭州私藏的10家宝藏小店!🔥

1️⃣ 老张烤鸭:外皮酥脆到不行,杭州人常去的老字号!

2️⃣ 阿婆豆腐脑:豆香浓郁,搭配红油一口入魂!😋 反射模式的价值在于将多轮用户对话压缩为 LLM 内部流程,通过显性规则约束其"创意自由度",提升输出稳定性。但需清醒认知:目前 Agentic Workflow 的反思仍是 Prompt 驱动的表征操作,而非真正的元认知能力。

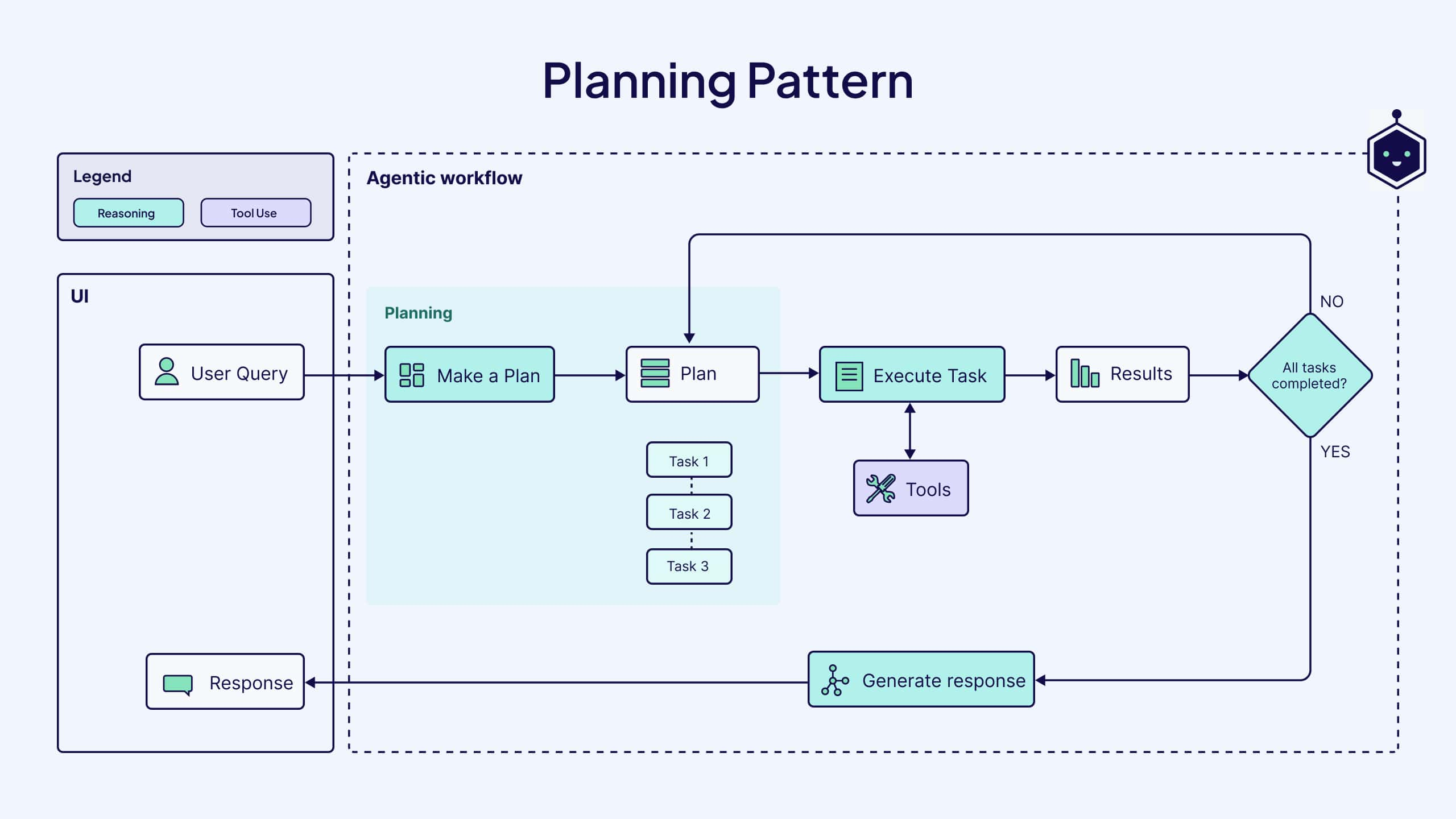

2.3 规划

规划模式是指 Agent 能将复杂任务分解为一系列子任务的过程,通过降低认知复杂度提升 LLM 的推理效率与输出质量。这种分解可以是层级化的(如目标→子目标→动作),也可以是流程化的(如条件判断→分支执行)。

总结

-

Agent强调自主决策能力(如任务拆解、动态纠错),依赖LLM的推理与规划能力。

-

Workflow强调流程自动化(如条件判断、顺序执行),依赖预设规则与确定性逻辑。

-

现在,当我们谈论agent时,大多时候是在讨论Agentic Workflow:在传统Workflow框架中嵌入LLM的动态决策能力,形成闭环任务编排引擎。

-

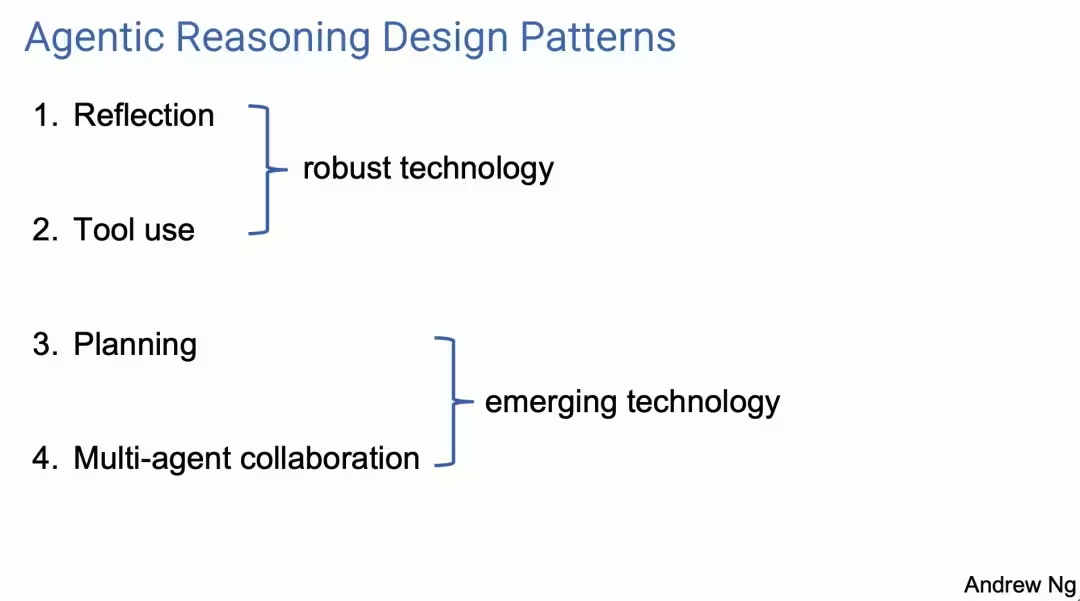

Agentic Workflow设计包括四种模式:反思、工具使用、规划、多智能体协作。第二小节中的模式和更早之前(20240326)吴恩达的Agentic Reasoning演讲中的模式基本相同,但比Andrew提出的少一个多智能体协作模式,即多个 Agent 扮演不同角色合作完成任务。

-

刚开始写这篇的时候还没有找到Weaviate团队这篇博客,太对味了,后来1.2和二都搬运了他们的概念和图。What Are Agentic Workflows? Patterns, Use Cases, Examples, and More

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)