基于多智能体协作的 AI 搜索新架构设计

摘要:传统搜索引擎和RAG系统采用线性"检索-生成"流程,难以处理复杂推理任务。新一代多智能体协作AI搜索系统通过模块化分工解决了这一瓶颈,由Master智能体调度、Planner智能体拆解任务、Executor执行操作、Writer整合答案。该系统采用动态能力边界、COLT工具检索、DAG任务规划等关键技术,在复杂问题处理上表现优异,人工测试显示其对复杂查询的胜率比传统系统高

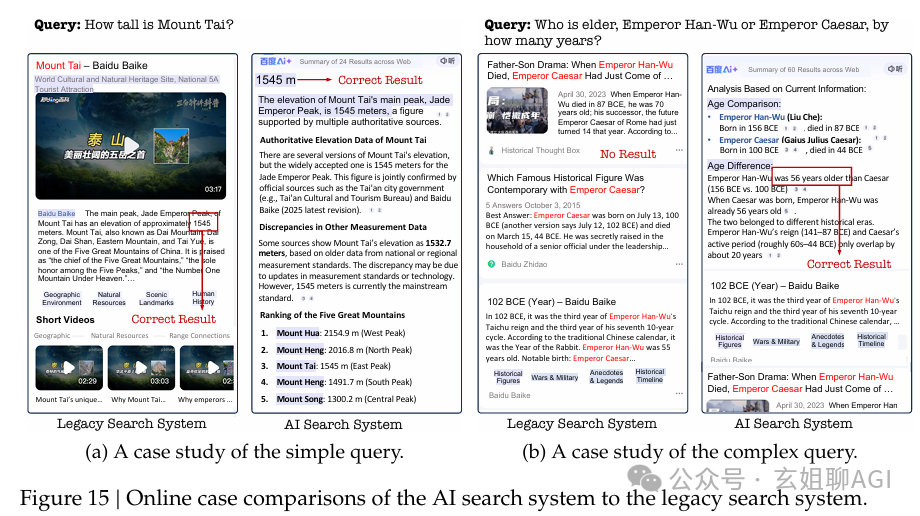

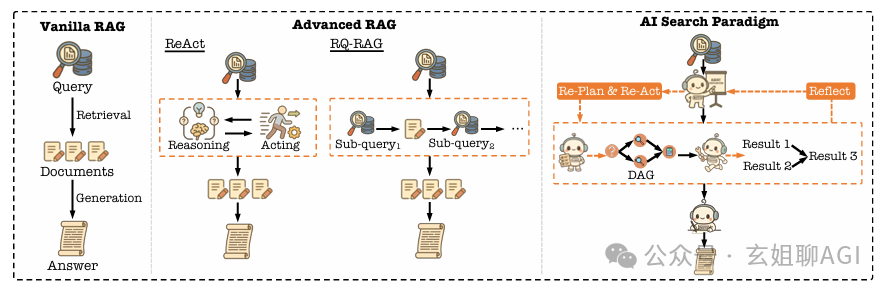

传统搜索引擎和 RAG 系统多为“检索-生成”线性流程,难以应对复杂、多步骤推理任务。这正是当前搜索引擎(即使是集成了大模型的 RAG 系统)所面临的瓶颈。它们擅长回答事实性问题,但在面对需要深度推理、多步规划和工具协同的复杂任务时,就显得力不从心。

因此需要一个模块化、多智能体协作的 AI 搜索系统,模拟人类信息处理与决策过程,具备更强的推理、规划和工具使用能力。

下文详细剖析之。

01

搜索引擎的架构演进

搜索引擎经历了从关键词到多 AI 智能体协作的架构演进,分为三个架构阶段

第一、词法搜索时代:关键词匹配的基础阶段

早期的搜索引擎,比如:Google 和百度,主要依赖关键词匹配技术。用户输入“苹果”,系统返回包含“苹果”这个词的网页。这种方式简单直接,但无法理解词语背后的语义。比如:它分不清“苹果”是指水果、科技公司,还是其他含义,常常导致搜索结果答非所问。

第二、机器学习时代:Learning-to-Rank 提升排序质量

随着机器学习的发展,搜索引擎引入了 Learning-to-Rank 技术,通过综合网页权威性、点击率、内容质量等上百种特征,对搜索结果进行更精准的排序。这一阶段显著提升了搜索结果的相关性。然而,系统仍然返回的是一组网页链接,用户需要自行点击、阅读和整合信息,体验上仍显繁琐。

第三、大模型与 RAG 时代:从“给链接”到“给答案”

以ChatGPT、Perplexity.ai 为代表的新一代搜索系统,借助大语言模型(LLM)和检索增强生成(RAG)技术,能够直接生成一段通顺、整合后的答案。这标志着搜索体验的一次重大飞跃–从“给你鱼竿”变成了“直接给你鱼”。

RAG 的局限:线性思维,难以应对复杂推理

尽管 RAG 系统已经具备了强大的知识整合能力,但它更像一个知识渊博但思维线性的助理。它能轻松回答“汉武帝是谁”,却难以处理“汉武帝和凯撒谁年龄更大,大多少岁?”这样的复杂问题。

因为这类问题需要多步骤推理:

- 分别检索两位历史人物的信息;

- 验证信息的准确性;

- 调用计算工具进行年龄差计算;

- 最后整合成完整答案。

这正是新时代的搜索引擎所关注的核心问题:如何让搜索引擎具备像人类专家团队一样的能力,能够分解任务、协同工作,并灵活调用多种工具来解决复杂问题?

02

基于多智能体协作 AI 搜索引擎新架构

1、基于多智能体协作的 AI 搜索引擎新架构设计

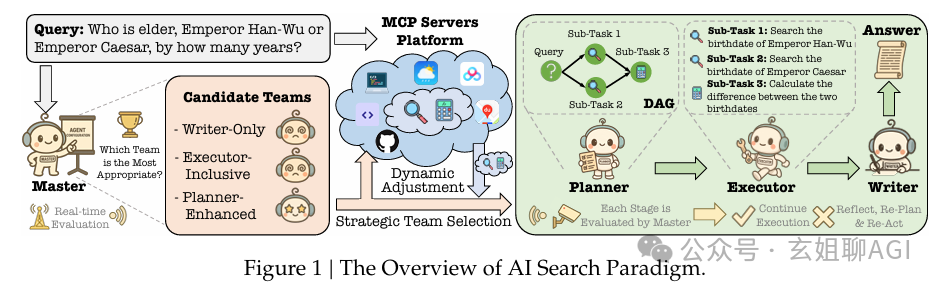

AI 搜索引擎新架构是一个由四个大语言模型(LLM)驱动的 AI 智能体组成的模块化协作新架构,如下图所示。你可以把它想象成一个高效的专家团队,每个成员各司其职,协同完成复杂的咨询任务。

基于多智能体协作的成员介绍如下:

Master(指挥官)智能体

- 职责:团队的大脑与总调度。

- 工作方式:当用户提出查询时,Master 首先分析任务复杂度,判断是简单问题还是复杂任务。它像一位经验丰富的项目经理,决定是派“初级员工”处理,还是组建“精英小组”协同攻关。

Planner(规划师)智能体

- 职责:只在复杂任务中被激活,负责将模糊的大问题拆解为可执行的小步骤。

- 工作方式:它会构建一个有向无环图(DAG),明确每个子任务的内容、依赖关系和所需工具。比如:将“比较汉武帝和凯撒的年龄”拆解为搜索生卒年份、验证信息、计算差值等步骤。

Executor(执行者)智能体

- 职责:团队的“双手”,负责具体执行任务。

- 工作方式:它拥有一个“工具箱”,包括网络搜索、计算器、代码解释器等。根据 Planner 的计划,Executor 调用合适工具获取信息或进行计算,并反馈结果。

Writer(作家)智能体

- 职责:团队的“笔杆子”,负责整合所有执行结果。

- 工作方式:它不仅汇总信息,还会进行去重、消除矛盾、补充背景,最终生成一份逻辑清晰、内容丰富、语言流畅的高质量答案。

系统升级:从“问答机”到“多智能体协作系统”

通过这四个 AI 智能体的动态协作,AI 搜索系统实现了从“关键词匹配”到“理解-规划-执行-综合”的全流程智能化升级。这不仅提升了系统的推理能力和任务适应性,也让用户体验更接近于与一支真正的专家团队对话。

2、基于多智能体协作的 AI 搜索引擎新关键技术

基于多智能体协作的架构设计只是第一步,真正让这套 AI 搜索系统落地的是为每个 AI 智能体量身定制的技术实现路径。下面,我们深入拆解这套系统架构设计的关键技术。

Master(指挥官):智能调度的决策核心

Master 的核心能力是动态任务分配。它会根据用户查询的复杂度,灵活选择三种执行模式:

这种按需调度机制,让系统在不同任务中实现效率与效果的最佳平衡。

Planner(规划师):化繁为简的“任务拆解专家”

Planner 是系统的技术核心,负责将复杂问题拆解为可执行的子任务。其关键技术包括:

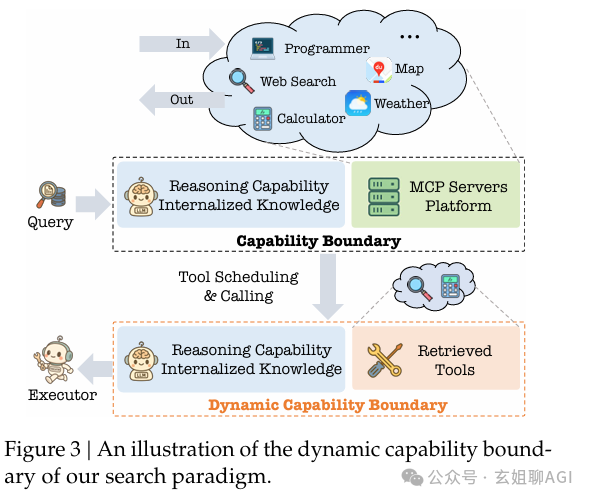

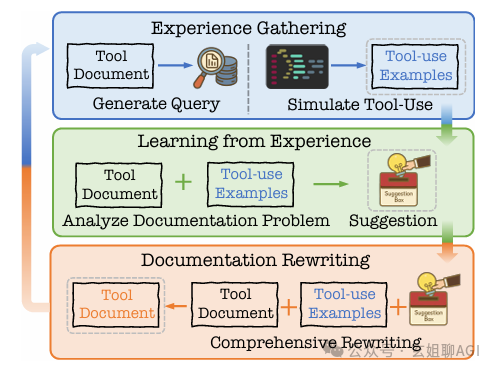

动态能力边界(Dynamic Capability Boundary)

- 不将所有工具一次性交给 Planner,而是根据查询语义,先通过工具检索模块筛选出最相关的十几个工具。

- 这个“小而精”的工具集 + LLM 的推理能力,共同构成当前任务的“能力边界”,显著降低决策负担。

面向完整性的工具检索(COLT)

- 传统工具检索只关注单个工具的相关性,而 COLT 通过图学习建模工具之间的协作关系。

- 比如:“5盎司黄金 + 100股亚马逊股票 = 多少人民币?”需要金价、股价、汇率三类工具协同完成。

- COLT 确保检索出的不是单个工具,而是一个功能完整的工具组合(场景)。

基于 DAG 的任务规划

- Planner 输出的是一个 JSON 格式的有向无环图(DAG),明确每个子任务的依赖关系与执行顺序。

- 采用“思维链 → 结构化草图”提示词策略,一次前向传播即可生成全局任务图,避免 ReAct 式的高延迟迭代。

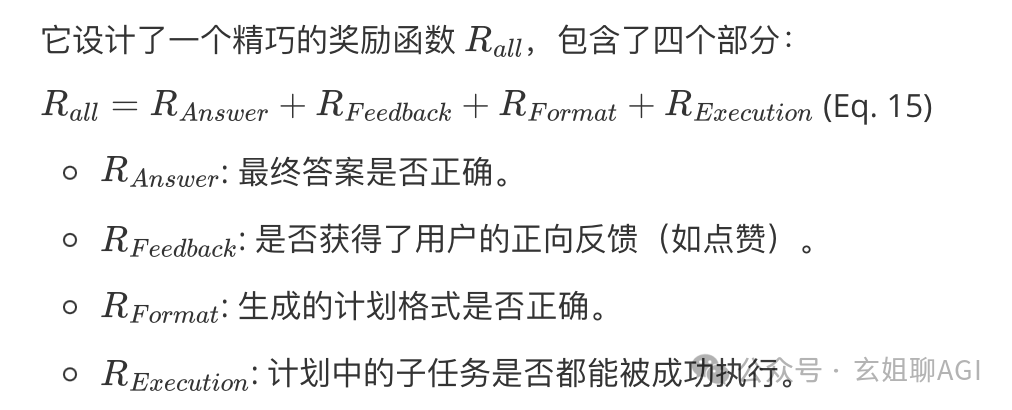

强化学习优化(RL-Enhanced Planning)

-

使用 GRPO 等强化学习算法优化 Planner策略,奖励包括:

-

- 最终答案正确性;

- 用户反馈;

- 格式规范性;

- 子任务执行成功率。

-

让 Planner 学会制定可执行、正确且用户满意的任务计划。

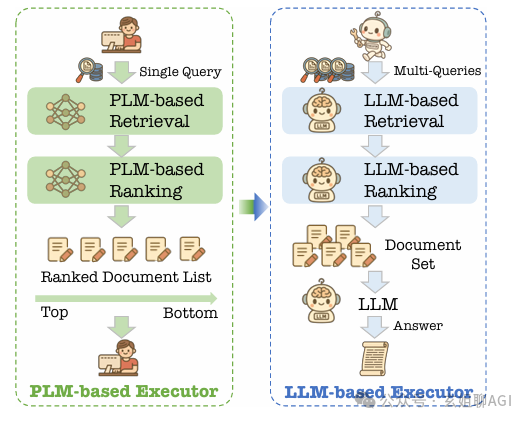

Executor(执行者):精准执行与 LLM 偏好对齐

Executor 的目标是:不是满足用户,而是满足 Writer。因为只有 Writer “满意”了,最终答案质量才能高。

LLM 标注(LLM Labeling)

-

用 LLM 替代人工进行文档排序标注,支持大规模数据构建。

-

采用两种高效的 Listwise 排序方法:

-

- RankGPT:滑动窗口策略,支持超长文档列表排序。

- TourRank:模拟体育锦标赛赛制,分组淘汰+积分制,高效并行排序。

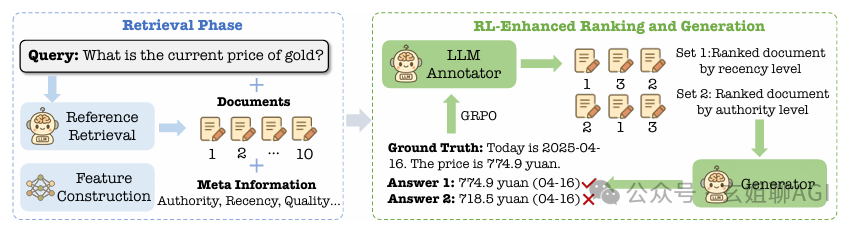

生成奖励(Generation Reward)

- Executor 可输出多种排序策略(比如:“权威性优先”或“时效性优先”)。

- Writer 用不同策略生成答案,系统根据最终答案质量反推哪种排序更好,从而优化 Executor。

Writer(作家):鲁棒生成与多智能体联合优化

Writer 负责“临门一脚”,将 Executor 提供的信息整合成高质量答案。其关键技术包括:

对抗性调优(ATM:Adversarial Tuning Multi-agent)

- 引入“攻击者” AI 智能体,故意在文档中插入噪声、打乱顺序、制造干扰。

- Writer 在“有毒输入”中训练,提升其对错误信息的鲁棒性和辨别能力。

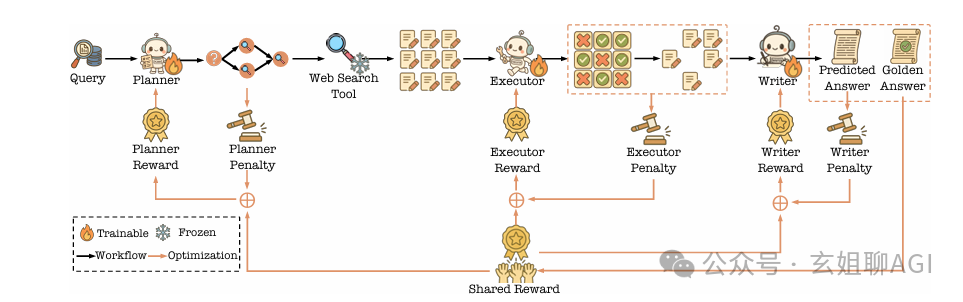

多智能体联合优化(MMOA-RAG)

- 将 Planner、Executor、Write r视为一个团队,使用 MAPPO(多智能体强化学习)进行联合训练。

- 所有 AI 智能体共享一个全局奖励(比如:最终答案的 F1 分数),并引入惩罚项防止冗余、错误、冗长。

- 实现从“局部最优”到“全局最优”的协同进化。

总结:从“问答机”到“智能协作系统”

通过这四大 AI 智能体的精密协作,AI 搜索系统实现了从“关键词匹配”到“理解-规划-执行-综合”的全流程智能化。这不仅提升了搜索系统的推理能力与任务适应性,也为下一代信息检索系统提供了可扩展、可解释、可优化的技术范式。

3、基于多智能体协作的 AI 搜索引擎测试结果

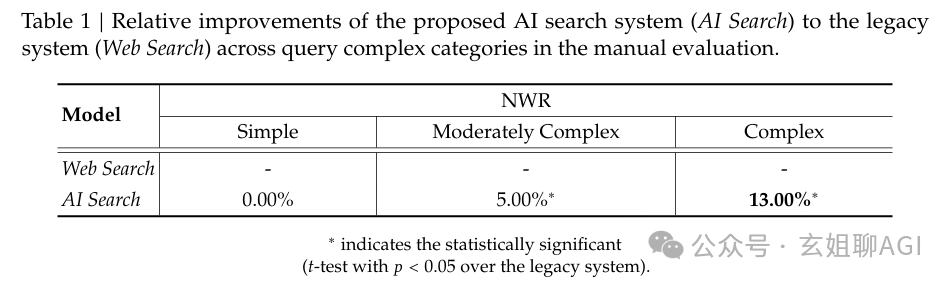

第一、人工评估:复杂问题处理能力显著领先

为了验证系统效果,邀请专业标注员对 AI 搜索系统与传统搜索系统的结果进行盲测对比。结果显示(见下表):

- 简单查询:两者表现相当,难分伯仲。

- 中等复杂度查询:AI 搜索系统的归一化胜率(NWR)高出 5.00%。

- 复杂查询:AI 搜索系统的优势进一步扩大,NWR 高出 13.00%。

这组数据充分说明,在面对复杂问题时,多智能体协作框架带来了质的飞跃,显著提升了搜索系统的理解力与回答质量。

总之,在企业落地基于多智能体协作的 AI 新搜索引擎,需要重点关注以下3点:

更强的鲁棒性与自我修复能力

当前系统在面对规划错误、工具调用失败等异常情况时,仍可能出现整体失效。未来的关键在于构建具备自我诊断与反思机制的 AI 智能体系统。当某个环节出错时,系统应能自动识别问题、回溯流程并重新规划任务路径,而非直接崩溃或输出错误结果。

极致的效率与成本优化

尽管多智能体协作带来了强大的推理能力,但也伴随着较高的计算延迟与资源消耗。未来需在以下方向持续突破:

- 使用更轻量的模型结构(比如:局部注意力、模型剪枝);

- 引入高效的推理框架(比如:推测解码、语义缓存、量化部署);

- 优化任务调度与资源分配策略,实现性能与成本的最佳平衡。

更深度的可解释性

用户不仅需要答案,更需要理解答案的生成逻辑与信息来源。未来的 AI 搜索系统应提供清晰的推理链条,包括:

- 每一步的任务拆解与执行过程;

- 所引用信息的来源、权威性与时效性;

- 工具调用顺序与中间结果展示。

这将极大增强基于多智能体协作的 AI 搜索新系统的透明度与用户信任,为 AI 搜索在医疗、金融、教育等高敏感领域的落地奠定基础。

最后

选择AI大模型就是选择未来!最近两年,大家都可以看到AI的发展有多快,我国超10亿参数的大模型,在短短一年之内,已经超过了100个,现在还在不断的发掘中,时代在瞬息万变,我们又为何不给自己多一个选择,多一个出路,多一个可能呢?

与其在传统行业里停滞不前,不如尝试一下新兴行业,而AI大模型恰恰是这两年的大风口,整体AI领域2025年预计缺口1000万人,人才需求急为紧迫!

由于文章篇幅有限,在这里我就不一一向大家展示了,学习AI大模型是一项系统工程,需要时间和持续的努力。但随着技术的发展和在线资源的丰富,零基础的小白也有很好的机会逐步学习和掌握。

【2025最新】AI大模型全套学习籽料(可白嫖):LLM面试题+AI大模型学习路线+大模型PDF书籍+640套AI大模型报告等等,从入门到进阶再到精通,超全面存下吧!

获取方式:有需要的小伙伴,可以微信扫描下方CSDN官方认证二维码免费领取【保证100%免费】

包括:AI大模型学习路线、LLM面试宝典、0基础教学视频、大模型PDF书籍/笔记、大模型实战案例合集、AI产品经理合集等等

大模型学习之路,道阻且长,但只要你坚持下去,一定会有收获。本学习路线图为你提供了学习大模型的全面指南,从入门到进阶,涵盖理论到应用。

L1阶段:启航篇|大语言模型的基础认知与核心原理

L2阶段:攻坚篇|高频场景:RAG认知与项目实践

L3阶段:跃迀篇|Agent智能体架构设计

L4阶段:精进篇|模型微调与私有化部署

L5阶段:专题篇|特训集:A2A与MCP综合应用 追踪行业热点(全新升级板块)

AI大模型全套学习资料【获取方式】

更多推荐

已为社区贡献16条内容

已为社区贡献16条内容

所有评论(0)