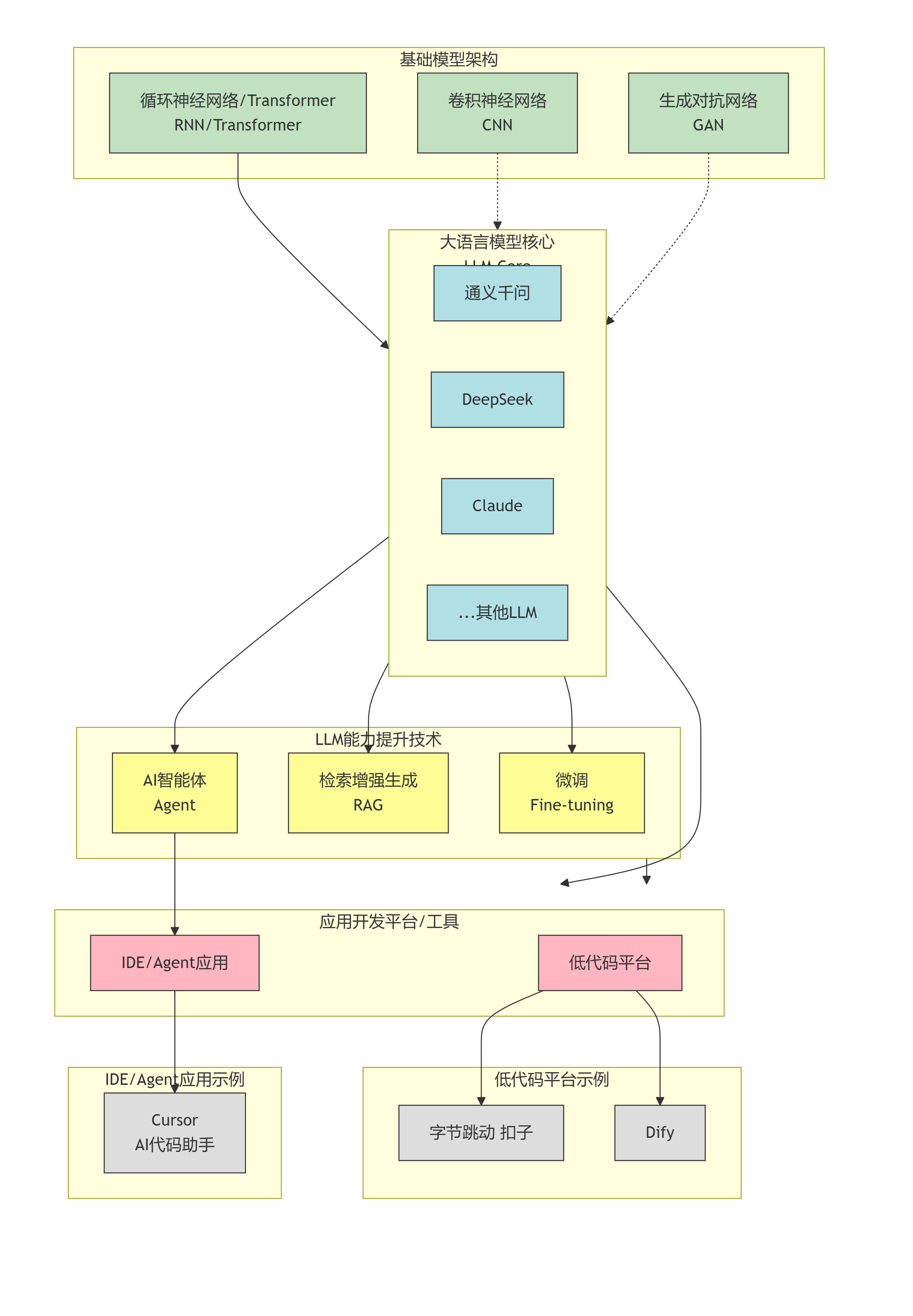

生成式AI应用开发与技术生态

技术演进:从基础的神经网络架构(CNN/RNN/Transformer/GAN)演进到强大的LLM。能力增强:通过Fine-tuning、RAG、Agent等技术,让通用LLM变得专精、可靠和主动。应用落地:通过扣子、Dify、Cursor等工具,将复杂的技术封装成易用的产品,最终赋能给每一个开发者和企业。

分层归类与关系详解

这个图从上到下,可以看作是一个从理论基础到具体应用的技术栈。

第一层:基础模型架构

这是所有现代AI模型的理论基础和构建模块。

-

CNN(卷积神经网络): 主要用于计算机视觉领域(图像、视频)。虽然LLM本身不是CNN,但其理解多模态信息(如图片)时,可能会借用CNN的思想或模块进行视觉特征提取。

-

RNN/Transformer: 这是大语言模型(LLM)的核心。早期RNN用于处理序列,但Transformer架构(特别是其中的Self-Attention机制)的出现,使得模型能够并行处理大量数据并捕捉长距离依赖,从而催生了如今的LLM。LLM是Transformer架构最成功的应用。

-

GAN(生成对抗网络): 主要用于生成高质量、逼真的数据(如图像、音频)。它与LLM属于不同的技术路径,但目标有重叠(生成内容)。在生态中,它与LLM是并列且互补的关系。

关系: Transformer架构是LLM的直接基石,而CNN和GAN是其他AI生成任务的重要基础。

第二层:大语言模型核心

这一层是预训练好的、具有通用能力的基座模型。它们是构建应用的“发动机”。

-

通义千问、DeepSeek、Claude: 这些都是具体的LLM产品/公司,它们基于第一层的Transformer架构在海量数据上训练而成,提供了强大的语言理解和生成能力。

关系: 它们是基于Transformer架构的具体实现,是上层技术和应用的能力来源。

第三层:LLM能力提升技术

为了让通用的LLM更好地适应特定任务,我们需要这些“增强”技术。

-

Fine-tuning(微调): 在特定领域的数据集上对预训练好的LLM进行额外训练,使其成为该领域的专家。例如,用一个法律文本库微调LLM,使其能更好地处理法律咨询。

-

RAG(检索增强生成): 为LLM连接一个外部知识库(如数据库、文档)。当回答问题时,先检索相关信息,再让LLM基于这些信息生成答案。这解决了LLM的“幻觉”和知识陈旧问题。

-

AI Agent(智能体): 这不是单一技术,而是一个系统。它让LLM作为“大脑”,能够理解目标、制定计划、调用工具(如计算器、API、搜索引擎)并执行行动,以完成复杂任务。

关系:

-

Fine-tuning 和 RAG 是提升LLM表现的两大互补技术路线(一个改变模型本身,一个增强模型输入)。

-

AI Agent 是更高级的形态,它可以将Fine-tuned的LLM作为核心,并利用RAG来获取知识,同时还能调用外部工具。

第四层:应用开发平台/工具

这一层让开发者和企业能够低门槛地使用前三层的能力,快速构建应用。

-

低代码平台: 如扣子、Dify。它们将LLM、Fine-tuning、RAG、Agent等能力封装成图形化界面和模块,用户通过拖拽和配置就能构建AI应用,无需深厚的技术背景。

-

IDE/Agent应用: 如Cursor。它是一个集成了AI编程助手的代码编辑器,其本质就是一个为编程场景专门优化的AI Agent,它能理解你的代码意图,帮你编写、修复和解释代码。

关系:

-

这些平台和工具直接调用第二层的LLM,并集成第三层的各种增强技术。

-

它们是将AI技术转化为实际生产力的最终出口。

总结

这个图谱清晰地展示了:

-

技术演进:从基础的神经网络架构(CNN/RNN/Transformer/GAN)演进到强大的LLM。

-

能力增强:通过Fine-tuning、RAG、Agent等技术,让通用LLM变得专精、可靠和主动。

-

应用落地:通过扣子、Dify、Cursor等工具,将复杂的技术封装成易用的产品,最终赋能给每一个开发者和企业。

更多推荐

已为社区贡献1条内容

已为社区贡献1条内容

所有评论(0)