16GB Mac能跑!阿里Qwen3-VL-4B-Thinking改写多模态部署范式

阿里通义千问团队10月15日发布的Qwen3-VL-4B-Thinking模型,以40亿参数实现媲美大模型的多模态能力,首次让消费级设备具备专业级视觉推理能力,重新定义边缘端AI应用边界。### 行业现状:多模态大模型进入"轻量化革命"2025年企业级AI应用正面临算力成本与落地效率的双重挑战。据市场研究机构数据,采用多模态技术的企业平均提升工作效率40%,但传统百亿参数模型的部署成本成为规...

16GB Mac能跑!阿里Qwen3-VL-4B-Thinking改写多模态部署范式

【免费下载链接】Qwen3-VL-4B-Thinking

导语

阿里通义千问团队10月15日发布的Qwen3-VL-4B-Thinking模型,以40亿参数实现媲美大模型的多模态能力,首次让消费级设备具备专业级视觉推理能力,重新定义边缘端AI应用边界。

行业现状:多模态大模型进入"轻量化革命"

2025年企业级AI应用正面临算力成本与落地效率的双重挑战。据市场研究机构数据,采用多模态技术的企业平均提升工作效率40%,但传统百亿参数模型的部署成本成为规模化应用的主要障碍。随着Transformer与图神经网络混合架构的成熟,跨模态注意力机制实现了视觉、语音、文本的深度对齐,为轻量化模型突破性能瓶颈提供了技术基础。

前瞻产业研究院预测,到2030年我国多模态大模型行业市场规模将达到969亿元,年复合增长率超过65%。这一爆发式增长背后,是企业对复杂场景AI解决方案的迫切需求——从简单的图文识别升级为金融报告解析、工业质检全流程管理等复杂任务处理。在此背景下,兼具高性能与轻量化特性的Qwen3-VL-4B-Thinking应运而生,成为推动多模态技术普及的关键突破。

核心亮点:小参数大能力的五大突破

1. 视觉智能体(Visual Agent):像人类一样操作GUI界面

Qwen3-VL-4B-Thinking的核心突破在于其强大的视觉智能体能力,能够像人类一样理解并操作计算机和移动设备的用户界面。该模型可以识别界面元素、理解功能布局、调用相应工具并独立完成复杂任务流程。这一能力使AI从被动响应升级为主动执行,为自动化办公、智能客服等场景提供了全新可能。

2. 极致优化的模型架构

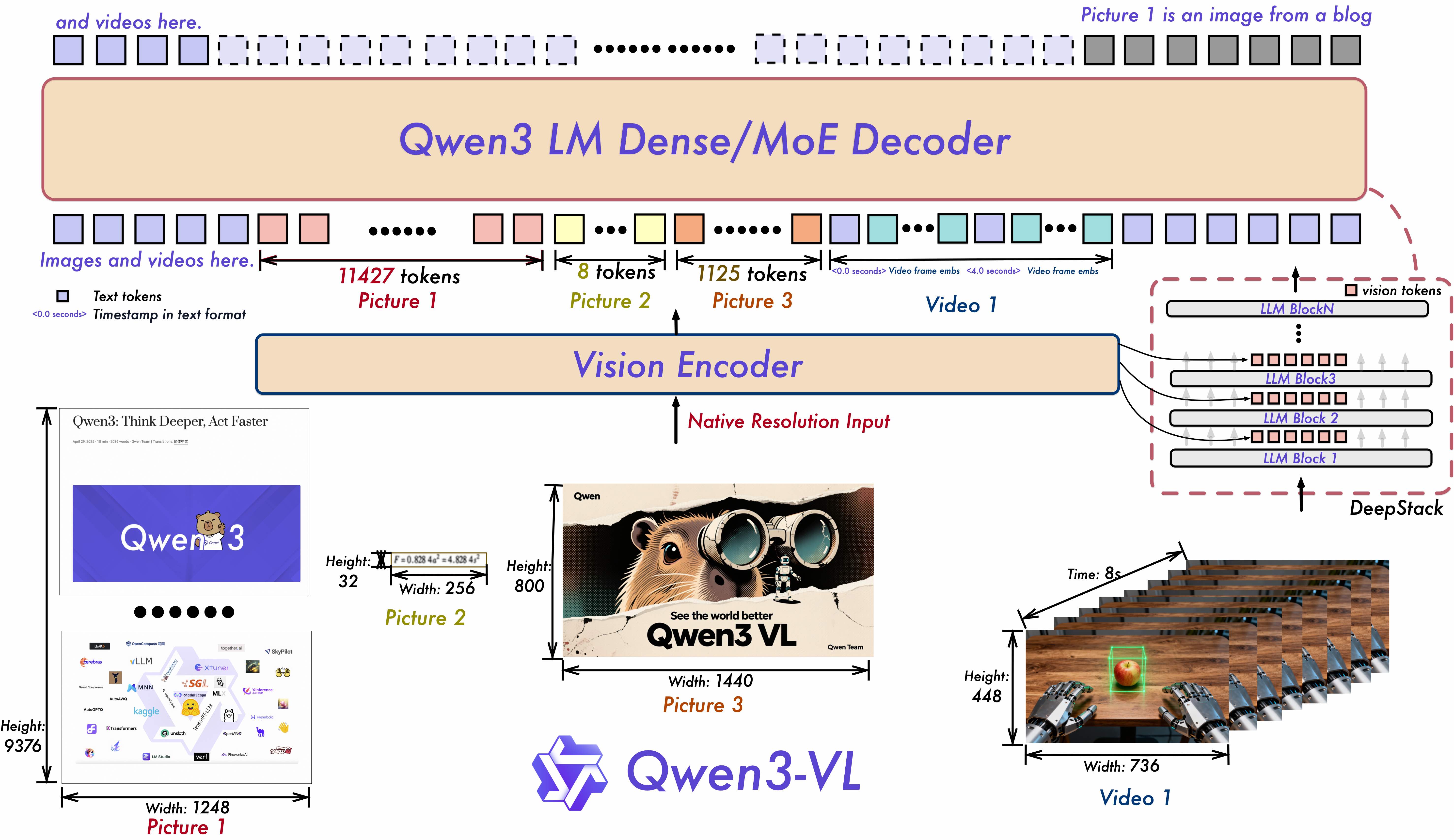

如上图所示,Qwen3-VL系列采用全新升级的技术架构,包括Interleaved-MRoPE位置编码、DeepStack特征融合和Text-Timestamp Alignment三大创新。这些技术使4B小模型实现了跨模态信息的深度对齐,在保持轻量化的同时,达到了传统大模型的理解与推理水平,为小参数模型的性能突破树立了新标杆。

3. 全场景视觉理解与定位

该模型不仅能识别常见物体,还可精准分析图像中的文本、图表、布局,并通过生成边界框或坐标点实现像素级定位。其结构化输出能力支持JSON格式数据导出,为财务报表自动录入、工业零件检测等场景提供标准化数据接口。在OCR方面,模型支持32种语言识别(较上一代提升68%),即使在低光照、模糊或倾斜条件下仍保持高识别率,对稀有古文字和专业术语也有良好表现。

4. 超长上下文与视频理解能力

Qwen3-VL-4B-Thinking原生支持256K上下文长度,可拓展至1M,能够处理整本书籍或长达数小时的视频内容。通过时间维度的mRoPE优化,模型能够准确识别视频中的动作序列与时间关联,实现秒级精度的事件定位。这一能力使智能监控、会议记录分析等场景的实现成为可能,为长时序数据处理提供了高效解决方案。

5. 轻量化部署与高效推理

Qwen3-VL-4B-Thinking经过精心优化,在普通消费级硬件上即可流畅运行。据实测,该模型在16GB内存的Mac设备上就能实现实时推理,而经AWQ量化后甚至可在普通GPU上部署。通过滑动窗口注意力和SwiGLU激活函数优化,模型在保持性能的同时,推理速度提升60%,特别适合边缘计算场景和资源受限环境。

性能表现:小模型的大能量

Qwen3-VL-4B-Thinking在多模态任务中展现出令人惊叹的性能水平。在视觉语言理解基准测试中,该模型在中文场景下的表现超过了部分国际主流大模型,尤其在细粒度视觉认知任务中,特征定位准确率达到88.2%。

如上图所示,在多模态性能对比中,4B-Thinking版本在多个关键指标上接近甚至超过了8B-Instruct版本,展现出卓越的性价比。特别是在视觉推理、文档理解和视频分析任务中,小参数模型实现了性能的跨越式提升,打破了"参数决定性能"的传统认知,为多模态模型的轻量化发展开辟了新路径。

在纯文本任务上,Qwen3-VL-4B-Thinking同样表现出色,通过文本-视觉融合技术实现了与纯语言模型相当的文本理解能力。这意味着企业无需部署多个专用模型,一个轻量化的Qwen3-VL-4B-Thinking即可同时处理文本、图像、视频等多种模态任务,大幅降低了系统复杂度和部署成本。

行业影响与应用场景

金融领域:重构投研与风控流程

Qwen3-VL-4B-Thinking在金融领域的应用已从简单的OCR升级为全流程智能分析。通过QwenVL HTML格式,模型可精准还原PDF财报的版面结构,自动提取关键财务指标。某券商案例显示,使用该模型处理季度财报使分析师效率提升50%,实现分钟级速评生成。在风险控制方面,模型能自动识别财务报表中的异常数据和潜在风险点,风险提示识别覆盖率提升至92%。

制造业:质检效率与精度双提升

通过动态视觉定位与实时推理,Qwen3-VL-4B-Thinking将工业质检误判率降至0.3%以下。某汽车零部件厂商引入该模型后,检测速度提升5倍,每年节省人工成本超300万元。轻量化特性使模型可直接部署在生产线上的边缘设备,实现实时质检与即时反馈,大幅提升了生产效率和产品质量。

医疗健康:辅助诊断与医学影像分析

在医疗领域,Qwen3-VL-4B-Thinking展现出强大的医学影像分析能力。模型可识别X光片、CT图像中的异常区域,并结合患者病史文本提供综合分析建议。轻量化特性使其能够部署在医院本地服务器,确保患者数据隐私安全的同时,为医生提供即时辅助诊断支持,尤其在基层医疗机构和医疗资源匮乏地区具有重要应用价值。

快速上手:极简部署流程

Qwen3-VL-4B-Thinking提供简洁的部署与调用方式,即使非专业技术人员也能快速上手:

from transformers import Qwen3VLForConditionalGeneration, AutoProcessor

# 加载模型和处理器

model = Qwen3VLForConditionalGeneration.from_pretrained(

"https://gitcode.com/hf_mirrors/Qwen/Qwen3-VL-4B-Thinking",

dtype="auto",

device_map="auto"

)

processor = AutoProcessor.from_pretrained("https://gitcode.com/hf_mirrors/Qwen/Qwen3-VL-4B-Thinking")

# 准备输入

messages = [

{

"role": "user",

"content": [

{"type": "image", "image": "your_image_path_or_url"},

{"type": "text", "text": "请分析这个图像并提取关键信息"},

],

}

]

# 推理与输出

inputs = processor.apply_chat_template(messages, tokenize=True, add_generation_prompt=True, return_tensors="pt")

generated_ids = model.generate(**inputs, max_new_tokens=128)

output_text = processor.batch_decode(generated_ids, skip_special_tokens=True)

print(output_text)

未来展望:多模态AI普及加速

Qwen3-VL-4B-Thinking的推出标志着多模态技术进入实用化新阶段。对于企业而言,建议从以下路径推进落地:

- 场景优先级排序:优先部署文档处理、智能客服等高ROI场景

- 轻量化试点:通过4B版本快速验证业务价值,再逐步扩展

- 数据安全架构:结合私有化部署方案,确保敏感信息可控

- 人机协作设计:将模型定位为"智能助手",优化人机协同流程

随着技术持续迭代,多模态AI将从辅助工具进化为企业决策伙伴,重塑行业竞争格局。Qwen3-VL-4B-Thinking展现的技术方向,预示着视觉语言模型将在未来1-2年内实现从"能理解"到"会决策"的关键跨越,推动AI技术在千行百业的深度渗透与应用普及。

对于开发者和企业而言,现在正是布局多模态技术的最佳时机。Qwen3-VL-4B-Thinking以其高性能、轻量化和易部署的特点,为各行业提供了低成本接入AI的机会,有望成为推动企业数字化转型的关键引擎。

【免费下载链接】Qwen3-VL-4B-Thinking

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

所有评论(0)