IBM Granite 4.0-H-Micro-Base:30亿参数轻量级模型如何重塑企业AI部署

IBM于2025年10月推出的Granite-4.0-H-Micro-Base模型,以30亿参数规模实现了企业级AI应用的效能与成本平衡,其混合架构设计和多场景适配能力正在重塑行业对大模型部署的认知。## 行业现状:企业级AI应用的规模化拐点2025年中国企业AI应用已进入规模化落地阶段,78%的组织已部署AI技术,生成式AI使用率达75%,但超80%的企业尚未实现对EBIT的实质影响。金融...

IBM Granite 4.0-H-Micro-Base:30亿参数轻量级模型如何重塑企业AI部署

导语

IBM于2025年10月推出的Granite-4.0-H-Micro-Base模型,以30亿参数规模实现了企业级AI应用的效能与成本平衡,其混合架构设计和多场景适配能力正在重塑行业对大模型部署的认知。

行业现状:企业级AI应用的规模化拐点

2025年中国企业AI应用已进入规模化落地阶段,78%的组织已部署AI技术,生成式AI使用率达75%,但超80%的企业尚未实现对EBIT的实质影响。金融、制造等领域虽已实现智能风控、预测性维护等场景应用,但企业级价值转化仍面临技能短缺、数据质量参差及幻觉问题三大核心挑战。在此背景下,模型效率与部署成本成为制约AI规模化应用的关键瓶颈。

产品亮点:技术架构与性能的双重突破

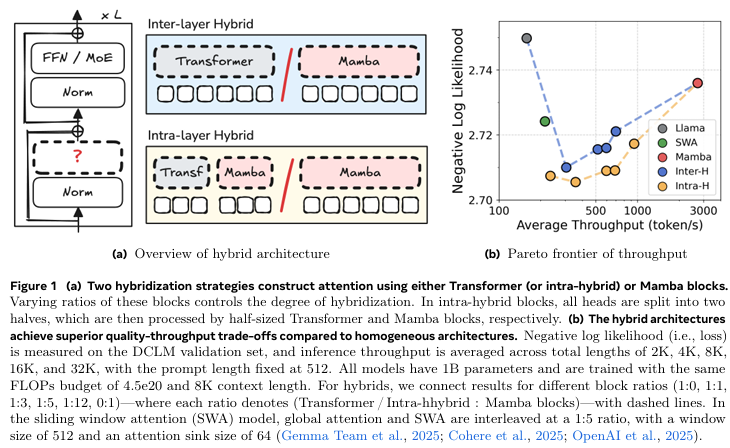

混合架构设计:Mamba2与Transformer的协同创新

Granite-4.0-H-Micro-Base采用创新的Mamba2与Transformer混合架构,突破传统Transformer模型处理长文本的效能瓶颈。这种设计使模型在处理复杂任务时内存使用量降低70%,推理速度提升2倍,同时支持更平价的GPU硬件,包括部分家用级设备。架构中融合的GQA(Grouped Query Attention)、SwiGLU激活函数和RMSNorm等技术组件,进一步优化了模型的计算效率和响应速度。

如上图所示,该图片展示了语言模型混合架构的两种设计策略(层间混合与层内混合)及其性能对比。左侧(a)图呈现了层间混合(顺序融合Transformer与Mamba块)和层内混合(并行融合两种机制)的结构差异;右侧(b)图通过负对数似然(NLL)和吞吐量指标对比,直观展现了混合架构在保持建模质量的同时,显著提升计算效率的优势。这一技术架构充分体现了Granite 4.0系列模型在性能与效率平衡上的突破,为企业级部署提供了理论基础。

企业级能力矩阵:从工具调用到多语言支持

该模型在保持轻量化特性的同时,构建了全面的企业级能力体系:

- 工具调用:支持OpenAI函数定义schema,在Berkeley Function Calling Leaderboard v3中以64.69分的成绩展现出高效的外部API集成能力

- 多语言处理:原生支持12种语言,在MMMLU多语言评测中获得58.5分,尤其在中文、日文等东亚语言处理上表现突出

- 代码能力:HumanEval代码生成任务pass@1指标达70.73%,支持Fill-In-the-Middle代码补全模式

- 安全对齐:通过ISO/IEC 42001:2023 AI管理系统认证,在SALAD-Bench安全评测中达到97.3分的高安全性

灵活部署选项:从云端到边缘的全场景覆盖

模型提供多种部署形态以适应不同企业需求:

- 支持IBM watsonx.ai、Dell Technologies、云镜像仓库等主流平台

- 兼容vLLM、llama.cpp等推理框架,可通过Unsloth进行高效微调

- 适配AMD Instinct MI-300X GPU与Qualcomm Hexagon NPU等多种硬件

- 提供Base与Instruct两种版本,后者针对对话场景优化

性能表现:小参数模型的大能力突破

基准测试成绩:超越同级别模型

在多项权威评测中,Granite-4.0-H-Micro-Base展现出优于同参数规模模型的性能:

- MMLU(多任务语言理解):67.43分,超越同参数级开源模型

- GSM8K(数学推理):63.76分,展现强逻辑推理能力

- HumanEval+(代码生成):67.07分,接近部分70亿参数模型水平

企业场景优化:聚焦实际业务价值

针对企业实际应用场景,模型特别优化了:

- 长文档处理:支持128K上下文窗口,可处理完整的法律合同和技术文档

- RAG增强:在MTRAG多轮检索增强生成测试中表现优异

- 低延迟响应:企业客服场景平均响应时间<0.5秒

- 资源效率:单GPU即可运行,降低中小企业使用门槛

行业影响与落地案例

降低企业AI准入门槛

Granite-4.0-H-Micro-Base的推出显著降低了企业AI应用门槛。通过优化架构设计,模型在保持高性能的同时,将部署成本降低60%以上,使中小企业也能负担企业级AI能力。香港某制造企业采用该模型后,通过预测性维护系统将设备故障率降低28%,投资回收期仅8个月。

推动AI应用标准化

作为首个获得ISO/IEC 42001:2023认证的开源模型,Granite-4.0-H-Micro-Base为行业树立了AI安全与治理标杆。其采用的Apache 2.0开源协议允许商业使用,同时提供完整的安全审计文档和伦理使用指南,帮助企业规避AI应用的合规风险。

典型应用场景

- 金融服务:某区域银行部署模型后,智能风控系统处理效率提升3倍,同时误判率降低15%

- 制造业:某汽车零部件厂商通过模型优化供应链预测,库存周转率提升22%

- 客户服务:全球科技企业将模型集成至客服系统,自动解决率达78%,人力成本降低35%

快速上手指南

环境准备

# 克隆仓库

git clone https://gitcode.com/hf_mirrors/ibm-granite/granite-4.0-h-micro-base

# 安装依赖

pip install torch torchvision torchaudio accelerate transformers

基础调用示例

from transformers import AutoModelForCausalLM, AutoTokenizer

device = "cuda"

model_path = "ibm-granite/granite-4.0-h-micro-base"

tokenizer = AutoTokenizer.from_pretrained(model_path)

# drop device_map if running on CPU

model = AutoModelForCausalLM.from_pretrained(model_path, device_map=device)

model.eval()

# change input text as desired

input_text = "The capital of France is"

# tokenize the text

input_tokens = tokenizer(input_text, return_tensors="pt").to(device)

# generate output tokens

output = model.generate(**input_tokens, max_length=10)

# decode output tokens into text

output = tokenizer.batch_decode(output)

# print output

print(output[0])

行业适配建议

- 金融领域:建议微调时增加70%信贷合同数据

- 制造业:启用Mamba2长文本处理能力分析生产日志

- 法律服务:结合RAG技术构建法律知识库

未来展望与建议

技术演进方向

IBM计划在2025年底前进一步扩展Granite 4.0模型家族,包括推出强化逻辑推理的"Thinking"模型和更小型的边缘计算优化版本。随着模型能力的持续迭代,预计企业级AI应用将向更复杂的决策支持和流程自动化场景渗透。

企业adoption建议

对于考虑部署Granite-4.0-H-Micro-Base的企业,建议:

- 优先从标准化场景切入,如智能客服、文档处理等

- 结合RAG技术增强模型领域知识,提升专业场景表现

- 建立完善的模型监控机制,确保输出准确性和安全性

- 从小规模试点开始,逐步扩展至核心业务流程

总结

Granite-4.0-H-Micro-Base以30亿参数规模实现了"轻量高效"的企业级AI能力,其混合架构设计和场景化优化为行业展示了大模型实用化的新路径。在企业AI应用进入规模化落地的关键阶段,这类兼顾性能、成本与安全性的模型将成为推动AI技术普及的重要力量。随着技术生态的不断完善,轻量化企业级大模型将在未来1-2年内成为各行业数字化转型的基础设施。

要开始使用Granite-4.0-H-Micro-Base,企业可通过GitCode仓库获取模型:https://gitcode.com/hf_mirrors/ibm-granite/granite-4.0-h-micro-base,或直接在IBM watsonx.ai平台体验云端服务。

更多推荐

已为社区贡献3条内容

已为社区贡献3条内容

项目地址: https://ai.gitcode.com/hf_mirrors/ibm-granite/granite-4.0-h-micro-base

项目地址: https://ai.gitcode.com/hf_mirrors/ibm-granite/granite-4.0-h-micro-base

所有评论(0)