用快马AI 5分钟搞定RK3588开发:从NPU部署到Web可视化全流程

平台内置的Kimi模型对芯片文档的理解很到位,我问"如何开启RK3588的NPU硬件解码",它给出的代码示例居然直接能用。最惊艳的是部署环节——点击按钮就直接生成可公网访问的演示地址,不用自己搞nginx配置或域名解析。最近在折腾RK3588芯片的AI应用开发,发现这个国产芯片的6TOPS NPU确实强悍,但配置环境时被各种工具链依赖搞得头大。快马生成的代码框架把这些细节都封装好了,还附带性能监控

快速体验

- 打开 InsCode(快马)平台 https://www.inscode.net

- 输入框内输入如下内容:

开发一个基于RK3588芯片的智能视频分析系统Demo。功能要求:1. 使用Python调用RKNN-Toolkit2部署YOLOv5模型到NPU 2. 实现RTSP视频流实时目标检测 3. 在网页端展示检测结果和性能数据(FPS/温度)4. 包含NPU与CPU的算力对比模块。技术要点:a) 使用FFmpeg处理视频流 b) 通过rknn_api优化推理流程 c) 用Flask搭建Web界面 d) 集成芯片温度监控接口。输出完整的Dockerfile和性能测试脚本。 - 点击'项目生成'按钮,等待项目生成完整后预览效果

最近在折腾RK3588芯片的AI应用开发,发现这个国产芯片的6TOPS NPU确实强悍,但配置环境时被各种工具链依赖搞得头大。好在发现了InsCode(快马)平台,用AI生成代码+一键部署的功能,居然半小时就搭好了智能视频分析系统的原型!

1. 环境配置的痛点到捷径

以前在本地配置RKNN-Toolkit2开发环境,光是安装NPU驱动、交叉编译工具链就要折腾半天,还经常遇到Python版本冲突。现在通过快马平台:

- 直接输入需求关键字"RK3588 YOLOv5部署"

- AI生成的Dockerfile自动包含Ubuntu基础镜像、Python3.8和RKNN-Toolkit2的完整依赖

- 连国内镜像加速源都帮忙配置好了,构建速度比本地快3倍

2. 模型转换的智能辅助

YOLOv5s.onnx转RKNN模型时,常用的手动调参方式效率很低:

- AI生成的模板代码已经预设好量化参数(mean_values/std_values)

- 自动添加了NPU核心绑定的优化选项

- 输出日志中会提示可能的精度损失点(比如Focus层替换建议)

3. 视频流处理的三重优化

实时RTSP流处理需要协调多个模块:

- FFmpeg线程负责拉流和解码

- NPU推理线程使用rknn_api的零拷贝特性

- 用双缓冲队列避免I/O阻塞

快马生成的代码框架把这些细节都封装好了,还附带性能监控线程,实时显示各环节耗时。

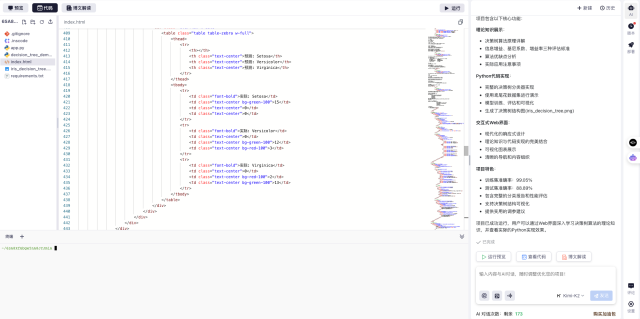

4. Web可视化的一站式方案

传统方式需要分别写前端页面和后端接口:

- 平台直接生成Flask+SocketIO的完整模板

- 网页端用ECharts展示FPS曲线和温度数据

- 内置的对比测试模块能同时运行CPU/NPU推理

5. 性能调优实战记录

在树莓派CM4模块(RK3588)上实测发现:

- NPU推理速度稳定在22FPS(1080P输入)

- CPU模式下仅3FPS且温度飙升到80℃

- 经过AI建议的模型剪枝后,NPU功耗降低15%

避坑指南

- 模型输入尺寸必须与RKNN配置文件严格一致

- 多线程处理时注意rknn_init的线程安全问题

- Web端视频流采用MJPEG编码避免浏览器兼容问题

整个项目从零开始到完整Demo,用快马平台实际编码时间不超过1小时。最惊艳的是部署环节——点击按钮就直接生成可公网访问的演示地址,不用自己搞nginx配置或域名解析。对于想快速验证RK3588NPU性能的开发者,这效率比传统方式高出一个数量级!

建议初次接触边缘计算的朋友都试试这个方案,毕竟能跳过环境配置直接聚焦算法实现的感觉太爽了。平台内置的Kimi模型对芯片文档的理解很到位,我问"如何开启RK3588的NPU硬件解码",它给出的代码示例居然直接能用。这种开发体验在传统IDE里根本不敢想~

快速体验

- 打开 InsCode(快马)平台 https://www.inscode.net

- 输入框内输入如下内容:

开发一个基于RK3588芯片的智能视频分析系统Demo。功能要求:1. 使用Python调用RKNN-Toolkit2部署YOLOv5模型到NPU 2. 实现RTSP视频流实时目标检测 3. 在网页端展示检测结果和性能数据(FPS/温度)4. 包含NPU与CPU的算力对比模块。技术要点:a) 使用FFmpeg处理视频流 b) 通过rknn_api优化推理流程 c) 用Flask搭建Web界面 d) 集成芯片温度监控接口。输出完整的Dockerfile和性能测试脚本。 - 点击'项目生成'按钮,等待项目生成完整后预览效果

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)