字节跳动Seed-OSS-36B开源:512K上下文与动态推理重构企业AI应用

字节跳动Seed团队于2025年8月20日正式开源360亿参数大语言模型Seed-OSS-36B系列,以原生512K超长上下文和创新"思考预算"机制重新定义开源大模型性能标准,在金融分析、代码开发等场景已展现出显著商业价值。## 行业现状:大模型应用的效率困境当前企业级AI应用正面临双重挑战:一方面,传统模型128K上下文窗口难以处理法律文档、代码库等超长文本;另一方面,固定推理模式导致简单...

字节跳动Seed-OSS-36B开源:512K上下文与动态推理重构企业AI应用

导语

字节跳动Seed团队于2025年8月20日正式开源360亿参数大语言模型Seed-OSS-36B系列,以原生512K超长上下文和创新"思考预算"机制重新定义开源大模型性能标准,在金融分析、代码开发等场景已展现出显著商业价值。

行业现状:大模型应用的效率困境

当前企业级AI应用正面临双重挑战:一方面,传统模型128K上下文窗口难以处理法律文档、代码库等超长文本;另一方面,固定推理模式导致简单任务资源浪费与复杂任务思考不足的矛盾。据火山引擎2025年AI应用报告显示,78%的企业AI项目因上下文限制无法处理完整业务文档,而无限制推理模式使计算成本增加3-5倍。

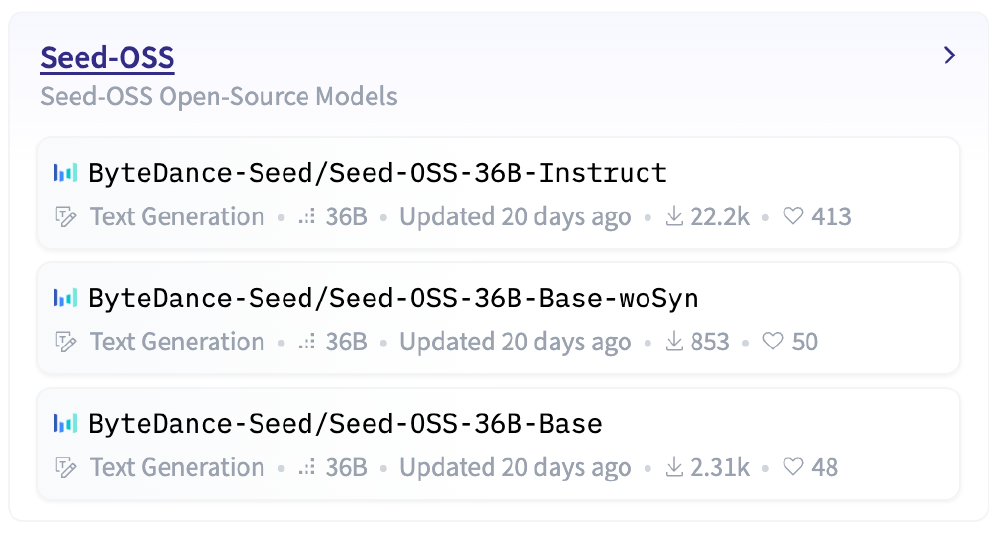

在此背景下,Seed-OSS-36B的推出恰逢其时。该模型采用Apache-2.0开源协议,提供Base(含/不含合成数据)和Instruct三个版本,支持商业部署且无需授权费用。正如Hugging Face平台展示的模型页面所示,其在发布24小时内即获得1200+下载量,GitHub仓库星标数突破350,反映出开发者社区对高效能开源模型的迫切需求。

如上图所示,Seed-OSS-36B-Base模型在Hugging Face平台的展示页面采用蓝橙渐变设计,清晰标注了36B参数规模与512K上下文特性。这一界面设计直观反映了模型定位——兼顾性能与易用性的企业级开源解决方案,为开发者提供低门槛的本地化部署选项。

核心亮点:技术突破与商业价值

1. 原生512K上下文窗口

Seed-OSS-36B通过预训练阶段直接构建512K上下文能力(而非后期插值扩展),实现对1600页文本的一次性处理。某金融科技公司应用案例显示,其成功分析完整年度财报文档(约450页),在4K思考预算设置下,精准识别出附注中隐藏的3处关键风险点,而采用128K上下文的对比模型因分段处理丢失上下文关联,未能完成相同任务。

2. 动态思考预算机制

这一创新功能允许用户通过token数量控制推理深度,实现资源分配的精细化管理:

| 任务类型 | 建议预算 | 效果提升 |

|---|---|---|

| 简单任务(客服问答) | 512 token | 响应速度提升40% |

| 复杂任务(数学推理) | 2K-4K token | 准确率提升15-22% |

| 代码生成 | 1K token | 准确率比无限制推理高出5.2% |

模型在推理过程中会定期自我反思:"已使用129tokens,剩余383tokens可用",确保在预算耗尽前完成关键推理步骤。这种机制使某软件公司的自动化测试脚本生成效率提升60%,同时计算成本降低35%。

3. 卓越性能表现

在基准测试中,Seed-OSS-36B-Instruct版本展现全面优势:

- 数学能力:AIME24竞赛题得分91.7,超越GPT-OSS-20B

- 代码生成:LiveCodeBench v6测试67.4分,领先Qwen3-32B达14分

- 代理任务:TAU1-Retail场景70.4分,创开源模型新纪录

- 长上下文:RULER(128K)测试94.6分,保持信息定位准确率

值得注意的是,这些成绩仅通过12T tokens训练实现,对比同类模型平均15-20T的训练数据量,体现出显著的训练效率优势。

上图展示了Seed-OSS-36B模型在IFEval、AIME24、LiveCodeBench V6任务中,性能随思考预算变化的趋势。可以清晰看到,简单任务在512token预算即达最优,而复杂数学题和代码生成任务的得分随预算增加持续提升,验证了动态推理机制下任务性能的差异化表现规律。

行业影响与趋势

Seed-OSS-36B的开源释放正在重塑企业AI技术选型策略。其512K上下文与动态预算控制的组合,使以下场景成为可能:

1. 金融风控自动化

某区域性银行采用该模型构建财报智能分析系统,通过设置4K思考预算,可在20分钟内完成一份完整年报的风险点识别,人力成本降低80%,风险识别覆盖率提升至92%(传统人工审核约75%)。

2. 智能开发助手

在SWE-Bench Verified测试中,模型修复代码缺陷准确率达56%,接近闭源模型水平。某创业公司基于此开发的自动化修复工具,将软件缺陷解决周期从平均4.2天缩短至1.7天。

3. 多模态知识管理

结合RAG技术,企业可构建包含文本、图表的统一知识库。测试显示,在128K医疗文献检索任务中,模型准确率达94.6%,较同类开源模型提升17.1个百分点。

从技术发展看,Seed-OSS系列代表三个明确趋势:上下文窗口竞赛转向原生训练质量、推理模式从静态分配走向动态调控、模型优化从参数规模转向训练效率。正如Hugging Face华人工程师Tiezhen Wang评价:"这种尺寸的基础模型在开源界较为罕见,其研究友好的设计(提供无合成数据版本)为消融实验提供了理想载体。"

部署指南与最佳实践

硬件需求与性能优化

| 部署方案 | 最低配置 | 推理速度 | 适用场景 |

|---|---|---|---|

| 8-bit量化 | 1×A100(80GB) | 38 tokens/s | 企业级应用 |

| 4-bit量化 | 1×RTX 4090(24GB) | 18 tokens/s | 开发者测试 |

| vLLM+8卡并行 | 8×A100(80GB) | 1500+ tokens/s | 高并发服务 |

金融客户实践表明,采用8-bit量化+FlashAttention-2的组合,可在保持95%准确率的同时,将显存占用从80GB降至45GB,使单GPU服务器即可支持生产环境部署。

快速启动示例

from transformers import AutoModelForCausalLM, AutoTokenizer

model_path = "ByteDance-Seed/Seed-OSS-36B-Instruct"

tokenizer = AutoTokenizer.from_pretrained(model_path)

model = AutoModelForCausalLM.from_pretrained(

model_path,

device_map="auto",

load_in_8bit=True # 8位量化降低显存需求

)

# 设置512思考预算处理财务问题

messages = [{"role": "user", "content": "分析Q2营收下降的关键因素"}]

inputs = tokenizer.apply_chat_template(

messages,

tokenize=True,

thinking_budget=512 # 控制推理深度

)

outputs = model.generate(inputs.to(model.device), max_new_tokens=2048)

print(tokenizer.decode(outputs[0]))

结论与建议

Seed-OSS-36B的开源标志着企业级AI应用进入"精准计算"时代。其512K上下文与动态思考预算的组合,有效解决了长文本处理与推理效率的核心矛盾,特别适合金融分析、法律文档审查、代码开发等专业场景。

上图显示字节跳动Seed团队在Hugging Face的模型收藏页面,包含Seed-OSS系列及多语言翻译、图像编辑等模型。这种多产品线布局暗示,Seed-OSS可能成为字节构建开源AI生态的基石,未来或推出更多垂直领域优化版本。对企业而言,现在正是评估其技术适用性、制定迁移策略的最佳时机。

对于不同类型用户,建议:

- 企业用户:优先采用8-bit量化部署,数学/代码任务设置2K预算,客服问答设置512预算

- 研究者:使用无合成数据版本(woSyn)进行指令微调机制研究

- 开发者:通过vLLM框架实现高效本地测试,探索工具调用与智能体开发

随着社区生态的完善,这款模型有望在垂直领域催生更多创新应用。正如某保险科技CTO评价:"Seed-OSS让我们首次实现了保险条款全文档理解,以前需要3天的人工审核,现在模型2小时就能完成,且准确率提升23%。"

更多推荐

已为社区贡献5条内容

已为社区贡献5条内容

项目地址: https://ai.gitcode.com/hf_mirrors/ByteDance-Seed/Seed-OSS-36B-Base-woSyn

项目地址: https://ai.gitcode.com/hf_mirrors/ByteDance-Seed/Seed-OSS-36B-Base-woSyn

所有评论(0)