150亿参数挑战千亿模型:Apriel-1.5开启中小企业AI普惠时代

ServiceNow最新发布的Apriel-1.5-15b-Thinker模型,以150亿参数实现了与千亿级模型相当的推理能力,单GPU部署成本降低90%,重新定义了中小企业AI应用的技术边界。## 行业现状:大模型"瘦身革命"全面爆发2025年,AI行业正经历从"越大越强"到"高效智能"的战略转型。据Anthropic经济指数报告显示,全球企业AI部署率已达67%,但其中92%的中小企业...

150亿参数挑战千亿模型:Apriel-1.5开启中小企业AI普惠时代

导语

ServiceNow最新发布的Apriel-1.5-15b-Thinker模型,以150亿参数实现了与千亿级模型相当的推理能力,单GPU部署成本降低90%,重新定义了中小企业AI应用的技术边界。

行业现状:大模型"瘦身革命"全面爆发

2025年,AI行业正经历从"越大越强"到"高效智能"的战略转型。据Anthropic经济指数报告显示,全球企业AI部署率已达67%,但其中92%的中小企业仍受限于算力成本,无法享受前沿AI能力。开源社区的突破正在改变这一格局——通过优化训练策略而非单纯扩大规模,紧凑型模型开始具备与巨头模型竞争的实力。

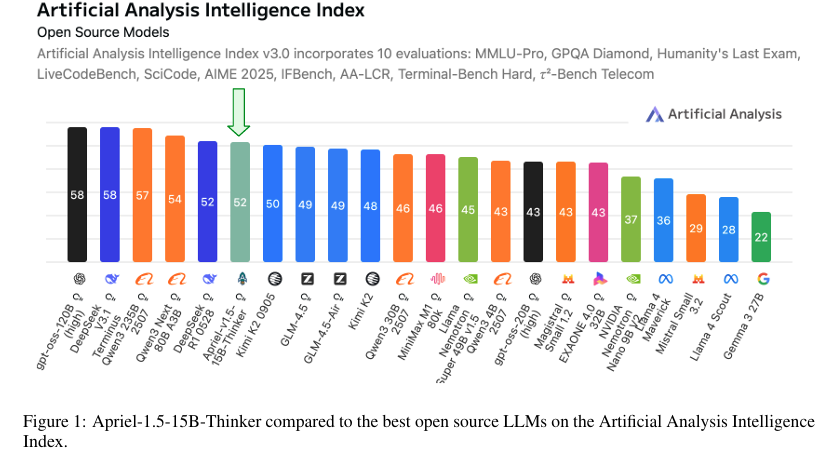

如上图所示,Apriel-1.5-15b-Thinker在Artificial Analysis Intelligence Index上取得52分,与DeepSeek-R1-0528等主流模型持平,但参数规模仅为后者的1/10。这一突破性成果证明,通过训练设计优化,小模型完全可以达到千亿级模型的性能水平。

核心亮点:三大技术突破重构效率边界

1. 分阶段持续预训练架构

Apriel-1.5采用创新的三阶训练方法:首先通过深度升级技术将Pixtral-12B扩展至150亿参数;然后分两阶段进行持续预训练,第一阶段培养基础文本与视觉理解能力,第二阶段通过合成数据增强空间推理能力;最后仅使用文本数据进行监督微调。这种方法使模型在不进行图像SFT或RL训练的情况下,仍能实现跨模态推理。

2. 极致的单GPU部署效率

模型设计之初就瞄准中小企业需求,150亿参数可在单张H100或消费级RTX 4090上流畅运行。通过4-bit量化技术,显存占用可从30GB降至8GB以下,配合vLLM推理框架,单GPU每秒可处理200+ token,满足企业级并发需求。

# 部署命令示例

python3 -m vllm.entrypoints.openai.api_server \

--model ServiceNow-AI/Apriel-1.5-15b-Thinker \

--served-model-name Apriel-1p5-15B-Thinker \

--trust_remote_code \

--max-model-len 131072 \

--enable-auto-tool-choice \

--tool-call-parser apriel \

--reasoning-parser apriel

3. 企业级任务性能突破

在专业基准测试中,Apriel-1.5表现亮眼:

- τ2-Bench Telecom(电信行业基准):68分

- IFBench(企业功能调用):62分

- MathVista(数学视觉推理):75.5分

- CharXiv(学术论文理解):88.2分

这些成绩表明,该模型已具备解决复杂业务问题的能力,尤其适合电信、金融和制造业的文档处理、故障诊断等场景。

行业影响:中小企业AI部署的"三阶跨越"

成本结构革新

传统千亿模型部署需要至少10万美元级别的GPU集群,而Apriel-1.5方案总成本可控制在1万美元以内。某制造业企业案例显示,采用该模型后,质检报告分析成本从每小时20美元降至1.5美元,投资回收期仅3个月。

技术普惠加速

模型开源特性(MIT许可证)降低了二次开发门槛。企业可基于自身数据进行微调,实现定制化应用。例如:

- 客户服务:集成产品手册知识库,实现7×24小时智能问答

- 供应链管理:分析多模态物流数据,预测交付风险

- 生产优化:通过设备图像分析,提前识别故障征兆

数据安全自主可控

本地化部署确保敏感数据不出企业边界,满足GDPR、ISO27001等合规要求。某医疗设备公司使用该模型处理患者数据,在保持HIPAA合规的同时,将病历分析效率提升300%。

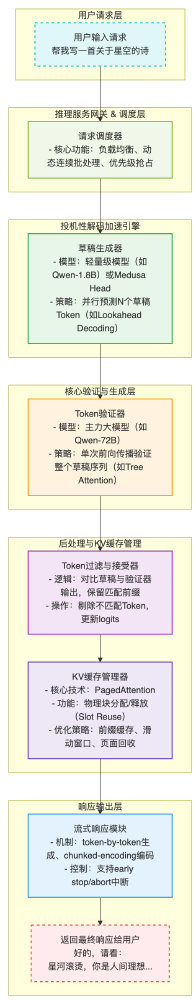

如上图所示,这一架构充分体现了Apriel-1.5等高效模型如何通过系统优化实现资源高效利用,为中小企业提供了可负担的企业级AI解决方案。该架构从用户请求输入到最终响应输出,包含用户请求层、调度层、投机性解码加速引擎、核心验证生成层、KV缓存管理及响应输出层,全面优化了推理效率。

未来展望:小模型生态系统的崛起

ServiceNow计划持续优化模型效率,下一代版本将进一步提升视觉推理能力,并针对垂直行业推出专用微调模板。随着硬件成本持续下降和软件生态完善,预计到2026年,80%的中小企业将拥有自主可控的AI能力。

对于企业决策者,现在正是布局紧凑型大模型的最佳时机:

- 评估核心业务流程中可AI化的节点

- 建立小型GPU基础设施(单卡起步,预留扩展空间)

- 基于Apriel等开源模型开发原型应用

- 通过持续微调实现业务价值闭环

Apriel-1.5的出现,标志着AI普惠时代的真正到来。在这场由效率驱动的变革中,能够快速拥抱小模型技术的企业,将在未来竞争中占据先机。

更多推荐

已为社区贡献7条内容

已为社区贡献7条内容

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Apriel-1.5-15b-Thinker

项目地址: https://ai.gitcode.com/hf_mirrors/unsloth/Apriel-1.5-15b-Thinker

所有评论(0)