本地部署DeepSeek-R1:8B模型的实践指南

此外,文中提供的简易HTML聊天界面非常轻量,适合快速体验和二次开发。Ollama作为轻量级工具,简化了模型的运行和管理流程,适合个人开发者使用。Ollama提供了pull和run两个命令选项,分别对应仅下载模型和下载+运行模型两种场景。通过Modelfile可以深度定制模型行为,包括调整温度参数、上下文长度等核心参数,还能定义角色性格和交互方式。建议将OLLAMA_MODELS指向大容量存储分区

快速体验

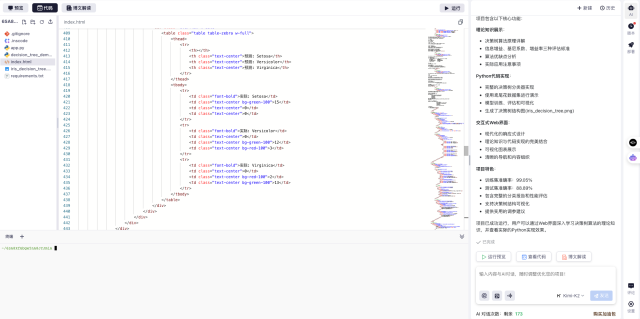

- 打开 InsCode(快马)平台 https://www.inscode.net

- 输入框输入如下内容

帮我开发一个基于DeepSeek-R1:8B模型的本地对话系统,适合技术爱好者体验大语言模型能力。系统交互细节:1. 支持模型下载与运行 2. 提供简易聊天界面 3. 可自定义模型参数。注意事项:需6GB以上显存显卡支持。 - 点击'项目生成'按钮,等待项目生成完整后预览效果

本地部署实践要点

-

环境准备 RTX2060 6GB显存显卡即可运行DeepSeek-R1:8B模型,相比其他大模型对硬件要求较为友好。Ollama作为轻量级工具,简化了模型的运行和管理流程,适合个人开发者使用。

-

配置优化 通过设置环境变量可以自定义模型下载位置,避免默认占用C盘空间。建议将OLLAMA_MODELS指向大容量存储分区,这对长期使用多模型的开发者尤为重要。

-

模型运行技巧 Ollama提供了pull和run两个命令选项,分别对应仅下载模型和下载+运行模型两种场景。根据网络状况合理选择可以避免长时间等待,建议首次使用时先单独pull模型文件。

-

交互界面选择 Chatbox AI提供了完善的网页版界面,配置时需特别注意Model Provider、API Host和Model三项关键参数。此外,文中提供的简易HTML聊天界面非常轻量,适合快速体验和二次开发。

-

模型定制进阶 通过Modelfile可以深度定制模型行为,包括调整温度参数、上下文长度等核心参数,还能定义角色性格和交互方式。这种定制能力让模型能适应更多特定场景需求。

实用建议

- 对于初次接触大模型的开发者,建议先用默认参数体验基础功能,再逐步尝试高级定制

- 模型下载时间取决于网络状况,4GB左右的模型文件需要预留足够下载时间

- 简易HTML界面的响应速度更快,适合本地快速测试和原型开发

- 定期检查Ollama更新,新版本通常会优化性能和修复问题

平台体验

在InsCode(快马)平台上,这类AI应用可以快速生成和体验,无需复杂环境配置。平台内置的编辑器让代码调整变得简单,一键预览功能也方便即时查看效果。

本地部署大语言模型虽然有一定技术门槛,但通过合适工具和方法完全可以实现。希望这篇指南能帮助开发者顺利开启自己的AI探索之旅。

更多推荐

已为社区贡献2条内容

已为社区贡献2条内容

所有评论(0)